Gemma 4 部署保姆级教程:从零到跑通的完整指南

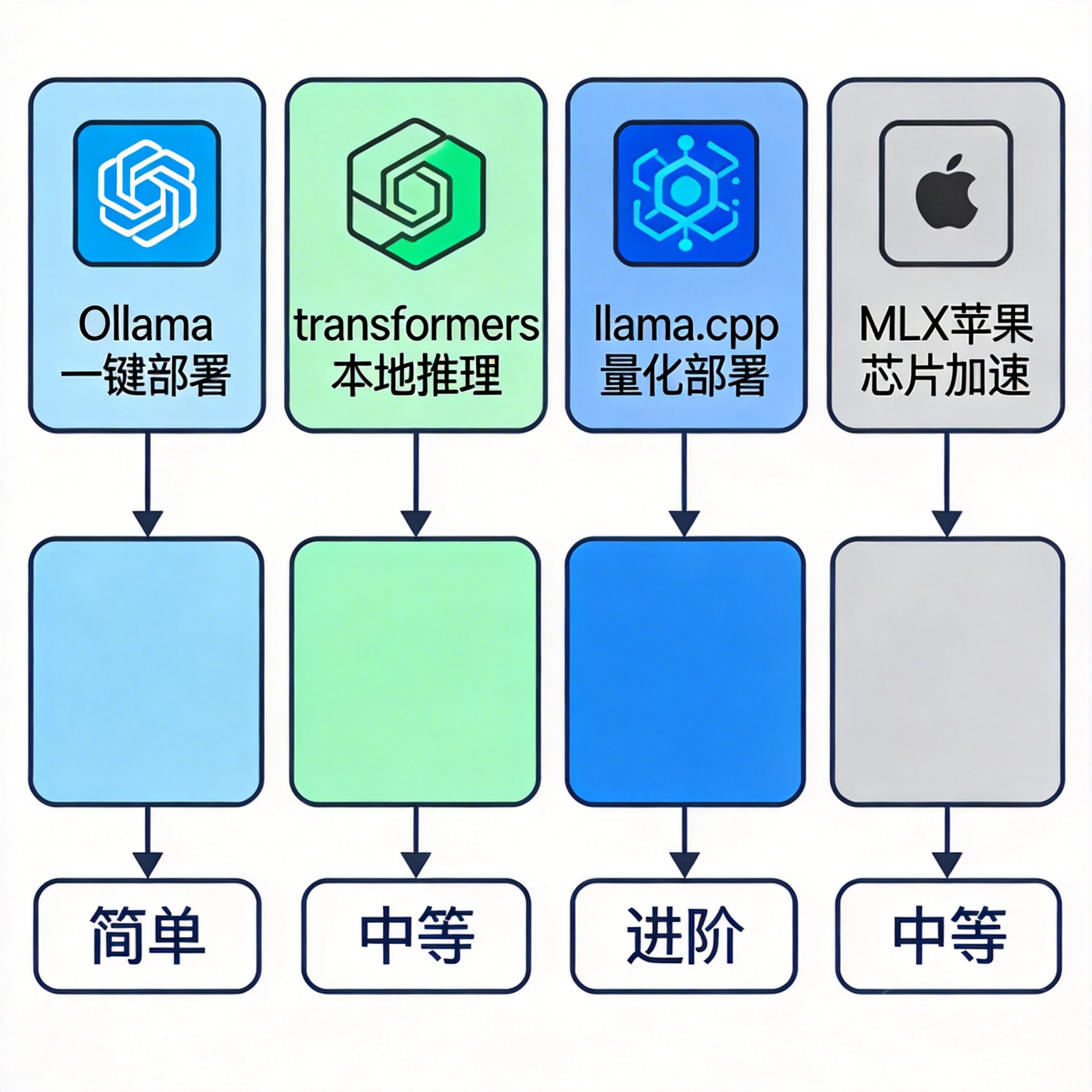

Gemma 4 是 Google DeepMind 于 2026 年 4 月 2 日发布的最新开源多模态大模型家族,提供从手机端 2.3B 到服务器级 31B 的四个变体,Apache 2.0 协议完全免费商用。本文覆盖 Ollama 一键部署、Python transformers 本地推理、llama.cpp 量化运行、Apple Silicon MLX 加速四条路径,适合零基础用户按步骤跟做。

Gemma 4 有哪些版本,我该选哪个?

Gemma 4 共四个版本,核心区别是参数规模、支持的模态和硬件要求。

选型建议:

● 个人开发者日常用 → E4B(性价比最高,Ollama 一行命令搞定)

● 笔记本 + Mac M 系列 → E2B 或 E4B(MLX 路径,速度快)

● 企业生产部署 → 26B-A4B(MoE 架构,激活参数仅 4B,推理速度接近小模型)

方法一:Ollama 一键部署(最简单,5 分钟跑通)

Ollama 是目前最流行的本地大模型运行工具,Gemma 4 发布当日即已上线。

第一步:安装 Ollama

# macOS / Linux(一行命令)

curl -fsSL https://ollama.com/install.sh | sh

# macOS 也可用 Homebrew

brew install ollama

Windows 用户前往 ollama.com 下载安装包,双击安装即可。

第二步:拉取并运行 Gemma 4

# 默认拉取 E4B(约 3.2GB)

ollama run gemma4

# 指定具体变体

ollama run gemma4:e2b # 最轻量,约 1.6GB

ollama run gemma4:e4b # 推荐,约 3.2GB

ollama run gemma4:26b # MoE 高性能版

ollama run gemma4:31b # 最强本地版

运行后出现 >>> 提示符即可直接对话。

第三步(可选):开启 Thinking 模式

Gemma 4 内置推理思考链,在系统提示词中加入 <|think|> 即可激活:

ollama run gemma4 --system "<|think|>"

模型会在回答前输出内部推理过程,适合复杂逻辑任务。

第四步(可选):API 方式调用

Ollama 启动后自动在 localhost:11434 提供 OpenAI 兼容接口:

from ollama import chat

response = chat(

model="gemma4:e4b",

messages=[{"role": "user", "content": "用 Python 写一个快速排序"}],

options={"temperature": 1.0, "top_p": 0.95, "top_k": 64}

)

print(response["message"]["content"])

方法二:transformers 本地推理(适合开发集成)

适合需要在自己代码里调用 Gemma 4 的开发者。

环境准备

pip install -U transformers huggingface_hub torch accelerate

登录 Hugging Face(必须,模型需要接受协议)

huggingface-cli login

# 输入你的 HF Token(在 huggingface.co → Settings → Tokens 生成)

或在 Python 中:

from huggingface_hub import login

login(token="hf_YOUR_TOKEN_HERE")

纯文本对话(最简写法)

from transformers import pipeline

pipe = pipeline("any-to-any", model="google/gemma-4-e2b-it")

messages = [{"role": "user", "content": [{"type": "text", "text": "你好,介绍一下你自己"}]}]

output = pipe(messages, max_new_tokens=200, return_full_text=False)

print(output[0]["generated_text"])

图文多模态推理

from transformers import AutoModelForMultimodalLM, AutoProcessor # [版本待核实:需 transformers>=4.51.0]

model = AutoModelForMultimodalLM.from_pretrained(

"google/gemma-4-E4B-it",

device_map="auto"

)

processor = AutoProcessor.from_pretrained("google/gemma-4-E4B-it")

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "https://example.com/photo.jpg"},

{"type": "text", "text": "描述这张图片"},

],

}

]

inputs = processor.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt"

).to(model.device)

generated_ids = model.generate(**inputs, max_new_tokens=256)

output_ids = [out[len(inp):] for inp, out in zip(inputs.input_ids, generated_ids)]

print(processor.batch_decode(output_ids, skip_special_tokens=True)[0])

注意: 图片内容必须放在文本之前,Gemma 4 对提示词顺序敏感。音频/视频输入同理,媒体内容先行。

视频理解(E2B/E4B 专属)

messages = [

{

"role": "user",

"content": [

{"type": "video", "image": "/path/to/your/video.mp4"},

{"type": "text", "text": "总结这段视频的内容"},

],

}

]

inputs = processor.apply_chat_template(

messages,

tokenize=True,

return_dict=True,

return_tensors="pt",

add_generation_prompt=True,

load_audio_from_video=True, # 同时提取视频中的音频

).to(model.device)

output = model.generate(**inputs, max_new_tokens=512)

print(processor.decode(output[0][inputs.input_ids.shape[-1]:], skip_special_tokens=True))

方法三:llama.cpp 量化部署(低显存救星)

llama.cpp 支持 GGUF 格式量化,让 26B 模型在 8GB 显卡上跑起来。

安装 llama.cpp

# macOS

brew install llama.cpp

# Linux / Windows(从源码编译)

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make -j$(nproc)

下载 GGUF 量化版并运行

# 使用 Unsloth 提供的量化版(E4B 约 2.8GB Q4_K_M)

llama-server -hf ggml-org/gemma-4-E2B-it-GGUF

# 26B MoE 量化版(Q4_K_M 约 10GB,实际运行显存约 6GB)

llama-server -hf unsloth/gemma-4-26B-A4B-it-GGUF

# 启动后访问 http://localhost:8080 使用内置聊天界面

量化精度选择参考:

方法四:MLX 部署(Apple Silicon 专属,速度最快)

M1/M2/M3/M4 Mac 用户使用 MLX 框架可以充分利用统一内存,E4B 在 M2 上推理速度约 40-60 tokens/s。

pip install -U mlx-vlm

# 图文多模态推理

python -m mlx_vlm.generate \

--model google/gemma-4-E4B-it \

--image https://example.com/photo.jpg \

--prompt "描述这张图片的内容" \

--max-tokens 300

Python 调用:

from mlx_vlm import load, generate

from mlx_vlm.prompt_utils import apply_chat_template

from mlx_vlm.utils import load_config

model, processor = load("google/gemma-4-E4B-it")

config = load_config("google/gemma-4-E4B-it")

prompt = apply_chat_template(processor, config, "解释量子纠缠", num_images=0)

output = generate(model, processor, prompt, max_tokens=300, verbose=False)

print(output)

推荐参数配置

官方推荐的生成参数(适用于所有部署方式):

generation_config = {

"temperature": 1.0, # 控制随机性,1.0 为标准值

"top_p": 0.95, # nucleus sampling

"top_k": 64, # 候选 token 范围

"max_new_tokens": 512 # 根据任务调整

}

Thinking 模式专用参数(开启推理链时):

# 在 apply_chat_template 中启用

inputs = processor.apply_chat_template(

messages,

enable_thinking=True, # 开启 thinking 模式

tokenize=True,

...

)

常见报错与解决方法

Q:运行时出现 CUDA out of memory,怎么解决?

优先切换更小的变体(E4B → E2B),或使用 llama.cpp 的 Q4_K_M 量化版本。也可在 from_pretrained 中添加 load_in_4bit=True(需安装 bitsandbytes)降低显存占用。

Q:huggingface-cli login 登录后仍提示无权限访问模型?

需先在 huggingface.co 对应模型页面点击"Agree and access"接受 Gemma 使用条款,然后重新登录。每个 Gemma 模型需单独接受协议。Q:Ollama 拉取模型速度很慢,有没有加速方法?

国内用户可设置镜像:export OLLAMA_HOST=https://your-mirror,或通过兼容 OpenAI SDK 的推理 API 服务直接调用(无需本地下载,如七牛云 AI 大模型广场已集成 Gemma 系列模型,支持 OpenAI/Anthropic 双协议接入)。

Q:E2B/E4B 和 26B 模型对视频的支持有什么区别?

E2B 和 E4B 支持从视频中同时提取画面帧和音轨(设置 load_audio_from_video=True),是真正的"音视频"理解。26B 和 31B 仅支持图文视频(无音频),适合分析视频内容但不处理声音的场景。

Q:Gemma 4 的上下文窗口 256k 是真实可用的吗?

是的,26B 和 31B 支持真实 256k token 上下文,E2B/E4B 支持 128k,均为 Gemma 4 架构升级的核心亮点之一,官方 HuggingFace 文档有明确说明。

Gemma 4 核心规格速查

根据 Google DeepMind 官网(deepmind.google/models/gemma)及 HuggingFace 官方模型页面数据:

● 发布日期:2026 年 4 月 2 日

● 开源协议:Apache 2.0(商用免费)

● 支持语言:140+ 种

● HuggingFace 首周下载量:31B-it 达 111 万次,E4B-it 达 62 万次(截至 2026-04-08)

● 上下文窗口:E2B/E4B 为 128k,26B/31B 为 256k

● 图片分辨率 token 预算档位:70 / 140 / 280 / 560 / 1120 tokens(可变分辨率)

总结

Gemma 4 以 Apache 2.0 协议开放,四种尺寸覆盖从手机到服务器的全部部署场景,是 2026 年上半年综合能力最强的开源多模态模型之一。对于大多数个人开发者,推荐先用 Ollama + E4B 五分钟跑通,再按需切换到 transformers 或 llama.cpp 做精细化集成。

据 Google DeepMind 官方博客(developers.googleblog.com)介绍,Gemma 4 专为 Agentic 工作流设计,在多步规划任务上相比 Gemma 3 有显著提升。本文内容基于 2026 年 4 月数据,建议定期核查 HuggingFace 模型页面获取最新版本信息。

延伸资源

● Gemma 4 官方模型页:deepmind.google/models/gemma

● HuggingFace 模型合集:huggingface.co/models?search=gemma+4

● Ollama 模型页:ollama.com/library/gemma4

● 主流模型 API 多模型对比接入:qiniu.com/ai/models