API选错了有多惨?高并发崩溃,AI费用爆炸

在数字化转型的浪潮中,技术团队常常面临一个隐形却致命的陷阱:错误的API选型。很多CTO在项目初期为了求快,直接选用市面上最流行的接口,结果在业务爆发期遭遇性能瓶颈,或者在接入AI能力时发现接口协议根本不兼容。想象一下,当你的电商大促流量峰值来袭,支付网关突然因为并发限制而熔断,或者当你试图将最新的Claude模型接入客服系统时,发现现有的API网关不支持流式传输。这些都不是危言耸听,而是无数技术团队用真金白银买来的教训。本文不谈虚泛的理论,只聊实战中那些容易被忽视的关键决策点。

高并发场景下的隐形杀手:不仅仅是TPS

谈到高并发API架构设计,大多数开发者的第一反应是关注TPS(每秒事务处理量)和延迟。但这只是冰山一角。在真实的电商平台API接口设计中,更考验选型眼光的是“长连接管理”与“状态同步机制”。

以直播带货场景为例,瞬间涌入的数万次库存查询请求,如果全部直接透传到数据库,系统必崩无疑。优秀的API选型方案会优先考虑支持WebSocket或gRPC协议的接口,而非传统的RESTful轮询。这就涉及到直播电商API接口鉴权的复杂性——如何在保持长连接的同时,高效验证用户身份且不阻塞主线程?

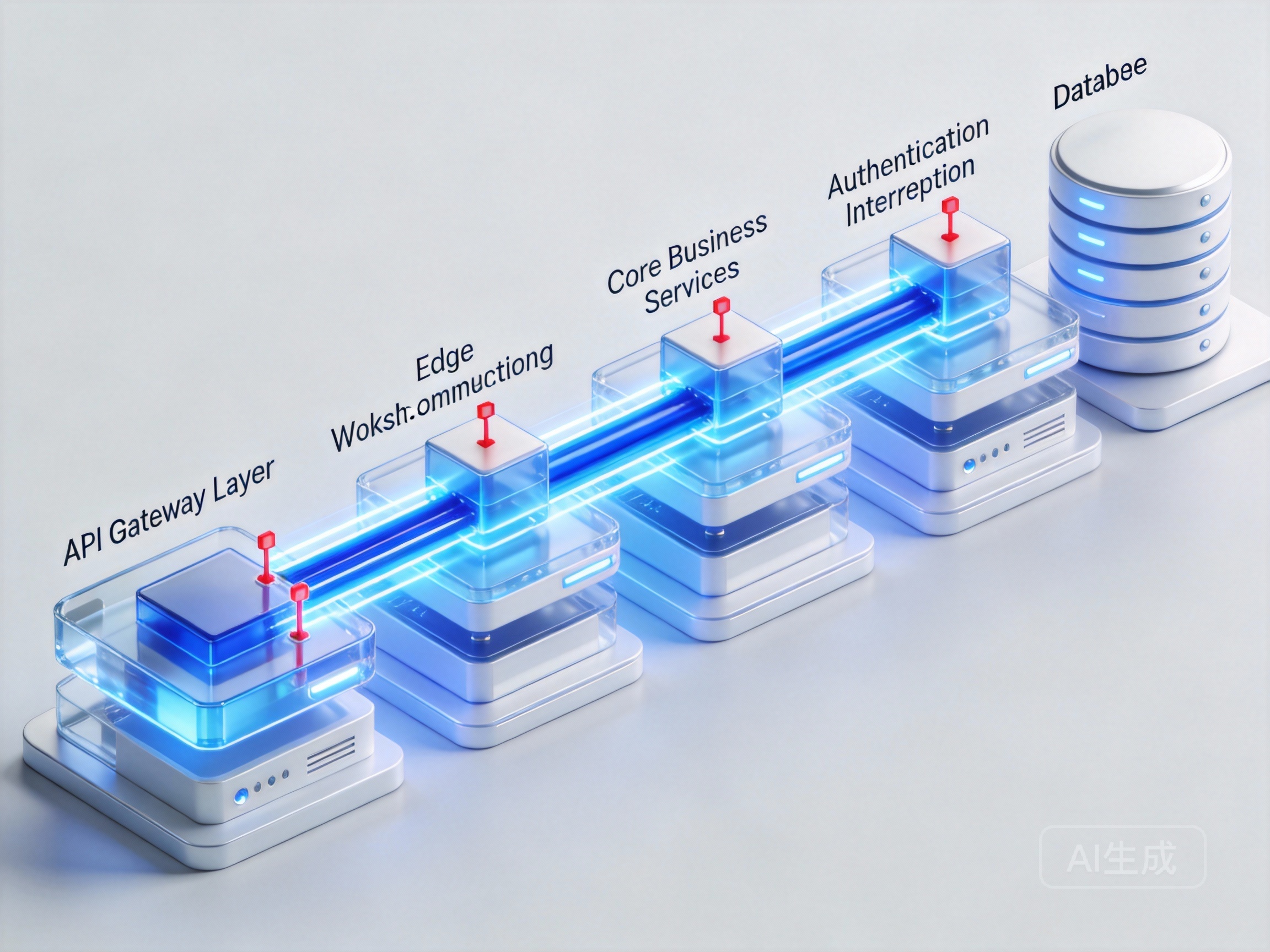

这里的一个实战技巧是采用边缘计算节点的鉴权分发。通过将鉴权逻辑前置,配合高效的企业级API网关选型,可以拦截90%以上的无效请求。如果你正在处理海量的音视频数据,还可以利用智能多媒体API接口来卸载服务器压力。这种服务能自动处理图片瘦身、音视频转码等资源消耗型任务,让你的核心API专注于业务逻辑,而非被I/O操作拖垮。

AI时代的接口革命:从静态调用到流式交互

随着大模型技术的落地,AI模型API的选型成为了新的技术高地。传统的API调用是“请求-响应”的一锤子买卖,但AI大模型API对接方案完全不同。现在的对话式AI需要支持Server-Sent Events (SSE) 流式输出,这对API网关的超时设置、缓冲区管理提出了全新挑战。

很多团队在接入大模型时,会遇到一个典型痛点:不同模型的API格式千奇百怪。今天接OpenAI,明天老板想换Claude,后天又要试DeepSeek,每次切换都要重写适配层代码,极其痛苦。这时候,选择一个兼容性强的中间层至关重要。

例如,通过七牛云API Key管理服务,开发者可以获得一个完美兼容OpenAI与Anthropic标准的统一入口。这种设计不仅解决了协议碎片化的问题,还解决了密钥管理的安全性难题。你不需要在代码里硬编码多个厂商的Key,只需管理这一个统一的凭证即可。更关键的是,这种统一接入层通常会配备完善的API安全解决方案,比如防止Key泄漏后的额度滥用,这对于控制AI推理成本至关重要。

性能与成本的平衡术:全链路视角的测试

在做API性能测试时,不要只盯着单一接口的响应时间。真正的瓶颈往往出现在“组合调用”的环节。比如一个AI应用,可能先调用OCR接口识别图片文字,再调用LLM进行理解,最后调用TTS生成语音。

这种链式调用中,任何一个环节的抖动都会被放大。如果你直接对接原始模型厂商,网络波动和排队等待是家常便饭。而使用聚合型的推理服务往往能提供更好的SLA保障。像AI大模型推理服务这样的平台,不仅集成了DeepSeek、Claude等顶级模型,还通过内部的路由优化减少了跨洋调用的延迟。对于开发者来说,这意味着可以用更低的延迟实现更复杂的Agent逻辑,比如结合联网搜索和深度思考功能,而无需担心底层基础设施的稳定性。

选型从来不是单纯的技术比拼,而是业务场景、运维成本与未来扩展性的博弈。从传统的高并发电商架构,到如今复杂的AI模型接入,核心逻辑始终未变:选择那些能为你屏蔽底层复杂性、提供标准接口协议、并具备弹性扩展能力的API服务。只有这样,你的技术架构才能在业务狂奔时,成为助推器而不是绊脚石。