从零自建AI Agent:全栈开发框架与私有化部署实战

现在很多开发者面临一个尴尬的局面:调用公有大模型的 API 很简单,但要让 AI 真正深入业务流程,去操作数据库、读写企业文档,甚至自动化执行复杂的运维脚本,单纯的 API 调用就显得捉襟见肘。数据隐私顾虑、高昂的 Token 成本以及对定制化工具链的需求,让自建一个 Agent 成为了技术团队打破“玩具级应用”天花板的必经之路。

自建 Agent 并非只是把 Prompt 包装一下那么简单,它本质上是构建一个拥有“大脑”(LLM)、“感官”(工具接口)和“记忆”(向量数据库)的完整智能体系统。在这个过程中,如何设计稳健的编排逻辑,如何让模型通过标准协议安全地调用本地工具,以及如何实现私有化环境下的稳定运行,才是核心挑战。

Python 驱动的核心架构设计

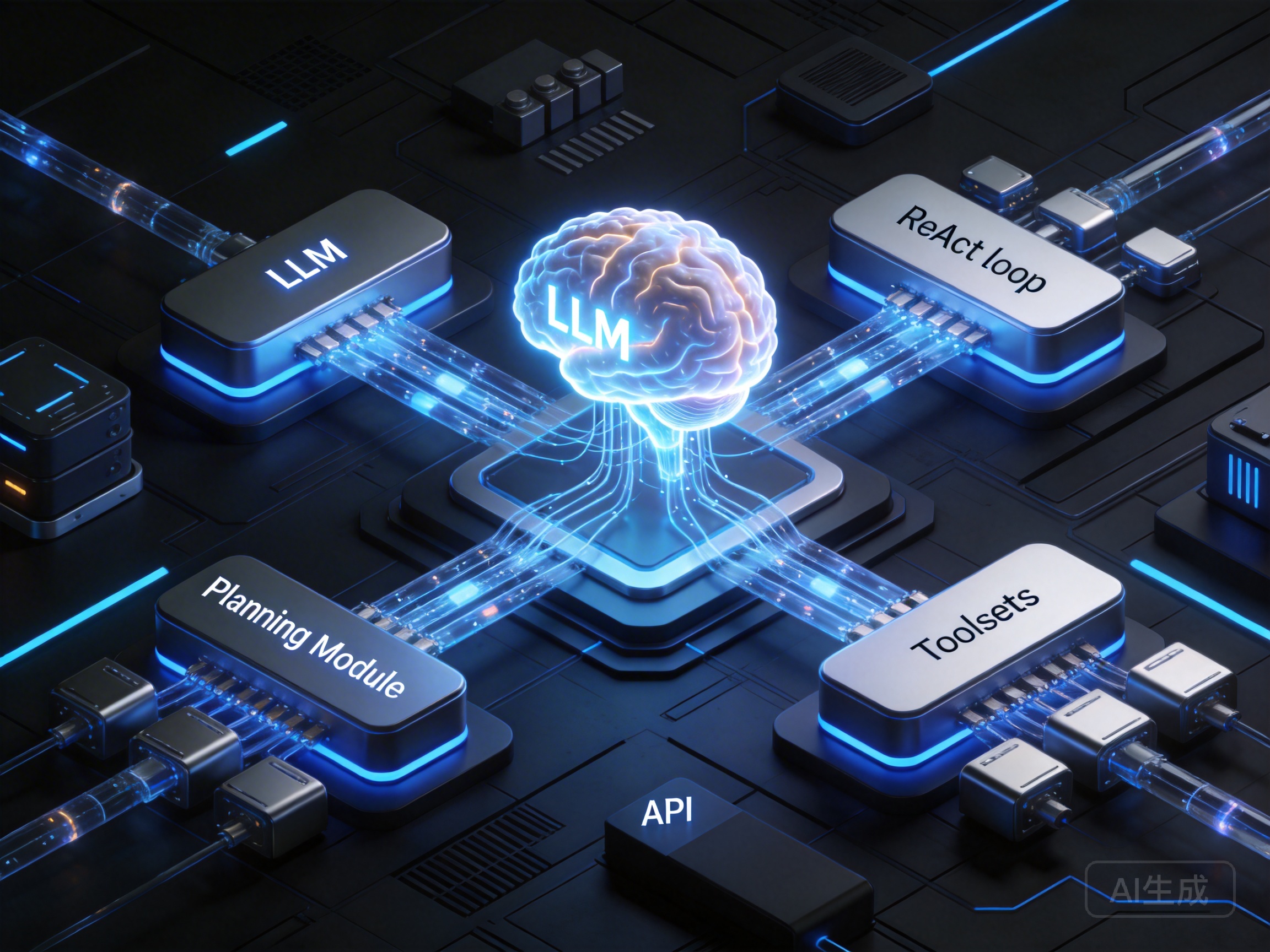

对于大多数开发者而言,如何用Python自建AI Agent 是最直观的切入点。Python 丰富的生态让我们能够快速搭建起 Agent 的核心循环:感知(Perception)、决策(Decision)、行动(Action)。一个最小可行性产品(MVP)通常包含三个关键模块:大模型接口层、提示词工程层以及工具执行层。

在代码实现层面,你需要抛弃简单的问答模式,转而采用 ReAct(Reasoning + Acting)或类似的思维链模式。这意味着你的程序需要解析模型返回的结构化数据(如 JSON),判断是否需要调用工具,执行工具代码,并将结果反哺给模型进行下一轮思考。这种“思考-执行-观察”的闭环是智能体自主性的来源。

如果你希望深入代码细节,了解如何从零开始通过 SDK 对接 DeepSeek 等高性能模型,并实现完整的对话与工具调用逻辑,可以参考这份 Agent 实战指南。它详细拆解了基于 OpenAI SDK 构建 Agent 的全流程,非常适合作为技术底座的参考。

打通任督二脉:MCP 协议与工具标准化

在搭建基于大模型的智能体时,最头疼的往往不是模型不够聪明,而是工具对接极其繁琐。传统的做法是为每个 API 写特定的 Python 胶水代码,这导致系统极难维护且难以扩展。一旦外部 API 变动,整个 Agent 就可能瘫痪。

为了解决这个问题,AI Agent工具调用与MCP配置 成为了新的技术热点。MCP(Model Context Protocol)协议提供了一种标准化的方式,让 AI 模型与外部数据和工具进行交互。通过 MCP,你可以将本地的文件系统、数据库查询接口甚至浏览器操作封装成标准服务,Agent 无需关心底层实现细节,只需遵循协议规范即可调用。

这种解耦设计对于企业级应用尤为重要。你可以将敏感的业务逻辑封装在 MCP Server 中,通过云端安全聚合进行管理。例如,利用 MCP 协议应用 方案,开发者无需在本地手动部署复杂的环境,即可快速接入标准化的模型能力编排,让 Agent 具备安全、可控的复杂任务处理能力。

私有化部署与企业级落地

当你的 Agent 跑通了逻辑,下一步就是企业级Agent私有化部署方案。在企业内部,数据安全是红线,因此往往需要将 Agent 部署在私有云或本地服务器上,同时配合本地知识库使用。

Dify 是目前非常流行的开源 LLM 应用开发平台,它完美支持私有化部署,并提供了可视化的编排界面。但在私有化环境中,如何解决模型推理资源的接入和非结构化数据的存储依然是痛点。很多企业不希望将数据传到公有云的模型接口,也不想维护复杂的存储集群。

这时,利用插件化机制扩展 Dify 的能力是一个高效的选择。通过配置 七牛云 Dify 插件,你可以轻松解决两个核心问题:利用 ai-models-provider 插件直接接入高性能的 AI 推理平台,确保算力供给;通过 storage-tools 插件接管对象存储,让 Agent 处理的文件和生成的中间数据都在你的掌控之中。这种“开源框架 + 插件增强”的模式,极大地降低了私有化部署的运维门槛。

构建一个属于自己的 Agent,不仅是技术上的尝鲜,更是对未来软件交互模式的提前布局。从 Python 代码的逻辑编排,到 MCP 协议的标准化连接,再到私有化环境下的稳健部署,每一步都需要精细的工程化考量。与其等待完美的通用 AI 出现,不如现在动手,用代码定义属于你的智能助手。