中国AI模型调用量超美国:国产大模型API成本优化指南

近期一份震撼业界的统计数据显示,中国 AI 模型调用量超美国,这一里程碑式的转折不仅意味着国内大模型生态的活跃度已达临界点,更向企业管理者释放了一个明确信号:AI 应用已从“尝鲜期”全面进入“深水区”。当调用量呈指数级增长,随之而来的便是算力成本的飙升与运维复杂度的指数级增加。对于正在寻求数字化转型的企业而言,单纯追求模型参数规模已成过去式,如何在海量调用下通过精细化运营降低 Token 成本,成为下一阶段竞争的核心命题。

告别单一依赖:构建弹性的模型组合策略

很多技术团队在初期往往习惯绑定某一家大模型厂商,但随着业务场景的多元化,这种策略的弊端日益显现。某些模型擅长逻辑推理,而另一些则在创意写作或长文本处理上更具优势。更重要的是,不同厂商的价格战此起彼伏,死守单一接口意味着错失更具性价比的选择。

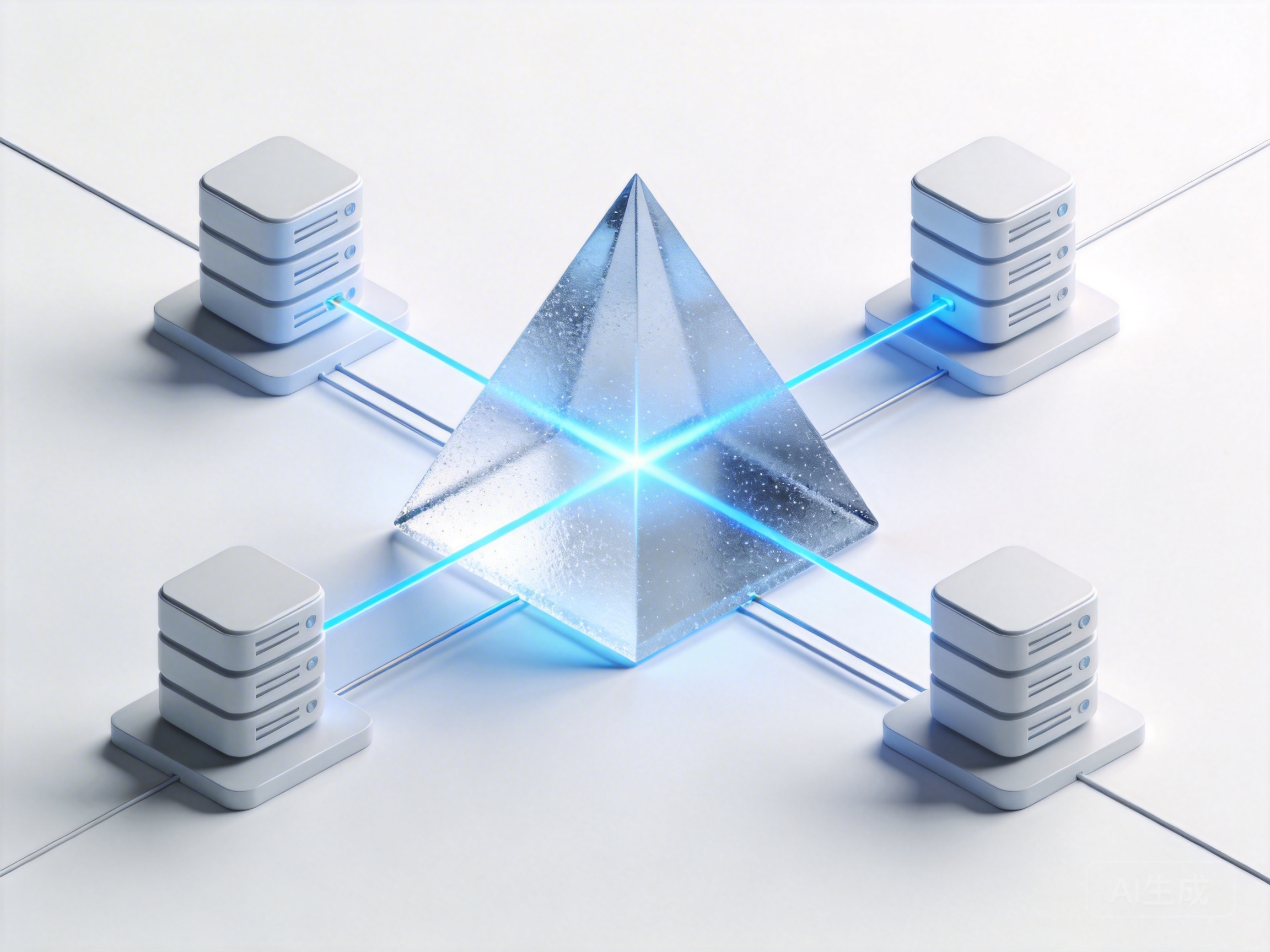

对于正在通过搜索引擎寻找“国产大模型API聚合平台哪家好”的开发者来说,核心诉求往往是兼容性与灵活性。成熟的架构设计应当引入“模型路由”机制,即根据用户意图的复杂度,动态分发请求。例如,将简单的客服问答分发给价格低廉的轻量级模型,而将复杂的代码生成任务交给高性能模型。

要实现这种灵活调度,接入标准化的聚合服务是关键一步。七牛云推出的 AI大模型推理服务 正是基于这一理念,它不仅集成了 Claude、Gemini、DeepSeek 等顶级模型,还完美兼容 OpenAI 和 Anthropic 双 API 标准。这种“全开放”策略让企业无需修改底层代码,即可在不同模型间无缝切换,真正实现算力资源的按需分配。

拒绝盲测:基于真实数据的选型与优化

在如何降低企业级AI推理成本的问题上,很多团队容易陷入误区,单纯比较官方公布的 Token 价格,而忽略了实际场景下的模型表现。一个便宜但经常产生幻觉的模型,其反复重试的成本可能远高于一个稍贵但一次成功的模型。

特别是面对 DeepSeek与MiniMax接口调用指南 这类具体的技术选型时,开发者更需要“同台竞技”的数据支撑。是选择 DeepSeek 的深度逻辑能力,还是利用 MiniMax 在角色扮演上的优势?这不应凭感觉决定。

利用七牛云提供的 AI模型对比实测 功能,开发者可以让多款国内外顶级模型在同一界面下“左右互搏”。输入相同的 Prompt,直观对比响应速度、内容质量以及 Token 消耗。这种基于实战的 A/B 测试,能帮助团队迅速筛选出最适合特定业务场景的“性价比之王”,避免在无效的算力上浪费预算。

统一管控:高并发下的密钥与配额管理

当企业内部有多个业务线同时调用 AI 能力时,高并发AI算力调度解决方案 就显得尤为重要。分散申请、分散管理的 API Key 往往导致账单混乱、额度难以监控,甚至因某个业务线的突发流量导致整体服务被限流。

为了解决这一痛点,企业需要建立统一的流量入口。通过 统一API密钥管理 服务,管理员可以一键创建兼容 OpenAI 标准的密钥,并对不同部门或项目设置独立的额度限制。这不仅能实时监控各业务线的 Token 消耗情况,还能在某个模型服务不稳定时,快速切换备用线路,确保业务的高可用性。目前,该服务还为开发者提供了最高 600 万免费 Token 的激活额度,极大地降低了企业试错和集成的门槛。

随着国产大模型在性能上不断逼近甚至超越国际顶尖水平,精细化的 API 调用策略将成为企业 AI 竞争力的分水岭。不再盲目追逐“最强”模型,而是构建“最合适”的模型组合,利用聚合平台与统一管理工具削减冗余成本,这才是应对 AI 时代流量爆发的生存之道。