模型蒸馏技术解析:降低AI推理成本的实战方案

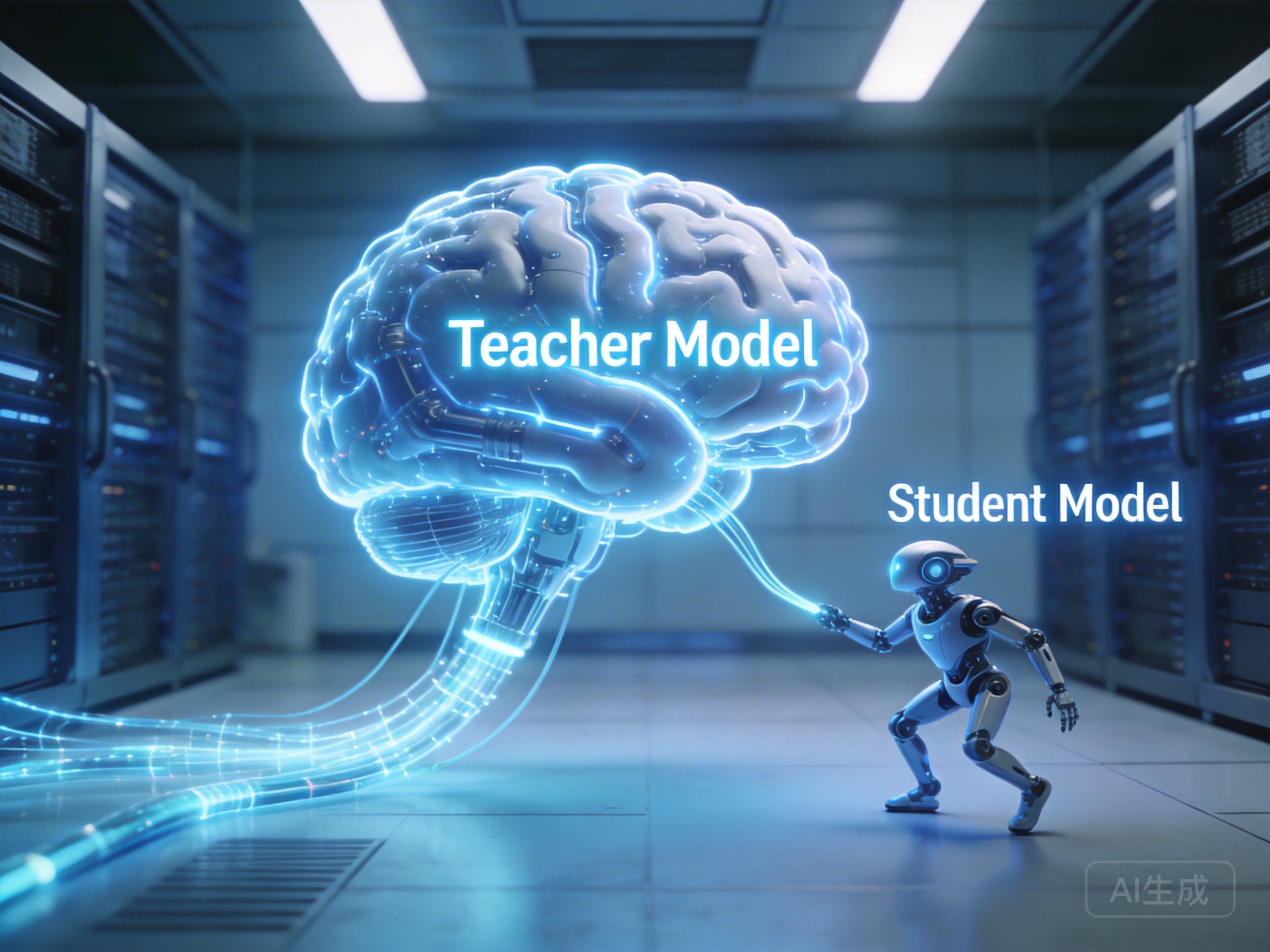

随着大语言模型(LLM)参数量的指数级膨胀,企业在享受智能红利的同时,也面临着令人咋舌的算力账单。动辄千亿参数的模型虽然效果惊艳,但每次调用的延迟与成本却让实时应用难以落地。这正是模型蒸馏技术重回大众视野的核心原因——它试图在保留大模型(Teacher)强悍能力的同时,将其“智慧”注入到更轻量的小模型(Student)中,从而在不牺牲太多性能的前提下,实现极速推理与成本骤降。

为什么选择模型蒸馏而非直接训练小模型?

很多开发者会有疑问:既然需要小模型,为什么不直接用数据训练一个小参数量的网络,而要绕弯子做知识蒸馏?

这就涉及到了“暗知识”(Dark Knowledge)的概念。直接用硬标签(Hard Label,即0或1的分类结果)训练小模型,丢失了大量信息。例如在图像识别中,一张“猫”的图片,大模型可能会输出“猫:0.9,狗:0.09,汽车:0.001”。这个“像狗但不像汽车”的信息,就是大模型学到的隐含关联。大模型知识蒸馏训练方案的核心,就是让小模型不仅学习最终答案,还要模仿大模型的思考概率分布。

这种机制使得蒸馏后的小模型,往往比直接从头训练的同尺寸模型表现更佳,泛化能力更强。对于那些希望如何通过模型蒸馏降低AI推理成本的企业来说,这不仅是压缩模型体积,更是一种高维信息的降维打击。

实战拆解:企业级私有模型蒸馏实践

在实际落地中,我们通常采用“白盒”或“黑盒”两种蒸馏策略。

白盒蒸馏适用于拥有大模型权重的情况。你不仅可以对齐输出层的概率分布(Logits),甚至可以对齐中间层的特征图(Feature Map)或注意力矩阵(Attention Map)。这种深层模仿能让小模型“学得更像”。

但在大模型时代,更多企业面临的是黑盒蒸馏场景——只能通过API获取大模型的输出。这就需要构建高质量的指令数据集。你可以利用AI大模型推理服务中集成的DeepSeek或Claude等顶级模型作为“教师”,生成复杂的推理链(Chain-of-Thought)数据,然后用这些数据去微调你的7B甚至1.5B参数的小模型。

举个电商客服的例子,直接部署70B参数的模型处理简单的“查物流”请求简直是杀鸡用牛刀。通过蒸馏,你可以训练一个专门针对客服场景的7B模型,其在特定领域的回答准确率可以逼近教师模型,但推理成本仅为原来的十分之一。这就是典型的企业级私有模型蒸馏实践,既保护了数据隐私,又实现了算力自由。

轻量化部署与加速:从训练到落地

蒸馏只是第一步,真正的挑战在于轻量化模型部署与加速。即使模型变小了,如果推理框架不给力,延迟依然不可控。

在完成蒸馏后,通常还需要结合量化(Quantization)技术,将模型从FP16压缩到INT8甚至INT4。这一步虽然会损失微乎其微的精度,但能带来2-4倍的推理速度提升。对于那些不具备复杂模型优化能力的团队,直接接入成熟的平台是更聪明的选择。比如七牛云的AI大模型推理服务,不仅支持全球主流 AI 模型的快速调用,还提供了针对不同规模模型的优化方案。

如果你的业务场景需要频繁调用多种模型进行对比或蒸馏,可以参考大模型接入指南。这里不仅有详细的API文档,还涵盖了批量推理和MCP协议应用,帮助开发者快速构建自动化的蒸馏流水线,将数据生成、模型训练与评估流程打通。

结语

模型蒸馏并非单纯的技术炫技,而是AI工程化落地的必经之路。它打破了“智能=昂贵”的刻板印象,让高性能AI应用能在边缘设备、移动端甚至浏览器中流畅运行。与其盲目追求参数规模,不如思考如何通过蒸馏技术,榨干每一分算力的价值,让你的AI应用既聪明又敏捷。对于正在探索降本增效的企业而言,现在正是启动蒸馏实验的最佳时机。