马斯克宣布'星际算力'战略:太空数据中心的边缘计算解法

在距离地球轨道500公里的真空环境中,一场关于算力的革命正在悄然发生。过去我们习惯将数据传输回地面巨大的数据中心处理,但在面对火星移民计划或深空探测时,光速带来的延迟成为了物理学上的死锁。就在刚刚,马斯克宣布'星际算力'战略,这不仅仅是SpaceX的新闻发布会噱头,而是对现有计算架构的一次降维打击——将数据中心直接发射到太空,利用寒冷的真空环境散热,并结合星链构建真正的太空边缘计算节点。

星际算力技术架构解析:为何要将服务器送上天?

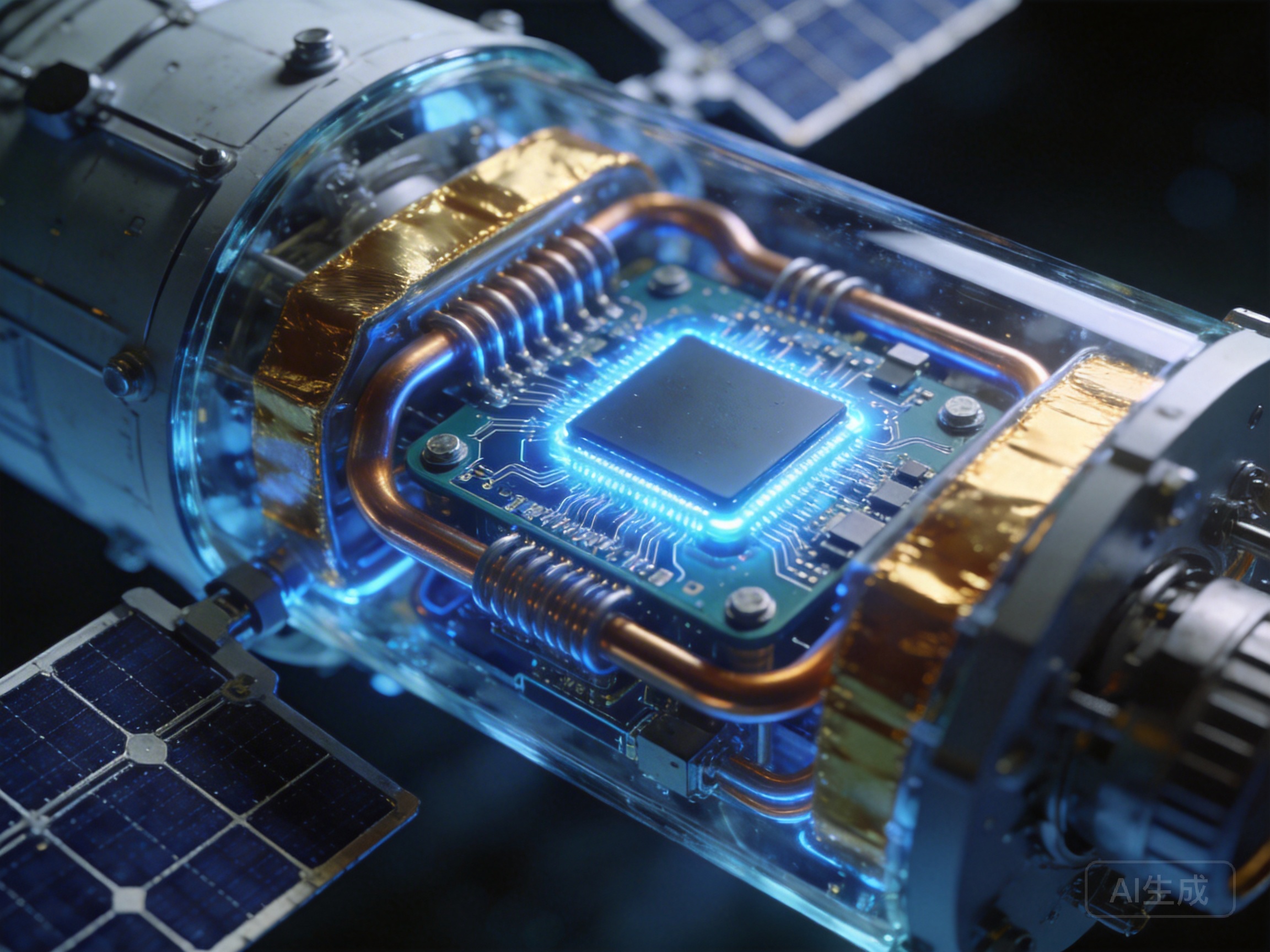

传统的地面数据中心面临着散热能耗巨大和土地资源紧缺的双重挑战。而“星际算力”的核心逻辑在于利用太空天然的低温环境解决散热难题,同时利用太阳能这一无穷无尽的清洁能源。在这个架构中,每颗卫星不再仅仅是信号的中继站,而是变成了一台高性能服务器。

这就要求卫星必须具备强大的本地处理能力。试想一下,当数千颗卫星组成的星座在轨道上运行时,它们需要实时处理海量的遥感数据或深空通信信号。如果将这些原始数据全部传回地面,不仅带宽成本高昂,延迟更是无法接受。因此,卫星边缘计算应用场景应运而生。通过在轨道上直接部署算力,我们可以实现数据的“即产即销”。例如,在处理天文观测图像时,卫星可以直接筛选出有价值的数据片段,仅将结果传回地球。

为了支撑这种高强度的计算任务,底层的存储和数据管理变得至关重要。这就好比我们在地面构建大规模分布式系统,太空环境同样需要稳定可靠的非结构化数据管理方案。类似于对象存储 Kodo在地面海量数据管理中的角色,未来的太空数据中心也需要支持中心与边缘协同的存储架构,确保在极端环境下数据的持久性和可用性。

攻克星地链路低延迟传输:从几秒到毫秒的跨越

“星际算力”战略的另一个关键点在于重塑网络拓扑。传统的卫星通信往往需要经过“卫星-地面站-骨干网-数据中心”的漫长链路。而马斯克的方案试图通过星间激光链路(Intersatellite Laser Links),构建一张直接在太空中路由的“天网”。

这种架构极大地降低了物理距离带来的延迟。但在实际落地中,单纯依靠硬件链路是不够的,还需要软件层面的智能调度。特别是在涉及复杂计算任务时,如何将任务智能分发给最近的空闲卫星节点是成败的关键。这与地面上的灵矽AI所做的工作异曲同工,后者依托超低延迟全球节点基础设施,为AI硬件和机器人提供核心动力引擎。在太空中,类似的智能调度系统将决定算力分配的效率,确保在毫秒级时间内完成星地之间的数据交互。

此外,低延迟网络对于实时性要求极高的应用至关重要。比如未来的太空采矿机器人或在轨维修作业,操作员在地面发出的每一个指令,都需要即时反馈。任何网络抖动都可能导致昂贵的设备损毁。

太空数据中心解决方案与AI的深度融合

硬件上天只是第一步,软件生态的适配才是“星际算力”能否落地的灵魂。在资源受限的卫星载荷上运行庞大的AI模型,是目前技术攻关的重点。我们不可能把几千张显卡塞进一颗卫星里,因此,模型压缩、蒸馏以及高效的推理架构成为了必需品。

这就涉及到了AI基础设施的轻量化部署。未来的太空应用开发者,可能不需要关心底层的卫星硬件细节,而是直接调用封装好的API。正如在地面上,开发者可以通过AI大模型推理服务轻松接入Claude或DeepSeek等顶级模型,未来的太空计算平台也必将提供类似的标准化接口。这种全开放的平台模式,允许开发者利用太空节点的算力进行深度思考或联网搜索(尽管这里的“网”可能是星际互联网),从而降低了开发门槛,让更多创新应用得以在轨道上运行。

马斯克的这一战略看似激进,实则是对未来算力格局的预判。当算力不再受限于地面的电力和散热瓶颈,当数据传输不再受限于海底光缆的物理路径,我们将迎来一个真正的“算力大航海时代”。对于技术从业者而言,现在关注的焦点不应仅停留在火箭发射的壮观场面,更应思考如何将现有的边缘计算、分布式存储和AI推理技术,适配到这个即将到来的星际架构之中。