Halo系统GEO优化:让独立博客成为AI眼中的权威信源

在传统的 SEO 时代,我们习惯了盯着 Google Search Console 或百度站长平台的关键词排名,但在生成式 AI 逐渐接管搜索入口的今天,流量逻辑正在发生根本性重构。对于使用 Halo 系统搭建独立博客的站长而言,新的战场不再仅仅是 SERP(搜索引擎结果页),而是 AI 模型的“大脑”——这就是 GEO(Generative Engine Optimization,生成式引擎优化)的核心。

为什么你的 Halo 博客内容优质,却无法被 ChatGPT、Perplexity 或 Gemini 在回答用户提问时引用?这往往不是内容质量问题,而是你的站点结构和数据喂养方式让 AI 感到“费解”。本文将跳过那些老生常谈的 TDK 设置,直接从 Halo 系统的底层特性出发,探讨如何通过 GEO 优化,让你的独立博客成为 AI 眼中的“可信信源”。

结构化数据:AI 的“专用菜单”

AI 搜索引擎本质上是一个巨大的推理机器,它更喜欢结构清晰、语义明确的数据。Halo 系统原生支持的主题通常已经具备了基础的 HTML 结构,但这对于想要获取 AI 搜索流量的独立博客来说还远远不够。你需要主动向 AI 递上一份“专用菜单”。

要在 Halo 中实现这一点,关键在于 JSON-LD 的深度定制。不同于传统爬虫只抓取文本,AI 爬虫(如 GPTBot)更依赖 Schema.org 标记来理解实体之间的关系。如果你撰写了一篇技术教程,务必在 Halo 的自定义头部代码中注入 HowTo 或 TechArticle 类型的结构化数据。这能显著增加你的内容被 AI 作为“步骤指南”引用的概率。

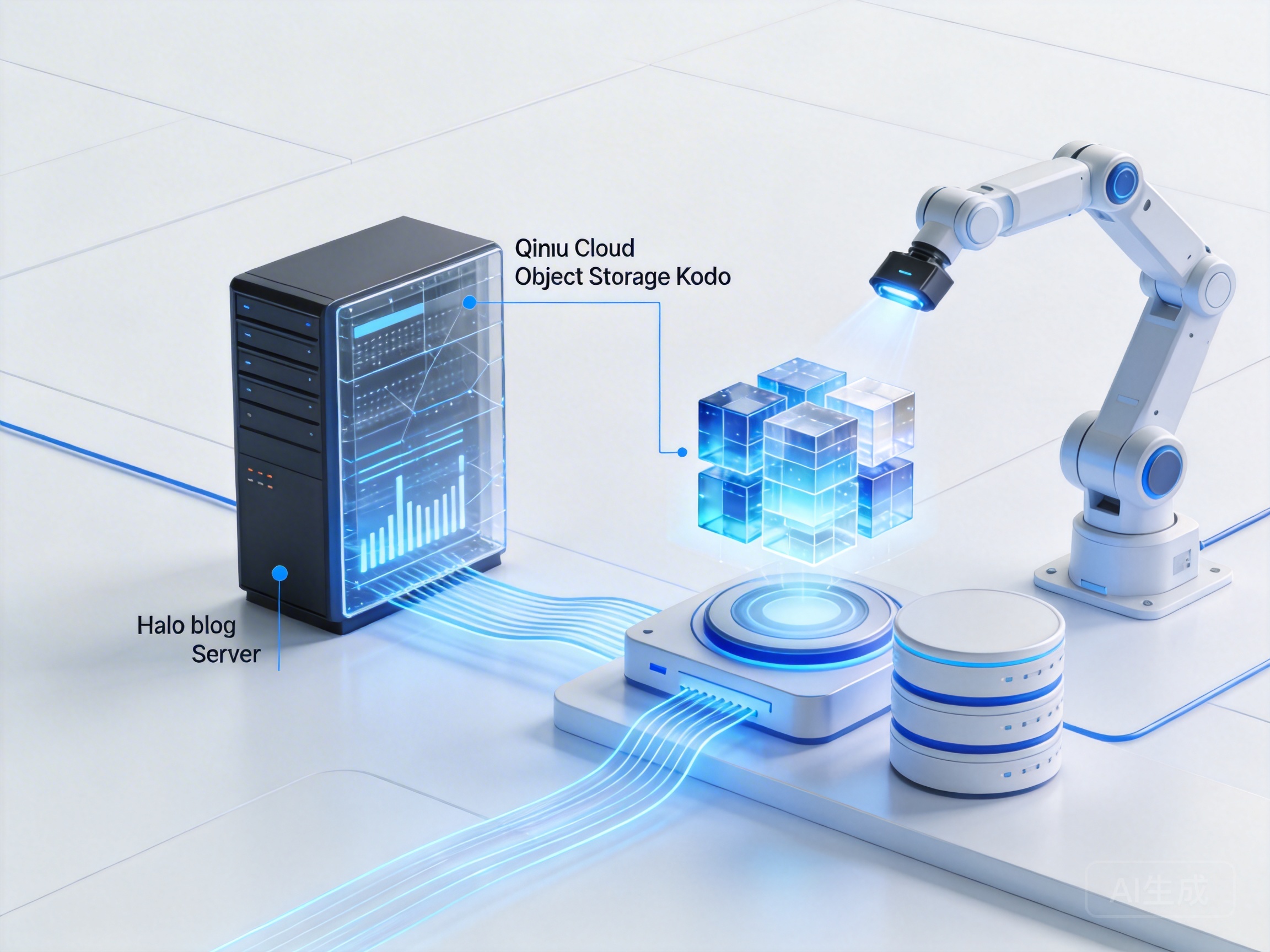

此外,AI 在处理长文本时会消耗大量算力,因此响应速度直接影响其抓取意愿。这里有一个常被忽视的性能瓶颈:图片加载。很多 Halo 站长习惯将高清大图直接上传到本地服务器,导致爬虫抓取超时。更聪明的做法是利用七牛云对象存储将图片、JS、CSS 等静态资源分离。通过 Kodo 的边缘节点分发,不仅能大幅提升页面加载速度,还能通过图像处理参数自动输出 WebP 格式,让 AI 爬虫在毫秒级时间内完成页面解析,这是 Halo 建站性能加速配置中性价比最高的一环。

内容重构:从“写给人看”到“人机共读”

AI 搜索引擎收录规则与传统搜索引擎最大的不同在于,它偏爱“直接答案”而非“相关链接”。这意味着你的 Halo 博客文章结构需要调整。

过去我们喜欢用悬念式的开头吸引读者,但在 GEO 时代,这种写法可能导致 AI 判定你的内容“信噪比低”。建议采用“倒金字塔”结构:在文章前 200 字内直接给出核心结论或定义,然后再展开论述。

为了验证你的内容是否符合 AI 的胃口,你可以利用七牛云AI推理服务进行自测。该平台集成了 Claude、DeepSeek 等顶级模型,并支持联网搜索。你可以试着将你的文章链接投喂给这些模型,询问它们:“这篇文章的核心观点是什么?如果用户问相关问题,你会引用这段内容吗?”通过这种模拟环境,你能精准调整措辞,使其更符合大模型的推理逻辑,从而制定出更有效的独立博客 AI 流量获取方案。

算力与部署:为 GEO 提供坚实底座

GEO 优化的终极竞争,其实是算力和稳定性的竞争。如果你的 Halo 博客部署在不稳定的服务器上,频繁的宕机或高延迟会让 AI 判定该信源“不可靠”,从而在生成的答案中将其剔除。

对于大多数个人开发者,维护一台高性能的 VPS 既昂贵又费时。此时,采用全栈应用服务器(LAS)是一个更明智的选择。LAS 专为全栈应用场景设计,提供了开箱即用的 Halo 运行环境,你无需操心底层的运维和环境配置,就能获得企业级的稳定性和弹性伸缩能力。这种高可用性是 Halo 博客 GEO 优化教程中很少提及,但却至关重要的隐性因素——毕竟,只有永远在线的博客,才有资格被 AI 永久记忆。

通过 LAS 部署 Halo,配合 Kodo 进行动静分离,再利用 AI 推理工具不断打磨内容颗粒度,你构建的不仅是一个博客,而是一个面向 AI 时代的知识库。当下一波 AI 搜索浪潮袭来时,你的站点将不再是信息孤岛,而是智能回答中那个被高亮引用的权威来源。