企业级AI多模型兼容与Copilot升级实战方案

面对大模型迭代速度的狂飙,仅依赖单一模型的业务系统正面临严重的架构僵化风险。当GPT-4、Claude 3.5、DeepSeek等顶尖模型在不同维度各领风骚时,如何打破API壁垒,构建一个高可用、可扩展的底座,成为技术团队的核心挑战。对于正在规划智能化转型的团队而言,构建真正意义上的企业级AI架构,关键在于解耦业务逻辑与底层模型,让系统具备自我进化的弹性。

大模型自由切换调用架构设计

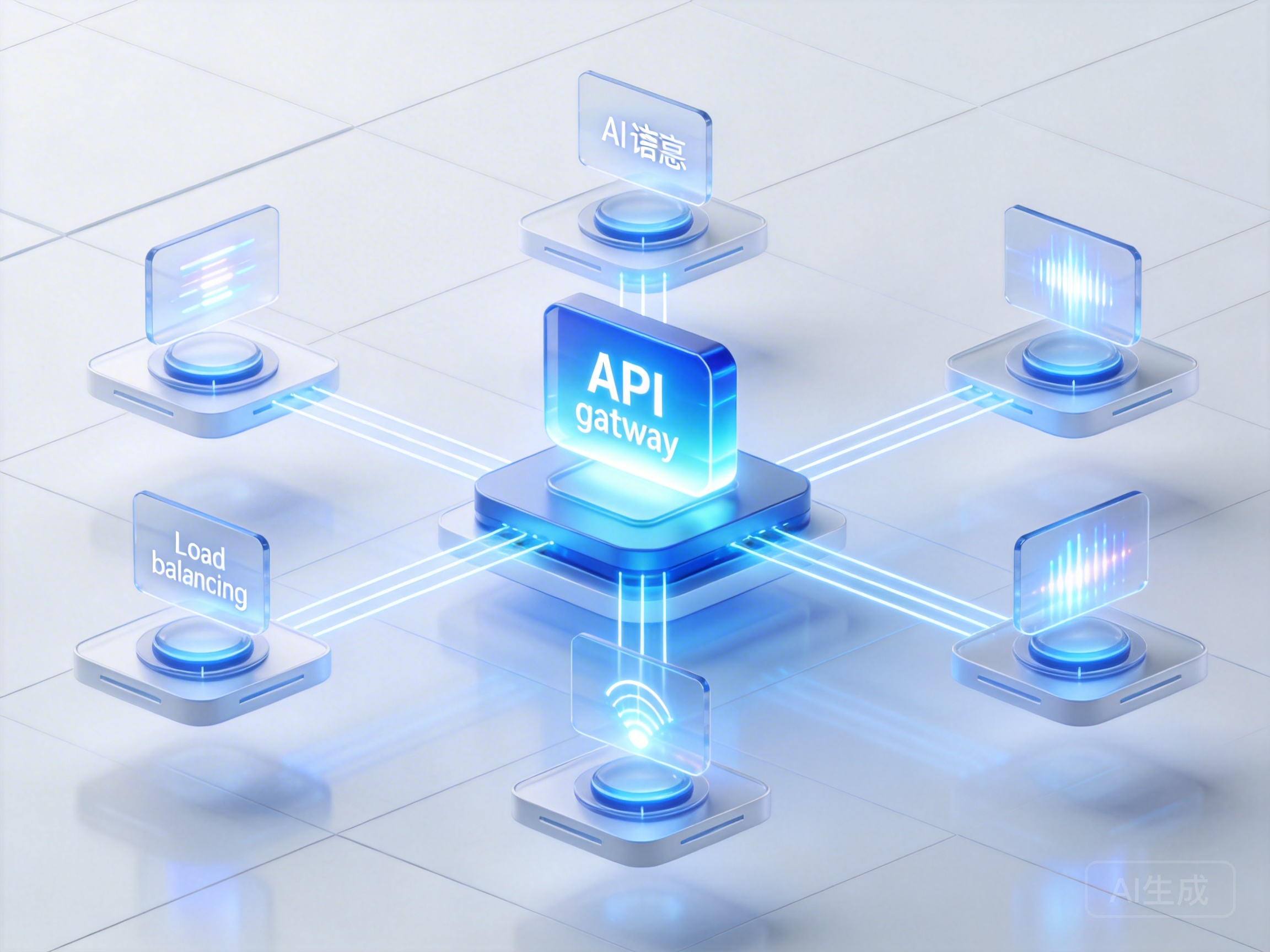

传统的点对点直连模式在引入新模型时,往往需要耗费大量工时进行接口适配、参数对齐和错误码重写。现代化的统一网关层设计能够彻底改变这一现状。通过抽象出标准的请求与响应协议,系统可以在不修改业务代码的前提下,动态路由到最合适的推理节点。

在构建这种高内聚低耦合的架构时,选择兼容性强大的基础设施尤为关键。例如通过接入七牛云AI推理服务,开发者可以直接利用完美兼容OpenAI与Anthropic双API的标准接口,实现国内外数十种顶尖大模型的无缝对接。这种设计不仅抹平了不同厂商之间的协议差异,还通过统一的鉴权和限流机制,大幅降低了系统的运维复杂度,为后续的业务扩张预留了充足的弹性空间。

Copilot智能体多模型升级教程

现有的企业内部Copilot系统通常深度绑定了特定厂商的接口,这在处理跨领域复杂业务流时极易遇到性能瓶颈。要完成Copilot升级,核心步骤是将静态的单向API调用,改造为基于意图识别的动态代理调度模式。

开发者需要在智能体的中枢模块建立一个模型能力矩阵。当接收到用户指令时,系统首先进行意图分类和复杂度评估。例如,当识别到代码编写或复杂逻辑重构任务时,网关自动将上下文路由至Claude 3.5 Sonnet;而遇到海量数据清洗或日常问答时,则快速切换至DeepSeek或MiniMax等高性价比模型。这种多模型兼容机制让Copilot具备了动态适配任务的能力,不仅提升了复杂任务的完成率,还有效控制了整体Token消耗。

企业多模型AI高效部署方案

技术架构的底层升级最终要服务于业务层面的降本增效。在实际的生产环境部署中,不同业务线对AI算力的诉求差异巨大。客服部门需要毫秒级的极低延迟,研发部门追求极致的推理深度,而市场部门则看重多模态的图文生成能力。

通过建立一套完善的评估与调度机制,团队可以彻底打破厂商锁定,实现真正的模型自由选择。架构师可以在同一平台上横向对比各家模型的响应速度、并发承载力与Token消耗成本。将高频且容错率高的简单任务路由给轻量级模型,将长文本解析与深度思考任务交给大参数模型。这种精细化的流量切分与算力调度策略,是当前解决企业AI算力成本高昂的最优解。

解决如何实现企业级AI多模型兼容的核心痛点,本质上是为业务构建一个面向未来的技术保险。不要让底层单一模型的局限性成为业务创新的天花板。尽早引入统一的路由网关与多模型动态管理机制,才能在日新月异的技术浪潮中保持灵活的竞争身段,让智能化真正转化为可度量的生产力。