大模型推理时遇到Token超限报错怎么优化API调用?实战排查与架构设计

当开发者将基于大语言模型的应用推向生产环境时,最让人头疼的往往不是模型不够聪明,而是突如其来的服务中断。特别是在处理长文档摘要或多轮复杂对话时,系统频频抛出错误提示,导致用户体验大打折扣。那么,大模型推理时遇到Token超限报错怎么优化API调用?这不仅仅是一个简单的代码修复问题,更涉及底层架构的健壮性与上下文管理策略。

遇到此类问题,我们需要精准定位是并发过高引发的限流,还是单次请求携带的数据量撑爆了模型的上下文窗口。针对这两种截然不同的场景,开发者需要建立一套从请求拦截、数据瘦身到自动重试的完整机制。

精准排查:如何解决大模型API调用429 Token超限错误

在排查阶段,我们需要明确区分 HTTP 429 错误和 HTTP 400 错误。429 错误通常意味着触发了服务商的 TPM(每分钟 Token 数)或 RPM(每分钟请求数)限制。这在业务高峰期或进行批量并发处理时极为常见。为了彻底弄清大模型API Token超限报错排查与解决的底层逻辑,我们需要引入完善的监控面板。

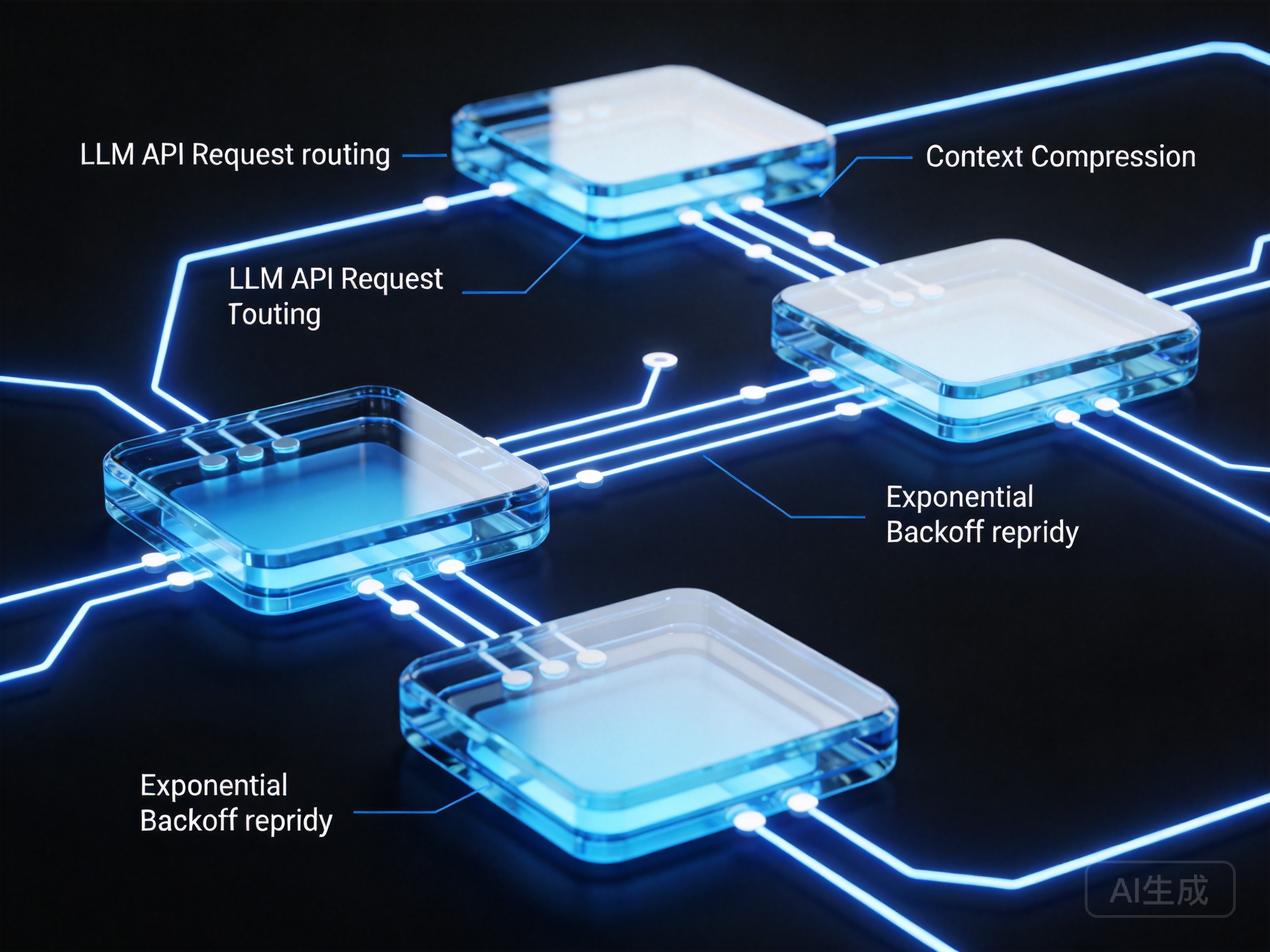

针对并发限流,硬编码的等待时间往往无法适应动态的网络环境。我们需要设计大模型高并发调用架构与请求重试策略教程中常提到的指数退避(Exponential Backoff)算法。当捕获到 429 状态码时,系统不应立即重试,而是按照 1秒、2秒、4秒、8秒的指数级时间间隔进行休眠重发,并配合随机抖动(Jitter)防止重试风暴。同时,对于企业级应用,统一管理密钥资源是前提。开发者可以通过申请 七牛云API key 来获取兼容 OpenAI 接口标准的端点,利用其提供的高并发额度池,从根源上缓解因单点并发不足导致的限流问题。

数据瘦身:长文本AI推理Token瘦身与上下文压缩方案

如果错误码是 400 且提示上下文超出模型最大长度(如超过 32K 或 128K),则属于单次请求的数据量过载。此时,简单的重试毫无意义,必须在发送请求前对数据进行干预。长文本推理上下文压缩与Token瘦身技巧是优化此类问题的核心。

第一种有效手段是滑动窗口机制。在多轮对话中,用户往往只关心最近几轮的上下文。系统可以设定一个阈值(如保留最近 5 轮对话),自动丢弃早期的对话历史。

第二种手段是引入 RAG(检索增强生成)架构。不要把整篇长文档直接塞给大模型,而是先将其进行向量化切块。当用户提问时,通过向量数据库检索出最相关的几个文本块,再拼接成 Prompt 发送。这种长文本AI推理Token瘦身与上下文压缩方案不仅能彻底解决超限问题,还能大幅降低 Token 消耗成本。

架构升级:七牛云大模型API高可用调用策略设计

在完成了基础的重试和压缩之后,我们需要从全局视角构建高可用架构。一个健壮的 AI 代理层应该具备多模型路由和请求降级的能力。

七牛云大模型API高可用调用策略设计的精髓在于多路复用与智能回退。当主干模型(如参数量极大的旗舰模型)因 Token 超限或网络抖动拒绝服务时,网关层可以自动将请求降级到上下文窗口更大、响应更快的备用模型。为了实现这种复杂的路由逻辑,建议开发团队深入研读 AI大模型推理服务使用文档,了解如何利用批量推理和多模态协议构建弹性代理层。通过合理的限流器(Rate Limiter)配置,在客户端和服务端之间建立缓冲区,削峰填谷,确保整体服务的平稳运行。

解决 Token 超限报错并非一劳永逸,它要求开发者在成本、性能与可用性之间找到最佳平衡。通过精准的错误捕获、智能的上下文压缩以及高可用的重试架构,我们完全可以将这些恼人的报错转化为系统自我优化的契机,为用户提供丝滑的 AI 交互体验。