告别高昂账单:如何根据任务复杂程度自动切换不同的大模型以降低API成本的工程实践

企业在接入生成式大语言模型时,往往会面临一个棘手的账单难题:为了保证业务效果,所有请求全部指向顶级模型,导致成本呈指数级飙升;若全部切换为开源小模型,又无法处理复杂的逻辑推理。打破这种两难局面的关键,在于掌握如何根据任务复杂程度自动切换不同的大模型以降低API成本。这种多模型智能路由调度机制,正成为现代AI工程化不可或缺的一环。

高低复杂度任务的大模型意图识别教程

实现自动切换的第一步是精准评估任务难度。并非所有用户输入都需要深度思考。例如,日常的寒暄、简单的文本翻译或格式化提取,百亿参数的轻量级模型即可瞬间完成;而涉及长文本逻辑推演、代码生成或多步规划的任务,则必须依赖千亿参数的旗舰模型。

在实际开发中,我们通常会引入一个“前置路由器”。这个路由器可以由一个极低成本、极高响应速度的模型担任,专门负责意图分类。它通过预设的Prompt模板,为用户请求打上“简单”、“中等”或“复杂”的标签。如果开发者对各类模型的表现边界尚不清晰,可以通过系统的模型对比工具,将相同提示词输入不同参数量级的模型中进行同屏竞技,以此建立准确的分类阈值。

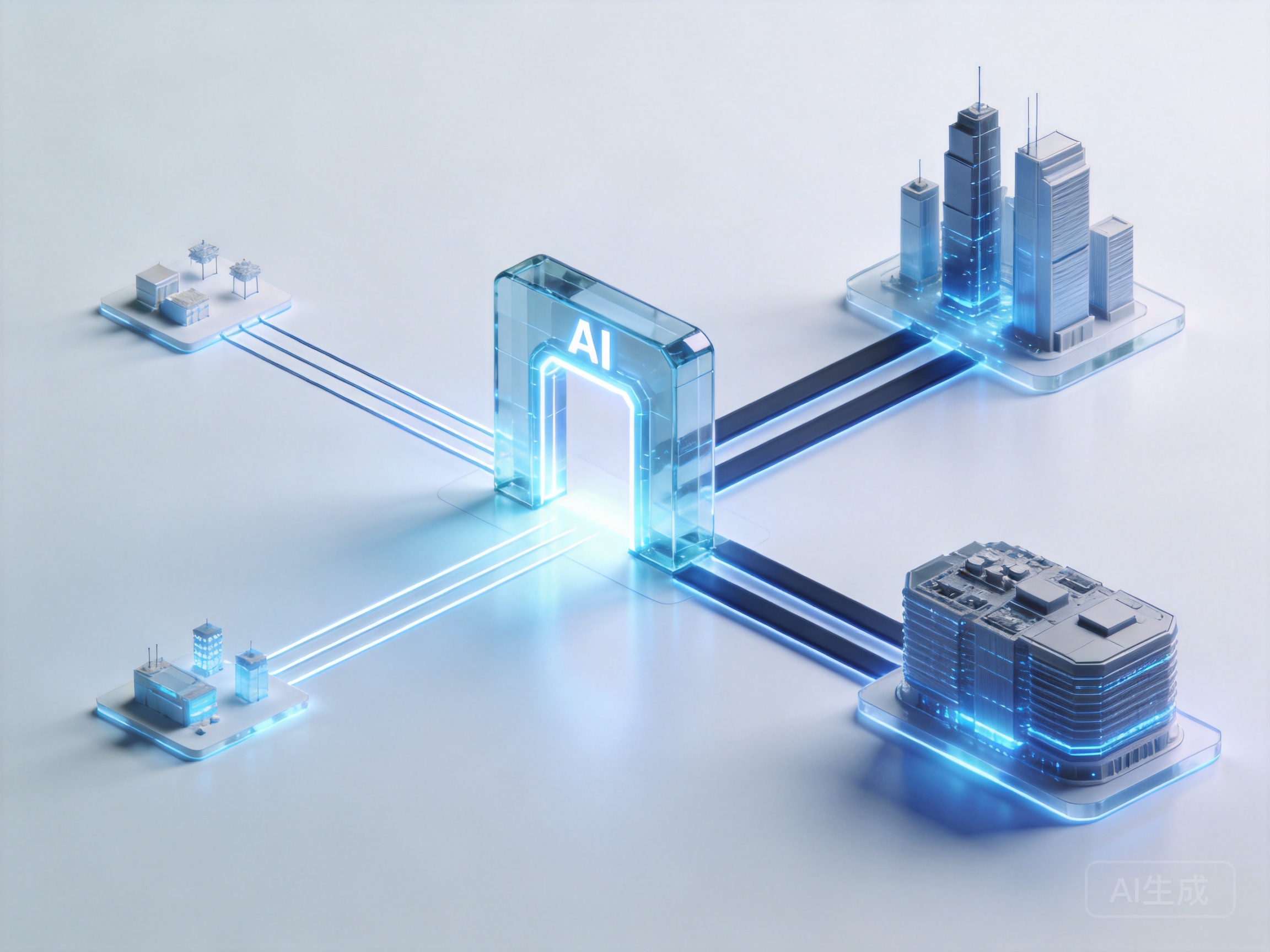

如何构建大模型API智能路由网关

解决分类问题后,下一步是工程架构的落地。AI应用多模型聚合接入需要一个稳健的中间层,也就是智能路由网关。网关的核心职责是接收前端请求,解析分类标签,并将流量转发至对应的后端模型接口。

在设计多模型自动切换的并发处理与延迟优化方案时,开发者需要特别关注冷启动和超时重试机制。当高并发请求涌入时,网关应具备流控能力,对复杂请求进行异步处理或队列排队,同时保障简单请求的毫秒级响应。为了降低多平台接入的运维负担,企业通常需要一个统一的密钥管理入口。开发者可以通过获取七牛云API key,实现对OpenAI、Anthropic标准接口的完美兼容,一键调用全栈AI能力,避免在多个服务商之间频繁切换和维护复杂的鉴权逻辑。

企业级AI智能体工作流多模型调度实践

在更复杂的业务场景中,单次请求的路由已经演变为多节点的工作流调度。在一个完整的AI Agent链路里,信息检索、意图拆解、代码执行、最终总结等环节所需的智能水平截然不同。

有效的大模型API成本管控方案要求我们在工作流的每个节点都精打细算。例如,在资料搜集节点调用低成本模型进行海量网页的摘要提取,在核心推理节点切换至旗舰模型进行决策,最后再交由轻量级模型进行话术润色。依托强大的七牛云AI推理服务,开发者可以在同一个平台上流畅地组合这些顶级模型,利用平台提供的联网搜索和深度思考能力,构建出既聪明又省钱的复合型智能体。

构建动态路由调度的核心不在于盲目追求最前沿的模型,而是让算力在最需要的地方发挥价值。通过建立完善的意图识别、部署统一的路由网关以及优化工作流调度,企业完全可以在不牺牲用户体验的前提下,将整体API成本压缩至原来的三分之一甚至更低。开始审视你的业务请求日志,为它们分级,是迈向精细化AI运营的第一步。