国产 OpenClaw 深度盘点:Linclaw 完整评测(2026 年 )

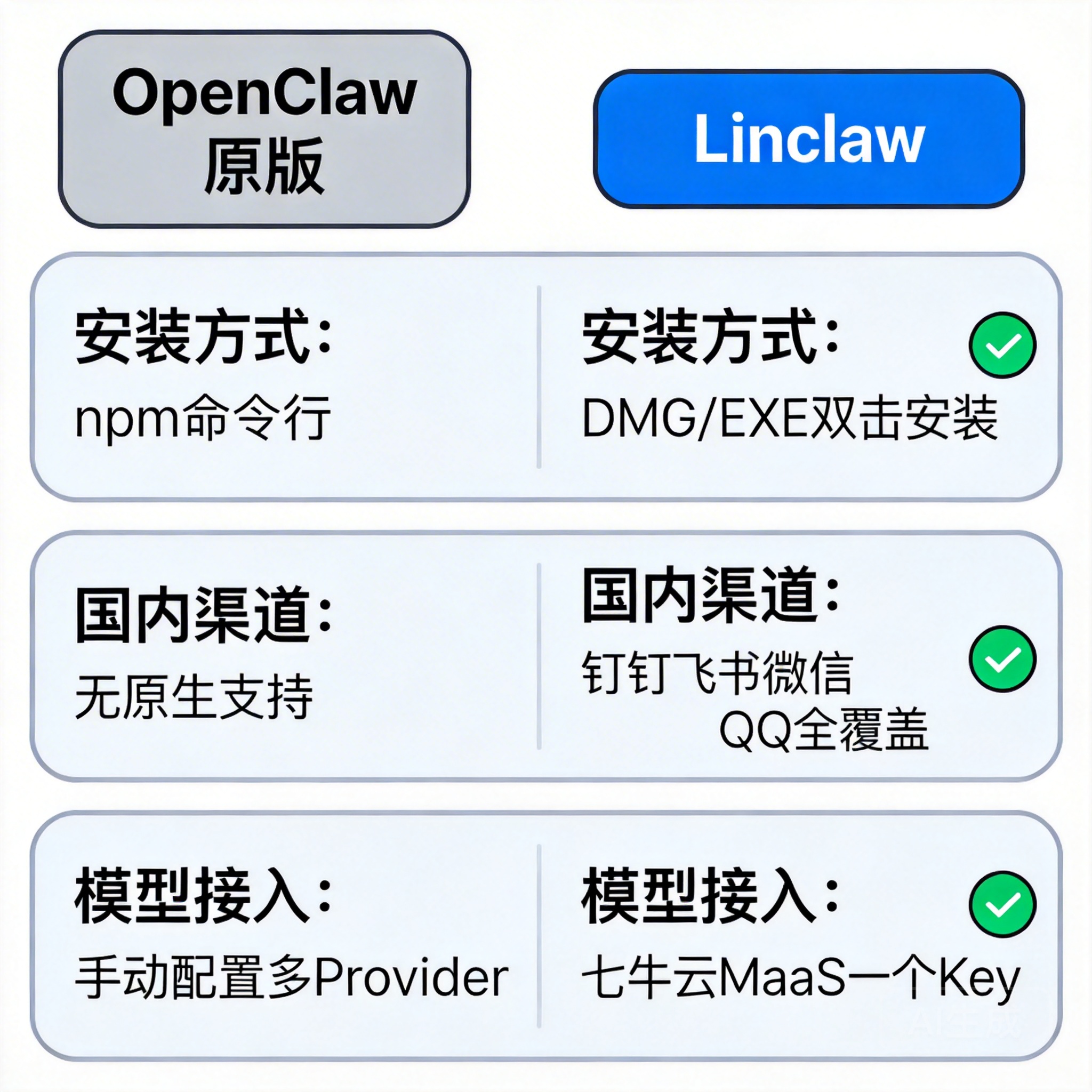

Linclaw 是七牛云基于 OpenClaw 开源生态推出的国产桌面版 AI 个人助理,定位于"让 AI 真正替你做事"——覆盖钉钉、飞书、QQ、微信、Discord、Telegram、Slack、iMessage、Web 共 9 大渠道,macOS 和 Windows 双端安装包分发,无需 Node.js 环境,MIT 开源协议支持私有部署。与 OpenClaw 原版相比,Linclaw 的核心差异在于:将部署复杂度降至零、将国内主流渠道提升为一等公民、并通过七牛云 MaaS 统一解决国内模型接入问题。本文从产品定位、技术架构、渠道接入、模型配置、实际体验、横向对比六个维度对 Linclaw 进行完整盘点。

产品定位:OpenClaw 的国内落地版

Linclaw 解决的核心问题

OpenClaw(309,000 Stars)是全球最受欢迎的个人 AI 助手框架,但其在国内落地面临三个系统性障碍:

障碍 1:部署门槛

OpenClaw 要求 Node.js ≥22,通过命令行安装向导完成配置,Windows 用户还需要 WSL2。对于非技术用户,仅环境配置就可能耗费数小时,遇到权限错误(EACCES)或 native 依赖问题(SIGBUS)更是难以自行解决。障碍 2:渠道缺失

OpenClaw 原版的 20+ 渠道以 WhatsApp、Signal、Discord、Telegram 等国际平台为主,不原生支持微信、钉钉、飞书、QQ 四个国内日活最高的即时通讯平台,需要第三方插件或自行开发适配层。

障碍 3:模型接入不便

OpenClaw 针对 OpenAI/Anthropic 接口优化,接入 DeepSeek、Kimi、GLM、MiniMax 等国内主流模型需要手动配置 baseURL,且部分接口存在兼容性问题(如 Kimi 的 web_search 参数冲突)。

Linclaw 的解决路径:

技术架构解析

核心技术栈

Linclaw 基于以下技术构建:

智能体框架:AgentScope(阿里开源的多 Agent 框架)的 ReAct(Reasoning + Acting)循环架构。ReAct 架构将 AI 的推理过程(Reasoning)与工具调用(Acting)交替进行,使 Agent 能够:

● 分析用户意图

● 选择合适工具执行

● 观察执行结果

● 根据结果调整下一步行动

这套架构使 Linclaw 可以完成需要多步骤工具调用的复杂任务,而非仅仅回答单轮问题。

模型服务层:七牛云 MaaS(Model as a Service)。MaaS 层负责:

● 统一管理多个模型 Provider 的 API Key

● 提供 OpenAI 兼容接口(https://api.qnaigc.com/v1),可无缝接入所有支持 OpenAI 格式的框架

● 同时兼容 Anthropic API 格式,支持 Claude Code 配置

定时任务引擎:APScheduler(Python 生态主流调度库),支持标准 Cron 表达式,精确到秒级触发。与 OpenClaw 原版内置 Cron 系统相比,APScheduler 在 Python 环境下更稳定,且与 AgentScope 深度集成。

渠道网关:多渠道统一消息路由层,将钉钉 Webhook、飞书 Event、微信 Web 协议、Telegram Bot API 等不同协议的消息统一转化为 Agent 可处理的标准格式。

内置工具集(4 大工具,开箱即用):

● Shell 执行:执行任意 bash/PowerShell 命令,返回输出结果

● 文件操作:读写、创建、删除文件,支持目录遍历

● 浏览器控制:无头 Chrome/Chromium 自动化,支持截图、表单填写、页面抓取

● 截图工具:桌面截图,可结合视觉模型(Vision LLM)进行屏幕内容分析

MCP 协议接入层

Linclaw 兼容 Model Context Protocol(MCP),可将第三方工具以 MCP Server 形式接入:

# Linclaw MCP 配置示例

mcp_servers:

- name: github

command: npx

args: ["-y", "@modelcontextprotocol/server-github"]

env:

GITHUB_TOKEN: "你的github-token"

- name: database

command: npx

args: ["-y", "@modelcontextprotocol/server-sqlite"]

通过 MCP,Linclaw 可接入 GitHub、Jira、数据库、Notion 等 200+ 工具,扩展能力与 OpenClaw 原版相当。

记忆管理系统

Linclaw 内置多轮记忆 + 智能压缩机制:

● 短期记忆:保留对话上下文,支持多轮连续对话

● 长期记忆:将重要信息持久化存储,跨会话保持

● 自动压缩:当上下文超过模型 Token 限制时,自动压缩历史对话,保留关键信息同时降低 Token 消耗

安装配置全流程

桌面端安装(推荐)

macOS(要求 macOS 14+,Intel 和 Apple Silicon 均支持):

1. 从 Linclaw 官网下载 .dmg 安装包

2. 双击打开,将 Linclaw.app 拖入 Applications 文件夹

3. 从启动台(Launchpad)打开 Linclaw

4. 首次启动进入配置向导

Windows(要求 Windows 10+ 64位):

1. 从官网下载 .exe 安装包

2. 双击运行安装程序

3. 从开始菜单打开 Linclaw

4. 首次启动进入配置向导

⚡ 与 OpenClaw 原版最大的区别在于:Linclaw 无需安装 Node.js、无需命令行操作、无需 WSL2。整个安装过程与普通桌面应用完全相同。

源码部署(服务器 / 私有化)

# 克隆仓库

git clone https://github.com/linclaw/linclaw # 替换为实际仓库地址

cd linclaw

# 安装 Python 依赖

pip install -e ".[all]"

# 5 分钟快速上线

python -m linclaw.server --config config.yaml

源码部署适合:企业内网私有化部署、需要接入本地 Ollama 模型的场景、以及需要二次开发或深度定制的开发者。

七牛云 MaaS 模型接入详解

支持的模型范围

七牛云 MaaS 汇聚全球主流 AI 模型,覆盖:

● 国内模型:DeepSeek 系列、Kimi(moonshot)系列、GLM 系列(智谱 AI)、MiniMax 系列

● 国际模型:Claude 系列(Anthropic)、GPT 系列(OpenAI)、Gemini 系列(Google)

新用户福利:注册即送 300 万全模型免费额度资源包,适合评估期使用。

API 接入配置

七牛云 MaaS 兼容 OpenAI API 格式:

# Python SDK 调用示例

from openai import OpenAI

client = OpenAI(

api_key="你的七牛云api-key",

base_url="https://api.qnaigc.com/v1"

)

response = client.chat.completions.create(

model="deepseek-chat", # 切换模型只需修改此参数

messages=[{"role": "user", "content": "你好"}]

)

// Linclaw 配置文件中切换模型

{

"model": {

"provider": "qiniu-maas",

"model_name": "kimi-k2.5", // 改为 deepseek-chat / glm-4 等

"api_key": "你的七牛云api-key",

"base_url": "https://api.qnaigc.com/v1"

}

}

七牛云 MaaS 同时兼容 Anthropic API 格式,可直接用于 Claude Code 配置。

9 大渠道深度解析

渠道接入难度对比

国内渠道重点说明

钉钉:支持创建自定义机器人,通过 Webhook + 签名验证接入。企业内部部署场景下,可接入企业通讯录,实现员工 @ 机器人问答。配置步骤:钉钉管理后台 → 机器人管理 → 自定义机器人 → 填入 Webhook URL 和安全密钥。

飞书:通过飞书开放平台创建应用,获取 App ID 和 App Secret。飞书机器人支持富文本卡片回复,适合企业内部知识问答、报表推送等场景。官方 API + SLA 保障,是企业场景最推荐的渠道。

微信:通过 Web 协议接入个人微信,属于非官方方式,与市面上所有微信机器人方案相同,存在被封号风险。企业场景建议优先使用企业微信或钉钉飞书。个人效率场景可谨慎使用,避免在群聊中高频发消息。

QQ:支持个人 QQ 和 QQ 频道两种接入方式。QQ 频道接入使用官方 Bot API,稳定性更高;个人 QQ 接入基于协议,稳定性相对较弱。

与其他国产 OpenClaw 横向对比

当前国内已有多个厂商推出 OpenClaw 版本,以下是完整对比:

选型速查:

● 个人用户,需要接入微信 + 多渠道 → Linclaw

● 企业,飞书是主力工作平台 → ArkClaw

● 只需要微信,不想配置 → QClaw

● 自行开发定制技能,技术团队 → OpenClaw 原版

核心优势与局限性

Linclaw 的核心优势

① 零部署体验

这是 Linclaw 最显著的竞争优势。相较于 OpenClaw 原版需要处理 Node.js 版本、npm 全局权限、launchd/systemd 守护进程注册等复杂配置,Linclaw 将所有这些封装在桌面安装包内。用户不需要了解任何后台机制,即可获得与 OpenClaw 相同的 AI 助手能力。② 国内渠道一等公民

钉钉、飞书、QQ、微信不是后补的插件,而是 Linclaw 从立项之初就原生支持的渠道。这意味着渠道的消息格式解析、富文本卡片支持、群组权限管理等细节都经过针对性优化,而非通用插件的降级体验。③ 七牛云 MaaS 统一管理

通过七牛云 MaaS,用户只需配置一个 API Key 就能调用 DeepSeek、Kimi、GLM、MiniMax 等多个国内主流模型。这比在 OpenClaw 中分别为每个 Provider 维护独立 API Key 和 baseURL 要简单得多,也降低了因单一 Provider 触发限速或服务中断的风险。④ 无守护进程问题

OpenClaw 的 launchd/systemd 守护进程是一大痛点——卸载不干净、更新后版本不匹配、权限错误等问题集中于此。Linclaw 作为标准桌面应用,进程生命周期由操作系统应用管理器统一控制,用户体验与任何普通桌面软件相同。Linclaw 的局限性

① 技能生态规模

OpenClaw 原版通过 ClawHub 市场累积了 5,400+ 社区技能,而 Linclaw 基于 MCP 协议扩展,支持 MCP 标准的工具可接入,但原生 OpenClaw 技能(非 MCP 格式)需要手动适配。对于需要大量社区技能的用户,OpenClaw 原版仍有优势。② 深度定制灵活性

桌面安装包降低了部署门槛,但也限制了底层定制空间。需要修改 Gateway 源码、自定义消息路由逻辑、或接入企业内网私有 LLM 的场景,OpenClaw 原版的命令行架构提供了更多灵活性(Linclaw 的 pip 安装方式可部分弥补此限制)。③ 微信渠道风险

微信个人号接入基于非官方 Web 协议,封号风险与市面上所有微信机器人方案相同。企业场景建议以飞书、钉钉为主力渠道,微信作为补充。

数据安全与私有部署

Linclaw 采用本地优先架构,具体安全机制:

● 对话数据不中转:模型 API 调用直接从用户本机发出,七牛云 MaaS 层仅作为模型推理节点,不保存对话内容

● 渠道凭证本地存储:飞书 App Secret、钉钉 Token 等仅存储在本地配置文件,不同步至云端

● 私有部署支持:通过 pip 安装源码后,可完全使用本地 Ollama 模型,配合企业内网部署,全程数据不出内网

● 代码可审计:MIT 开源协议,源码完全公开,无隐藏数据上传逻辑

企业私有部署最小化配置:

# 全内网部署,不依赖外部服务

model:

provider: ollama

base_url: "http://内网ollama服务器IP:11434/v1"

model_name: "qwen3:14b"

api_key: "ollama"

channels:

feishu:

app_id: "cli_xxx"

app_secret: "xxx"

network:

proxy: "http://内网代理:8080" # 如有内网代理

典型使用场景

场景 1:个人多渠道 AI 助手

在微信收到消息 → Linclaw 接收并处理 → 调用 DeepSeek 生成回复 → 通过微信发回。同时,在 Telegram 上也能与同一个 Agent 对话,历史上下文共享。场景 2:企业飞书知识库机器人

Linclaw + 飞书机器人 + MCP(接入企业知识库) → 员工在飞书群 @ 机器人提问 → 机器人从知识库检索相关文档 → 生成带引用来源的回答 → 以富文本卡片形式回复。全程数据不出内网(私有部署 + 本地 Ollama)。场景 3:定时自动化报告

配置 Cron 任务:每天早上 9 点自动抓取行业资讯、整理摘要、发送到钉钉工作群;每周五下午 6 点自动汇总本周数据、生成分析报告、发送给指定人员。场景 4:桌面自动化控制

通过 Shell 工具和截图工具,让 Linclaw 执行批量文件处理、截图分析、应用脚本自动化——在微信里发一条指令,AI 完成桌面级操作并回报结果。

常见问题

Q:Linclaw 是否完全免费?

Linclaw 桌面客户端本身 MIT 开源免费。运行成本来自调用的模型 API——使用七牛云 MaaS 按 Token 计费(新用户赠 300 万免费额度);使用本地 Ollama 模型则完全免费,无 API 费用。Q:与 OpenClaw 原版的技能(Skills)是否兼容?

Linclaw 兼容 MCP 协议标准的工具,可接入 ClawHub 生态中符合 MCP 标准的技能。原生 OpenClaw 技能(skill.md 格式)需要手动适配为 MCP Server,Linclaw 内置的四大工具(Shell/文件/浏览器/截图)已覆盖绝大多数常见需求。Q:微信接入是否会导致封号?

微信渠道基于 Web 协议,属于非官方接入,封号风险与市面上所有微信机器人方案相同。建议:避免高频自动发消息、不在大群广播、不处理陌生人消息。企业场景优先选择钉钉或飞书的官方机器人 API。Q:Linclaw 和 OpenClaw 原版哪个更适合开发者?

需要深度定制(修改底层逻辑、接入私有 LLM、扩展渠道协议)→ OpenClaw 原版;需要快速上线、国内渠道覆盖全、不想处理运维问题 → Linclaw。两者并不互斥,可以先用 Linclaw 验证场景可行性,再基于 OpenClaw 原版进行定制开发。

总结

Linclaw 通过"零部署桌面安装包 + 9 大渠道原生支持 + 七牛云 MaaS 模型统一接入",将 OpenClaw 的核心 AI 助手能力封装成国内用户 5 分钟即可上手的产品。其核心价值在于:解决了 OpenClaw 在国内落地的三大系统性障碍(部署门槛 / 渠道缺失 / 模型接入),而技术底层(ReAct Agent + MCP 协议 + Cron 定时 + 内置工具)与 OpenClaw 原版能力对齐。

主要局限性:技能生态规模(MCP 覆盖范围不及 ClawHub 原生技能)、微信渠道的非官方接入风险、以及对底层深度定制的限制。企业场景建议优先评估飞书/钉钉渠道 + 私有部署组合,个人用户则推荐直接从 DMG/EXE 安装包开始体验。

本文内容基于 2026 年 3 月 Linclaw 官网公开资料整理,Linclaw 处于活跃开发中,建议结合官网最新版本确认功能状态。

延伸资源

● OpenClaw 原版 GitHub:https://github.com/openclaw/openclaw