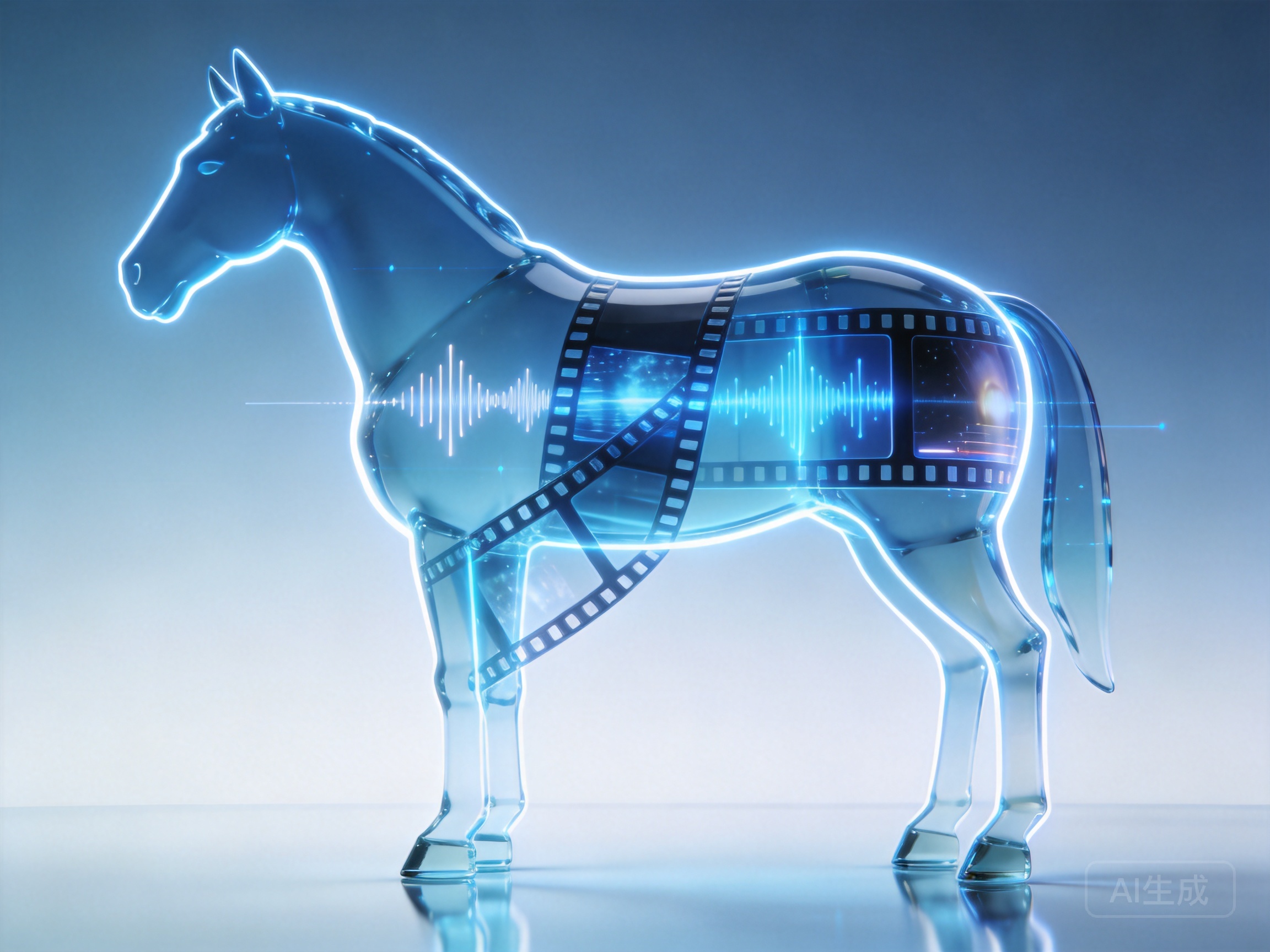

HappyHorse 1.0 视频模型:1080P音视频联合生成指南

视频创作领域长期存在一个痛点:视觉画面与音频往往需要分步生成,不仅耗时耗力,还经常出现音画不同步的尴尬局面。对于追求高品质内容的创作者而言,低分辨率的毛边和生硬的配乐更是直接拉低了作品的商业价值。为了解决这一系列难题,HappyHorse 1.0 视频模型应运而生。它打破了单模态生成的壁垒,将视觉与听觉的构建融为一体,为创作者提供了一套完整的视听生产力工具。

HappyHorse 1.0 音视频联合生成最佳实践

传统的视频生成工作流通常是先用大模型跑出无声视频,再将视频导入音频软件进行配乐和音效拟音。这种割裂的流程极易导致环境音效与画面动作脱节。HappyHorse 1.0 音视频联合生成则采用底层融合架构,在解析提示词的阶段就同步规划了音频轨道与视觉帧。

在实际操作中,创作者只需在提示词中详细描述场景和声音特征,例如“一匹黑马在雨后泥泞的草原上奔跑,马蹄溅起水花,伴随着清脆的马蹄声和远处的雷鸣”。模型引擎会同步渲染出马匹奔跑的动态画面和对应的物理音效。这种 HappyHorse 1.0 多模态视频生成能力,大幅度减少了后期的音效对齐工作,让内容产出更加浑然天成。

HappyHorse 1.0 图生视频还原度评测与超分技术

许多创作者在尝试图生视频时,常常遇到角色变形或背景扭曲的问题。经过多轮 HappyHorse 1.0 图生视频还原度评测,我们发现该模型在保持参考图一致性方面表现优异。无论是复杂的二次元人物还是写实风格的工业产品,它都能在维持原图特征的基础上,赋予自然的物理运动规律。

更关键的是,为了满足大屏播放和商业投放的需求,HappyHorse 1.0 1080P超分输出功能提供了像素级的画质提升。它并非简单地拉伸分辨率,而是通过深度学习算法智能补充画面细节,修复边缘锯齿,让生成的内容达到广播级的高清标准。

构建企业级多模态视频生成方案

面对海量的内容需求,企业团队不能仅依靠人工手动输入提示词,自动化和规模化才是破局之道。一套完善的企业级多模态视频生成方案,需要将模型能力深度嵌入到业务系统中。

关于如何接入 HappyHorse 1.0 视频模型 API,开发者可以先前往AI大模型广场评估各类主流模型的性能指标并获取调用权限。在具体的代码集成阶段,查阅AI大模型推理服务使用文档能够帮助技术团队快速掌握计费规则、参数配置以及并发处理技巧,确保从密钥获取到应用落地的全流程顺畅无阻。

对于非代码背景的运营团队或希望快速搭建工作流的开发者,利用自动化工具是极佳的选择。通过引入n8n-节点-七牛-ai,用户只需在可视化界面拖拽节点,就能将文本处理、图像生成与 HappyHorse 1.0 的视频生成能力串联起来,打造出无需人工干预的自动化内容生产流水线。

音画合一的高清视频生成正在重塑内容创作的边界。掌握并整合这些前沿的多模态工具,不仅能成倍提升内容产出的效率,更能让创意不再受限于繁琐的技术门槛。无论是独立创作者还是企业团队,现在正是将这些先进模型融入日常工作流的最佳时机。