如何部署 Claude Opus 4.7:企业级完整指南

Claude Opus 4.7 是 Anthropic 当前旗舰通用模型,模型 ID 为 claude-opus-4-7,在 Agent 编程任务上相比 Opus 4.6 实现跨越式提升,支持 100 万 Token 上下文窗口(最大输出 128k Token),可通过 Anthropic API、Amazon Bedrock 和 Google Vertex AI 三大渠道部署。本文为企业 IT 负责人和开发者提供从账号申请到生产上线的完整路径。

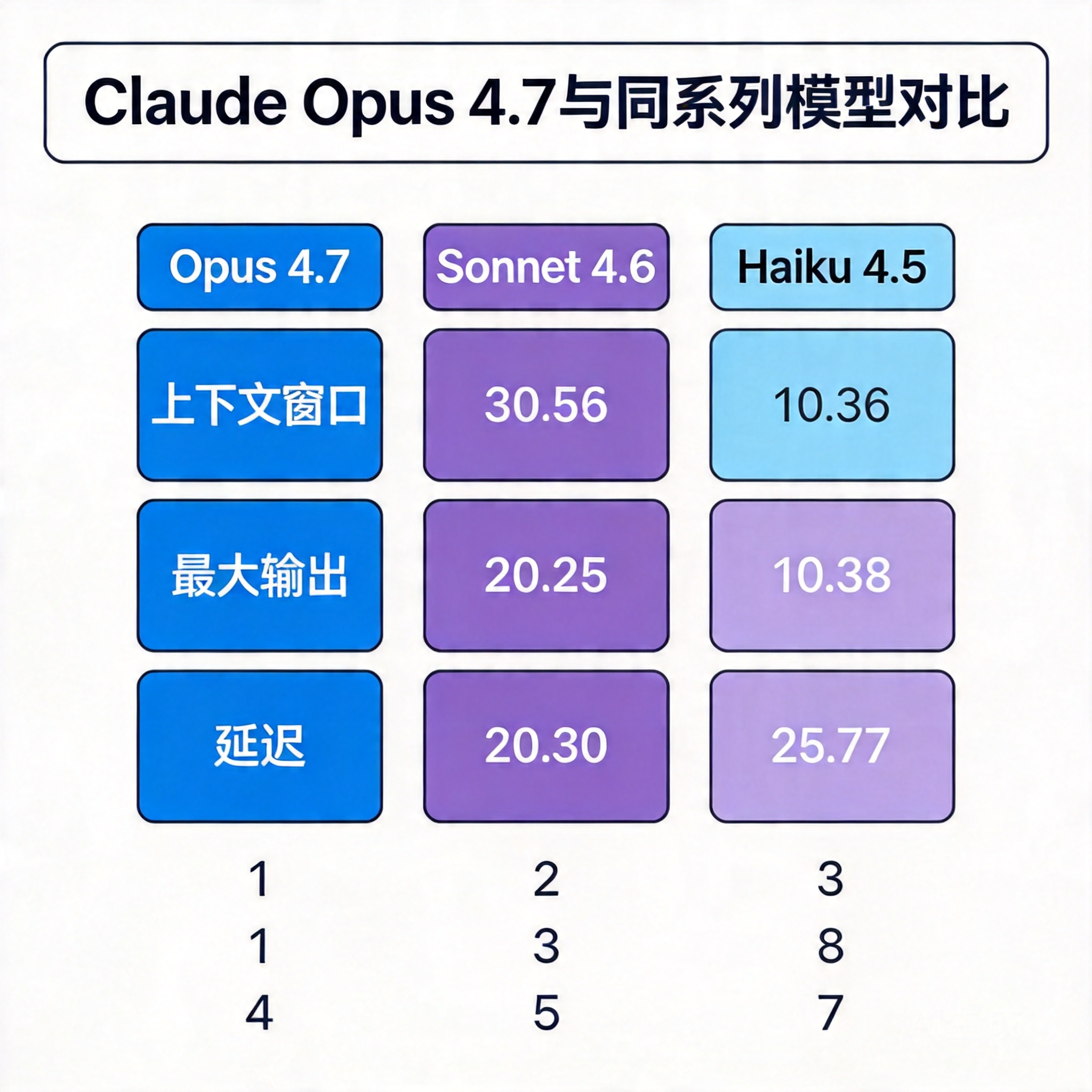

Claude Opus 4.7 核心参数一览

Claude Opus 4.7 在 2026 年初正式成为 Anthropic 最强通用可用模型,取代 Opus 4.6 成为复杂任务的首选。

关键差异:Opus 4.7 使用了全新 Tokenizer,在 Agentic Coding(代码生成、多步推理、工具调用)上相比 Opus 4.6 有质的提升;Batch API 支持最高 300k Token 输出(需携带 output-300k-2026-03-24 Beta Header)。

三种部署渠道选型

企业选择部署渠道时,核心考量维度为:数据合规要求、已有云厂商关系、运维成本和 SLA 要求。

选型原则:已用 AWS 的企业优先 Bedrock(Bedrock 模型 ID:anthropic.claude-opus-4-7);已用 GCP 的选 Vertex AI(ID:claude-opus-4-7);无云厂商绑定的新项目直接对接 Anthropic API 最为便捷。

方案一:Anthropic API 直接部署(5 步完成)

步骤 1:注册并获取 API Key

1. 访问 Anthropic Console 完成企业账号注册

2. 进入 Settings → API Keys 生成密钥

3. 将密钥写入环境变量(禁止硬编码到代码库):

export ANTHROPIC_API_KEY='sk-ant-xxxxxxxxxxxx'

# 永久写入,追加到 ~/.zshrc 或 ~/.bashrc

echo 'export ANTHROPIC_API_KEY="sk-ant-xxxxxxxxxxxx"' >> ~/.zshrc

步骤 2:安装 SDK

# Python

pip install anthropic

# Node.js / TypeScript

npm install @anthropic-ai/sdk

# Java(Maven)

# <groupId>com.anthropic</groupId>

# <artifactId>anthropic-java</artifactId>

# <version>2.20.0</version>

步骤 3:发起第一次调用

Python 示例(推荐生产使用):

import anthropic

client = anthropic.Anthropic() # 自动读取 ANTHROPIC_API_KEY 环境变量

message = client.messages.create(

model="claude-opus-4-7",

max_tokens=4096,

messages=[

{

"role": "user",

"content": "请分析以下季度财报并生成执行摘要:[财报内容]"

}

]

)

print(message.content)

TypeScript 示例(Node.js 后端):

import Anthropic from "@anthropic-ai/sdk";

const client = new Anthropic();

const msg = await client.messages.create({

model: "claude-opus-4-7",

max_tokens: 4096,

messages: [

{ role: "user", content: "请分析以下季度财报并生成执行摘要:[财报内容]" }

]

});

console.log(msg.content);

步骤 4:开启 Priority Tier(生产必备)

Priority Tier 将 API 可用性目标提升至 99.5%,在流量高峰时优先调度算力资源,适合企业生产环境。

message = client.messages.create(

model="claude-opus-4-7",

max_tokens=4096,

messages=[{"role": "user", "content": "..."}],

service_tier="auto" # 有 Priority Tier 配额时自动使用,否则降级 Standard

)

# 响应中确认实际使用的服务等级

print(message.usage.service_tier) # "priority" 或 "standard"

开通方式:联系 Anthropic 销售,选择 1/3/6/12 个月承诺期和 Token 配额(输入/输出分别定额)。

步骤 5:验证响应结构

一次成功调用返回如下 JSON,重点关注 stop_reason(应为 "end_turn")和 usage 中的 Token 消耗:

{

"id": "msg_01XxxxxxxxxxxxxxxxxxxxxxxX",

"type": "message",

"role": "assistant",

"model": "claude-opus-4-7",

"stop_reason": "end_turn",

"usage": {

"input_tokens": 512,

"output_tokens": 1024,

"service_tier": "priority"

}

}

方案二:Amazon Bedrock 企业部署

Amazon Bedrock 为使用 AWS 的企业提供了合规友好的部署选项,支持 IAM 权限管理、VPC PrivateLink 内网访问和 CloudTrail 审计日志。

Bedrock 部署要点:

1. 在 AWS 控制台的 Amazon Bedrock → Model access 中申请 anthropic.claude-opus-4-7 访问权限

2. 使用 AWS SDK 调用(以 Python boto3 为例):

import boto3

import json

bedrock = boto3.client(

service_name="bedrock-runtime",

region_name="us-east-1" # 按需选择区域

)

body = json.dumps({

"anthropic_version": "bedrock-2023-05-31",

"max_tokens": 4096,

"messages": [

{"role": "user", "content": "请分析以下合同条款的法律风险:[合同内容]"}

]

})

response = bedrock.invoke_model(

modelId="anthropic.claude-opus-4-7",

body=body

)

result = json.loads(response["body"].read())

print(result["content"][0]["text"])

3. 数据合规场景可结合 US-only Inference(inference_geo: "us"),确保推理计算发生在美国区域,注意此选项在 Priority Tier 计费时按 1.1 倍换算 Token 用量。

费用规划与控制

合理的费用控制是企业大规模使用大模型的关键。

Claude Opus 4.7 计费结构(2026 年 4 月基准):

5 条费用控制建议:

1. Prompt Caching:重复使用的 System Prompt、文档前缀写入 Cache,后续调用仅计 0.1 倍 Token 费用

2. Batch API:非实时任务(报告生成、数据批处理)使用 Message Batches API,享受更低单价,支持最高 300k Token 输出

3. 模型分层:高复杂度推理用 Opus 4.7,标准对话/摘要场景用 Sonnet 4.6(输出价格为前者 60%)

4. Max Tokens 精确设置:根据实际输出长度设定 max_tokens,避免无效占位

5. Models API 动态查询:通过 GET /v1/models 接口以编程方式获取最新 Token 限额和定价,避免配置脏数据

企业落地适用场景

Claude Opus 4.7 的生产性能在以下场景经过验证,适合作为优先试点方向:

● Agentic Coding:多步代码生成、重构、测试用例编写,支持调用外部工具和迭代修正;这是 Opus 4.7 相比前代模型提升最显著的能力

● 长文档处理:100 万 Token 上下文可容纳约 55.5 万英文单词,适合大型法律合同、审计报告、技术规范全文分析

● 企业知识问答:结合企业内部文档构建 RAG(检索增强生成)系统,知识截止日期更新至 2026 年 1 月

● 复杂推理任务:财务预测、供应链优化、多维度风险评估等需要深度推理的业务场景

● 多语言处理:支持中文、英文等主流语言,适合跨国企业内容本地化和客服系统

开发者可通过七牛云 AI 推理服务接入 Claude Opus 4.7,该服务兼容 Anthropic 标准 API,适合国内企业快速验证模型效果:qiniu.com/ai/models

迁移指南:从 Opus 4.6 升级到 Opus 4.7

对于正在使用 Claude Opus 4.6 的团队,迁移步骤极为简单:

1. 将代码中所有 "claude-opus-4-6" 替换为 "claude-opus-4-7"

2. 注意 Tokenizer 变更:Opus 4.7 使用新 Tokenizer,相同文本的 Token 计数可能与 Opus 4.6 存在差异,建议在迁移前重新校准 max_tokens 参数

3. 验证批量 API 调用:如使用 Batch API 的 300k 输出特性,需在请求头中添加 "anthropic-beta": "output-300k-2026-03-24"

4. Anthropic 官方将于 2026 年 6 月 15 日正式退役 claude-opus-4-20250514(即 Opus 4.0),建议尽早完成迁移

常见问题

Q:Claude Opus 4.7 和 Opus 4.6 的核心区别是什么?

Opus 4.7 在 Agentic Coding(代理式编程)能力上实现跨越式提升,是 Anthropic 官方文档推荐"最复杂任务"首选的当前最强通用可用模型。此外,4.7 使用了全新 Tokenizer,最大输出从 64k Token 提升至 128k Token,知识截止日期也更新为 2026 年 1 月。Q:如何在 Amazon Bedrock 上调用 Claude Opus 4.7?

在 AWS 控制台申请 anthropic.claude-opus-4-7 模型访问权限后,通过 boto3.client("bedrock-runtime") 调用 invoke_model,将 modelId 设为 anthropic.claude-opus-4-7,请求 body 格式与 Anthropic 直接 API 保持一致(需包含 anthropic_version 字段)。

Q:Priority Tier 是否值得企业付费购买?

对于日均 API 调用量超过数万次、或对服务可用性有 SLA 要求的生产环境,Priority Tier 的 99.5% 可用性目标有实际保障价值。Priority Tier 支持 1/3/6/12 个月承诺期,且超出配额后自动降级 Standard Tier,不会直接拒绝请求。

Q:Opus 4.7 支持 Extended Thinking(扩展思考)吗?

目前版本不支持。扩展思考功能在 Claude Sonnet 4.6 和 Haiku 4.5 上提供。若任务需要长链推理并希望观察思考过程,可考虑 Sonnet 4.6。

Q:企业数据如何保证不被用于模型训练?

通过 Anthropic API 的 Commercial 使用条款,默认情况下 API 输入输出数据不用于模型训练。使用 Amazon Bedrock 或 Vertex AI 部署时,数据处理遵循相应云厂商的合规框架,适用于金融、医疗等强监管行业。

总结

Claude Opus 4.7 是 2026 年上半年企业 AI 应用的优先选择:1M Token 上下文、128k 最大输出、跨越式 Agentic Coding 能力,三大渠道(Anthropic API / Bedrock / Vertex AI)覆盖不同合规需求。部署核心路径为:注册账号 → 获取 API Key → SDK 集成 → Priority Tier 保障 → Prompt Caching 降本。

据 Anthropic 官方文档,Opus 4.7 已于 2026 年初面向全球开发者全面开放,并于 API 响应头中实时提供 Priority Tier 剩余配额监控能力,企业可据此精细化管理 AI 预算。

延伸资源:

● Anthropic 模型文档:https://platform.claude.com/docs/en/docs/about-claude/models

● 多模型 API 对比与接入:https://www.qiniu.com/ai/models

本文内容基于 2026 年 4 月 Anthropic 官方文档数据,建议定期访问 Anthropic 文档 获取最新模型参数与定价信息。