Claude Opus 4.7 vs Mythos vs GPT-5.4 Pro vs Gemini 3.1 Pro:2026 年旗舰模型横评

截至 2026 年 4 月,主流 AI 旗舰模型格局已基本成型:Anthropic 的 Claude Opus 4.7(通用旗舰)和 Mythos Preview(网络安全专项)、OpenAI 的 GPT-5.4 Pro(发布于 2026 年 3 月 5 日)、Google DeepMind 的 Gemini 3.1 Pro(Preview 状态)形成四强竞争。本文基于官方基准数据和公开定价,帮助企业 IT 负责人和开发者做出清晰的选型判断。

四款模型核心参数速览

在进行性能对比之前,先对四款模型的基本规格建立直观认知。

关键差异一句话总结:GPT-5.4 Pro 是当前定价最高的通用旗舰($30/$180),Mythos 是唯一专为网络安全设计的邀请制模型,Gemini 3.1 Pro 功能最全但仍是预览版,Opus 4.7 是通用场景性价比最均衡的选择。

基准测试成绩对比

基准测试是衡量模型能力的核心指标,以下数据均来自各开发商官方公告或经独立机构验证的结果。

编程与 Agent 任务

Claude Opus 4.7 在 Agentic Coding 上相比 Opus 4.6 实现跨越式提升,但 Anthropic 未在同一次测试中公布与 Mythos 的对比数据。Mythos 的 SWE-bench Pro 77.8% 大幅领先 GPT-5.4 Pro 的 57.7%,但需注意 Mythos 是专项模型,整体通用性不能与前者直接类比。

知识工作与职业任务

计算机操控(Computer Use)

OpenAI 称 GPT-5.4 是"第一个具备原生计算机操控能力的通用旗舰模型",在桌面环境自动化任务上取得历史性突破。

网络安全专项(Mythos)

能力特性深度对比

Agentic Coding 与代码自动化

Claude Opus 4.7 是 Anthropic 当前通用旗舰,在 Agentic Coding 上相比 Opus 4.6 实现跨越式提升,支持多步工具调用、代码迭代修正和长上下文代码库分析(1M Token 可容纳约 55 万字)。

GPT-5.4 Pro 整合了 GPT-5.3-Codex 的编程能力,SWE-bench Pro 达到 57.7%,并新增原生 Computer Use 支持,可直接操控桌面软件执行复杂 Agent 工作流。

Claude Mythos Preview 的 SWE-bench Pro 77.8% 是四款模型中最高分,但其定位为网络安全专项,不适合通用代码开发场景。

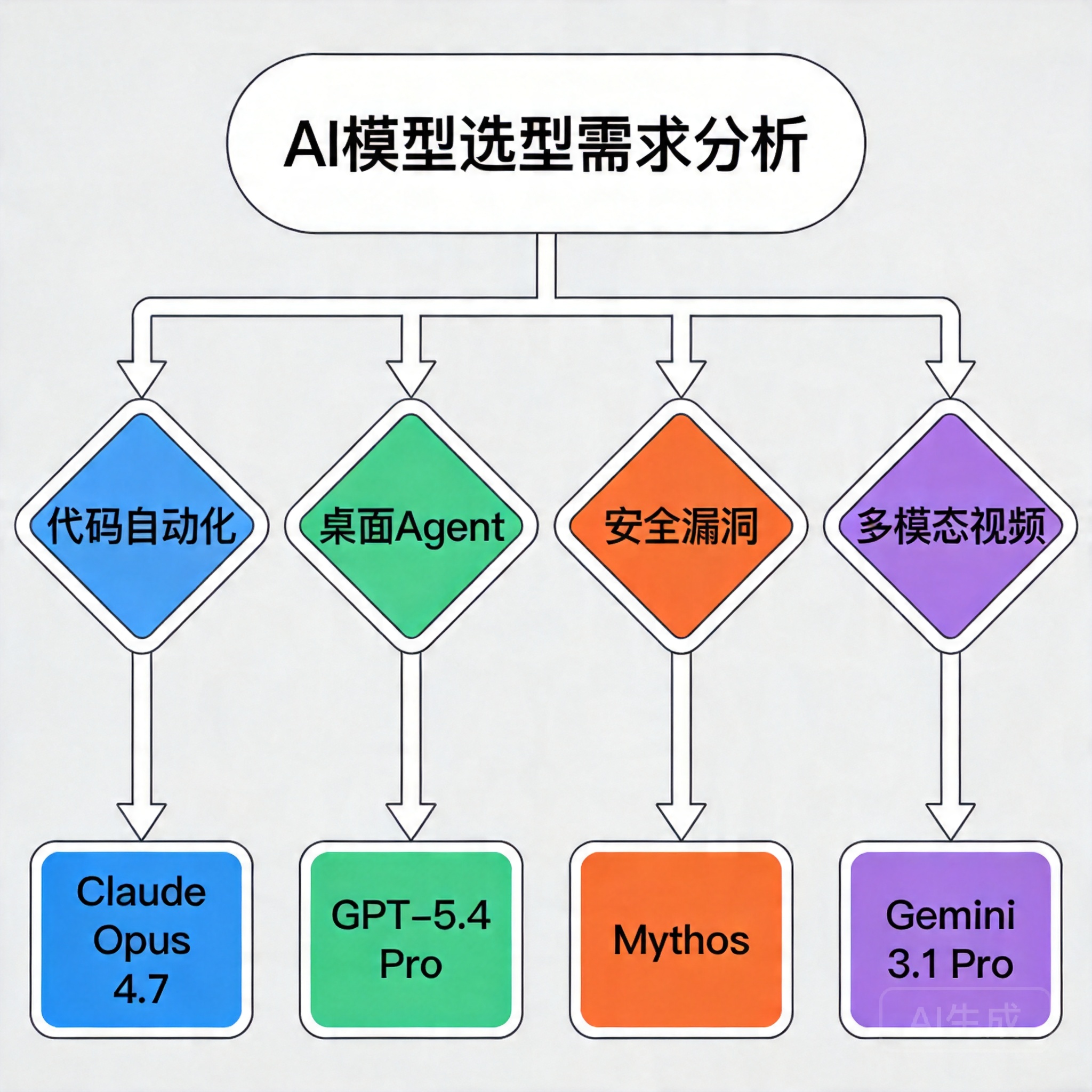

选型建议:

● 企业代码自动化 → Opus 4.7(性价比高,通用性强)

● 需要 Computer Use 的 Agent 工作流 → GPT-5.4 Pro

● 漏洞分析、渗透测试专项 → Mythos(需申请邀请)

长文档与大上下文处理

三款可用模型均提供约 1M Token 上下文,但输出能力有差异:

● Claude Opus 4.7 和 GPT-5.4 Pro:最大输出均为 128k Token,适合长报告生成

● Gemini 3.1 Pro:最大输出 65k Token,约为前两者的一半

● GPT-5.4 Pro 额外支持 Batch API 下 300k Token 输出(需配置参数)

多模态与工具调用

Gemini 3.1 Pro 在多模态宽度上领先,支持视频和音频输入;GPT-5.4 Pro 的 Computer Use 是其独家核心优势;Opus 4.7 在多模态深度(图像理解质量)上表现突出。

定价与性价比分析

价格差距在四款模型中极为悬殊,直接影响规模化部署决策。

百万 Token 成本对比(输出侧):

性价比分析:GPT-5.4 Pro 的输出价格是 Opus 4.7 的 7.2 倍,同等输出量下企业成本差距显著。GPT-5.4 标准版(非 Pro)定价 $2.50/$15,适合大多数非极限任务场景。Mythos 的高定价反映其邀请制和专项能力,不参与通用场景竞争。

费用控制建议:

● 日常对话/摘要任务:Claude Sonnet 4.6($3/$15)

● 复杂推理/长文档:Claude Opus 4.7($5/$25)

● 极致代码/Agent 工作流且预算充足:GPT-5.4 Pro($30/$180)

● 网络安全合规场景:申请 Mythos 邀请

企业落地场景选型矩阵

国内企业在评估 API 接入成本时,可通过七牛云 AI 推理服务对比多模型调用效果,该服务兼容 Anthropic/OpenAI 双标准 API 接口:qiniu.com/ai/models

常见问题

Q:Claude Mythos Preview 怎么申请使用?

Mythos 属于 Project Glasswing 的邀请制计划,面向关键基础设施运营者、安全研究机构和企业安全团队。目前已有 12 个首批合作伙伴和 40+ 个关键基础设施组织获得访问权限。有意向的企业可通过 anthropic.com/glasswing 提交申请,Anthropic 已承诺 $100M 使用积分用于早期合作机构。Q:GPT-5.4 Pro 为什么比 Opus 4.7 贵这么多?

GPT-5.4 Pro 采用更高计算量的推理模式(支持 medium/high/xhigh 三档推理强度),且仅通过 Responses API 提供(支持多轮模型交互),部分复杂任务耗时可达数分钟。OpenAI 将其定位为"最复杂高风险任务"专用,不建议作为日常场景默认模型。Q:Gemini 3.1 Pro 是否可以用于企业生产环境?

截至 2026 年 4 月,Gemini 3.1 Pro 仍处于 Preview 状态,Google 尚未公布正式定价和 SLA 承诺,不建议直接用于生产关键链路。Gemini 2.5 Pro(Stable 状态)是当前 GCP 生态企业的稳定选择。Q:四款模型中知识截止日期最新的是哪个?

Claude Opus 4.7 的可靠知识截止日期为 2026 年 1 月,是四款模型中最新的,适合需要处理近期事件和最新技术资料的场景。GPT-5.4 Pro 知识截止为 2025 年 8 月,Gemini 3.1 Pro 为 2025 年 1 月,Mythos 未披露。Q:企业批量推理任务(Batch API)哪个模型最适合?

Claude Opus 4.7 通过 Message Batches API 支持最高 300k Token 异步输出(需携带 Beta Header),定价低于同步接口。GPT-5.4 标准版(非 Pro)在批量任务上性价比更高,输出价格仅为 $15/MTok。

总结

四款旗舰模型在 2026 年已形成明确的能力分工:Claude Opus 4.7 是综合性价比最优的通用旗舰,适合绝大多数企业 AI 应用;GPT-5.4 Pro 凭借原生 Computer Use 和 GDPval 83% 的专业工作成绩在极致性能场景占据优势,但 $180/MTok 的输出价格限制了其大规模部署;Claude Mythos Preview 以 SWE-bench Pro 77.8% 的成绩确立网络安全专项领先地位;Gemini 3.1 Pro 的多模态宽度最广但生产稳定性有待观察。

据 Anthropic 官方文档,Opus 4.7 采用全新 Tokenizer,在相同任务下 Token 效率高于前代;据 OpenAI 官方发布(2026 年 3 月),GPT-5.4 比 GPT-5.2 减少 33% 的事实性错误,整体响应错误率降低 18%。

延伸资源:

● 多模型 API 对比测试:qiniu.com/ai/models

● Anthropic 模型文档:https://platform.claude.com/docs/en/docs/about-claude/models

● OpenAI GPT-5.4 发布博客:https://openai.com/index/introducing-gpt-5-4/

本文内容基于 2026 年 4 月各开发商官方文档及公开发布数据。Gemini 3.1 Pro 定价和 SLA 以 Google 正式发布为准;Mythos 规格以 Anthropic 官方公告为准。建议企业在选型前通过 API 实测验证各模型在自身业务场景下的实际表现。