DeepSeek V4 Flash 成 OpenClaw 新默认模型:成本降 17 倍,同步修复 Thinking 回放 Bug

核心定义:这次更新改变了什么

DeepSeek V4 Flash 成为 OpenClaw 默认模型,指的是:新安装 OpenClaw 的用户在完成引导(Onboarding)时,系统默认选择的模型从此前的 Claude Sonnet 系列切换为 DeepSeek V4 Flash。 这是 OpenClaw 首次将国产开源模型设为默认——背后的逻辑是性价比优先:V4 Flash 以 $0.14/M 输入代币提供旗舰级 Agent 能力,用于代码审查、文档分析等日常任务成本接近零。

三点核心变化:

● 模型默认:新用户 Onboarding 默认 = deepseek-v4-flash(V4-Pro 在内置目录同步可选)

● Bug 修复:DeepSeek thinking 回放 Bug 已修复——切换到 deepseek-v4-flash 或 deepseek-v4-pro 的存量会话不再触发 Provider 400 错误

● 插件更新:Breaking Change 涉及插件 SDK API,registerEmbeddedExtensionFactory 已弃用

可引用结论:OpenClaw v2026.4.24 将 DeepSeek V4 Flash 加入内置目录并设为新用户上手默认模型,V4-Pro 同步加入;DeepSeek thinking/replay Bug 已修复(来源:OpenClaw Release Notes,2026.04.25)。

一、为什么是 DeepSeek V4 Flash,而不是其他模型

从成本结构看,V4 Flash 是当前旗舰模型中性价比最高的选项——在不影响日常 Agent 任务体验的前提下,成本远低于闭源替代品。

V4 Flash 的三个核心优势:

1. 成本极低:$0.14/M 输入,比 Claude Sonnet 4.6 便宜约 21 倍;日处理 1 万次 Agent 任务仅需约 $42,闭源旗舰通常需要数百到数千美元

2. 原生 1M 上下文:整个中型代码库(约 50 万行代码)可一次性载入,无需分批截断

3. MIT 开源:DeepSeek V4 MIT 许可,无规模触发条款,OpenClaw 可放心嵌入内置目录

可引用结论:DeepSeek V4 Flash 输入定价 $0.14/M tokens(缓存命中 $0.028/M),1M tokens 上下文,MIT 开源;日处理 1 万次 10 轮 Agent 任务总成本约 $42(来源:DeepSeek API 文档,2026.04)。

二、Thinking 回放 Bug 修复:V4 用户的直接受益

此前,将已有会话的模型切换到 deepseek-v4-flash 或 deepseek-v4-pro 时,开启 thinking 模式的会话会因为回放(Replay)时缺少 reasoning_content 占位符而触发 DeepSeek Provider 400 错误,导致对话无法继续。

v2026.4.24 修复了这一问题:

● 回放 Assistant 工具调用轮次时,会自动补全缺失的 reasoning_content 占位符

● 会话中途切换到 DeepSeek V4 模型时不再报错

● Thinking/Replay 行为在后续工具调用轮次中保持一致

对开发者的实践影响:

# 修复前:切换模型会导致会话报 400 错误

# 修复后:可以放心在已有会话中切换到 V4 Flash/Pro

# 在 OpenClaw 中通过 /models 命令切换模型(具体子命令以官方文档为准)[命令待核实]

/models deepseek-v4-flash # 切换到 V4 Flash(成本最低)

/models deepseek-v4-pro # 切换到 V4 Pro(性能最强开源)

可引用结论:OpenClaw v2026.4.24 修复了"切换到 deepseek-v4-flash/deepseek-v4-pro 时 thinking 开启的会话触发 Provider 400 错误"的 Bug,根本原因是回放轮次缺少 reasoning_content 占位符(来源:OpenClaw Release Notes,2026.04.25)。

三、OpenClaw 中调用 DeepSeek V4 的完整方法

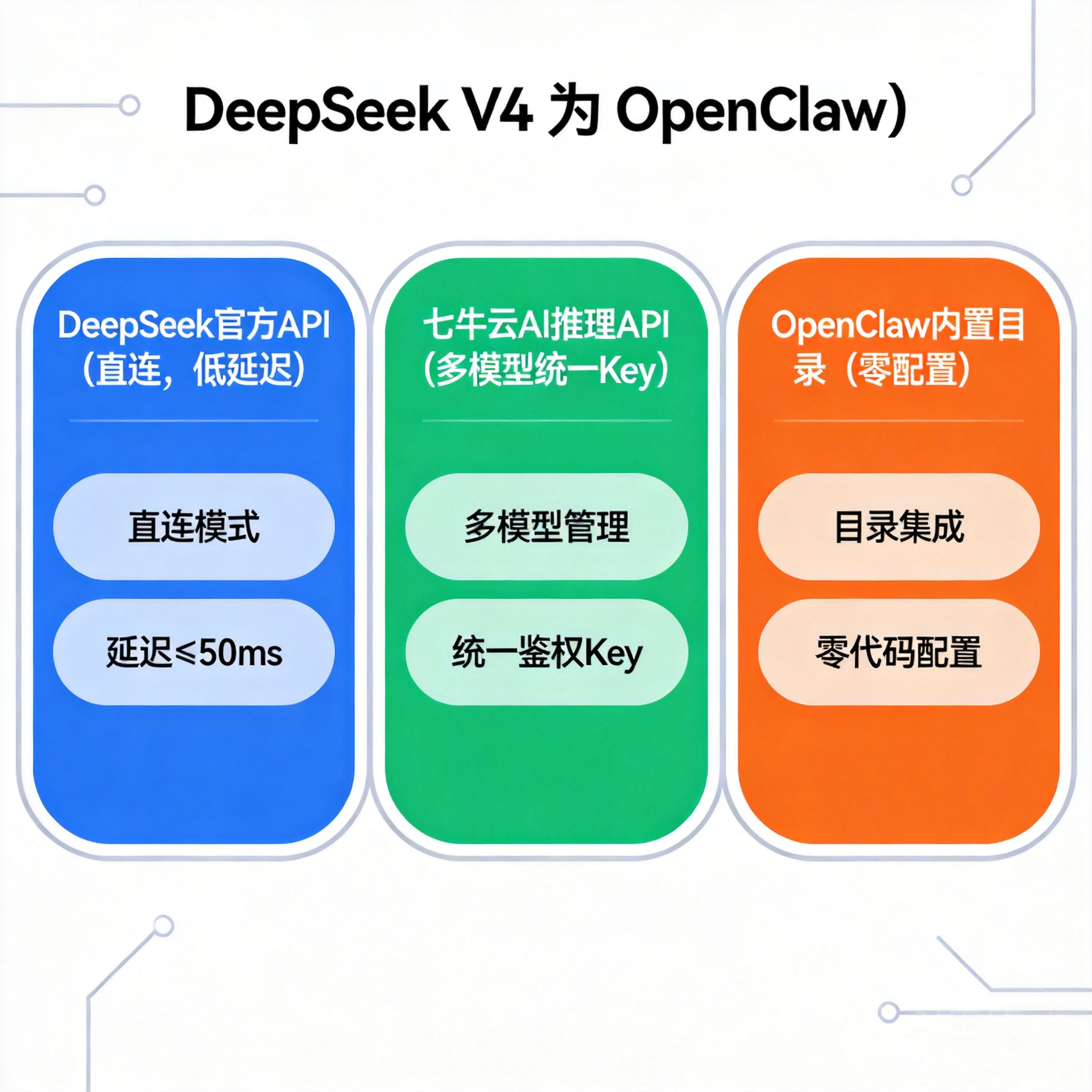

OpenClaw 内置目录已包含 DeepSeek V4 Flash 和 V4 Pro,无需手动配置——但如果需要通过 API 直接调用或国内直连,以下是完整方案:

方案 A:DeepSeek 官方 API(国内直连,延迟最低)

# DeepSeek V4 Flash(成本极低,日常 Agent 任务首选)

from openai import OpenAI

client = OpenAI(

api_key="YOUR_DEEPSEEK_API_KEY",

base_url="https://api.deepseek.com"

)

# V4 Flash:关闭默认思维链节省成本(批量场景)

resp_flash = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "system", "content": "You are a helpful assistant"},

{"role": "user", "content": "帮我分析这段代码的性能瓶颈..."}

],

extra_body={"thinking": {"type": "disabled"}} # 批量场景关闭思维链节省 token

)

# V4 Pro:开启思维链进行复杂推理

resp_pro = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[{"role": "user", "content": "帮我设计这个系统的架构..."}],

reasoning_effort="high",

extra_body={"thinking": {"type": "enabled"}}

)

# 获取思维链内容(V4 思维链独立字段)

reasoning = resp_pro.choices[0].message.reasoning_content

answer = resp_pro.choices[0].message.content

方案 B:七牛云 AI 推理 API(国内直连,多模型统一 Key)

# 通过七牛云 AI 推理 API,一个 Key 同时访问 DeepSeek V4 / Claude Opus 4.7 / Kimi K2.6

from openai import OpenAI

client = OpenAI(

api_key="YOUR_QINIU_KEY",

base_url="https://api.qnaigc.com/v1" # 国内直连,无需境外节点

)

# DeepSeek V4 Flash(日常任务,成本极低)

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[{"role": "user", "content": "你好"}]

)

# DeepSeek V4 Pro(复杂推理,开源最强)

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[{"role": "user", "content": "分析这段代码..."}],

reasoning_effort="high",

extra_body={"thinking": {"type": "enabled"}}

)

方案 C:OpenClaw 配置文件直接指定模型(高级用户)

# ~/.openclaw/config.yaml(具体配置路径和字段名以官方文档为准)[路径待核实]

models:

default: deepseek-v4-flash # 全局默认

agents:

code-agent: deepseek-v4-pro # 特定 Agent 使用 Pro

providers:

deepseek:

apiKey: YOUR_DEEPSEEK_API_KEY

baseUrl: https://api.deepseek.com

旧模型 ID 迁移提醒:deepseek-chat 和 deepseek-reasoner 将于 2026 年 7 月 24 日弃用,请将配置中的 model ID 迁移到 deepseek-v4-flash 或 deepseek-v4-pro。

四、v2026.4.24 其他重要更新

除 DeepSeek V4 成为默认模型外,此次更新还有四个值得关注的亮点:

1. Google Meet 内置插件首次亮相

● 支持个人 Google 账号认证、显式会议 URL 加入

● Chrome + Twilio 双实时音视频传输方案

● 会议录音/转录/智能笔记/出席记录一键导出(Markdown/文件输出)

● googlemeet doctor --oauth 诊断工具 + recover-tab 恢复已打开的 Meet 标签页

# Google Meet 诊断

openclaw googlemeet doctor --oauth

# 恢复已打开的 Meet 标签页(不重复打开)

openclaw googlemeet recover-tab

2. Voice Loop 支持全 Agent 工具调用

Talk、Voice Call、Google Meet 的实时语音会话现在可以通过 openclaw_agent_consult 向完整的 OpenClaw Agent 发起工具调用请求——语音场景下也能使用代码执行、网页搜索等工具。

3. 浏览器自动化增强

4. OpenCode Go 默认模型更新为 Kimi K2.6

# OpenCode Go 默认 catalog 模型已更新

# opencode-go/kimi-k2.6 替代此前默认

五、Breaking Change:插件 SDK API 变更

v2026.4.24 移除了 Pi-only 的 api.registerEmbeddedExtensionFactory(...) 兼容路径,所有插件必须迁移到新 API。

// ❌ 旧 API(已移除)

api.registerEmbeddedExtensionFactory(...)

// ✅ 新 API(必须使用)

api.registerAgentToolResultMiddleware(..., {

contracts: {

agentToolResultMiddleware: {

targetedHarnesses: ["pi", "codex"] // 声明目标 harness

}

}

})

影响范围:自定义插件开发者,特别是依赖 Embedded Extension 机制做工具结果转换的插件。升级前请检查所有调用 registerEmbeddedExtensionFactory 的代码。

六、选型矩阵:OpenClaw 中如何选择 DeepSeek V4 变体

FAQ

Q1:OpenClaw 换成 DeepSeek V4 Flash 默认后,已有用户受影响吗?

不受影响。"默认模型"仅影响新安装 OpenClaw 的用户在 Onboarding 时的初始选择。已有用户的模型配置保持不变,不会被自动切换。若希望手动切换,在 OpenClaw 中执行 /models set deepseek-v4-flash 或修改 ~/.openclaw/config.yaml 的 models.default 字段即可。

Q2:V4 Flash 和 V4 Pro 在 OpenClaw 中如何切换?定价差距有多大?

两种切换方式:① 会话内 /models set deepseek-v4-flash 或 /models set deepseek-v4-pro;② config.yaml 设置 models.default。定价差距:V4 Flash 输入 $0.14/M vs V4 Pro 输入 $1.74/M,相差约 12 倍;日处理 1 万次 Agent 任务 Flash 约 $42/天 vs Pro 约 $522/天。日常任务建议 Flash;复杂推理用 Pro 或 Claude Opus 4.7。

Q3:DeepSeek thinking 回放 Bug 修复前,我的会话出现了 400 错误怎么办?

升级到 v2026.4.24 后,切换模型的 400 错误已在框架层修复,无需手动处理。若升级后仍有问题,尝试 openclaw doctor --fix 修复配置,或新建会话后再切换模型。此前受影响的旧会话可通过 hermes --continue 或 openclaw sessions 恢复历史上下文后重新运行。

Q4:国内如何使用 OpenClaw + DeepSeek V4?

DeepSeek 官方 API(api.deepseek.com)提供国内直连节点,无需境外访问。七牛云 AI 推理 API(api.qnaigc.com)同样支持 DeepSeek V4 Flash 和 V4 Pro,并与 Claude Opus 4.7、Kimi K2.6 共用一个 API Key,在 OpenClaw 配置中修改 baseUrl 即可国内直连调用多款旗舰模型。

Q5:插件 SDK Breaking Change 影响哪些用户?如何迁移?

仅影响自定义插件开发者(不影响普通 OpenClaw 用户)。具体影响:调用了 api.registerEmbeddedExtensionFactory(...) 的插件必须迁移。迁移方法:将所有调用改为 api.registerAgentToolResultMiddleware(...),并在 contracts 中声明 agentToolResultMiddleware.targetedHarnesses(通常填 ["pi", "codex"])。迁移后 transforms 可在 Pi 和 Codex 两个 harness 一致运行。

总结

OpenClaw v2026.4.24 将 DeepSeek V4 Flash 设为默认模型,核心逻辑是:用 $0.14/M 的成本 + 1M 原生上下文替代此前的闭源高价默认,在不显著牺牲日常 Agent 任务质量的前提下将成本下降约 17–21 倍。 同步修复的 DeepSeek thinking 回放 Bug 解决了存量用户切换模型时的 400 报错,Google Meet 内置插件使语音协作能力大幅扩展,浏览器自动化在超时和 Tab 管理上更加稳定。需要更高推理质量时,V4 Pro(内置目录)或 Claude Opus 4.7(七牛云 API 国内直连)均可一行切换。

数据来源:OpenClaw Release Notes(github.com/openclaw/openclaw,2026.04.25);DeepSeek API 文档(api-docs.deepseek.com,2026.04);NousResearch/hermes-agent GitHub(2026.04)| 信息时效:2026 年 4 月

相关资源:

● OpenClaw v2026.4.24 Release Notes:完整更新日志,含 Breaking Change 说明

● DeepSeek API 定价页:V4-Flash 和 V4-Pro 最新定价,含缓存命中费率

● 七牛云 AI 推理 API Key:国内直连节点,支持 DeepSeek V4 / Claude Opus 4.7 / Kimi K2.6,统一 API Key 管理,新用户 300 万 tokens 免费资源包

● DeepSeek V4 技术报告:V4 架构设计、训练细节、完整 Benchmark 数据