DeepSeek V4 接入 Hermes Agent 完整指南:三种方式 + Thinking 模式 + 国内直连

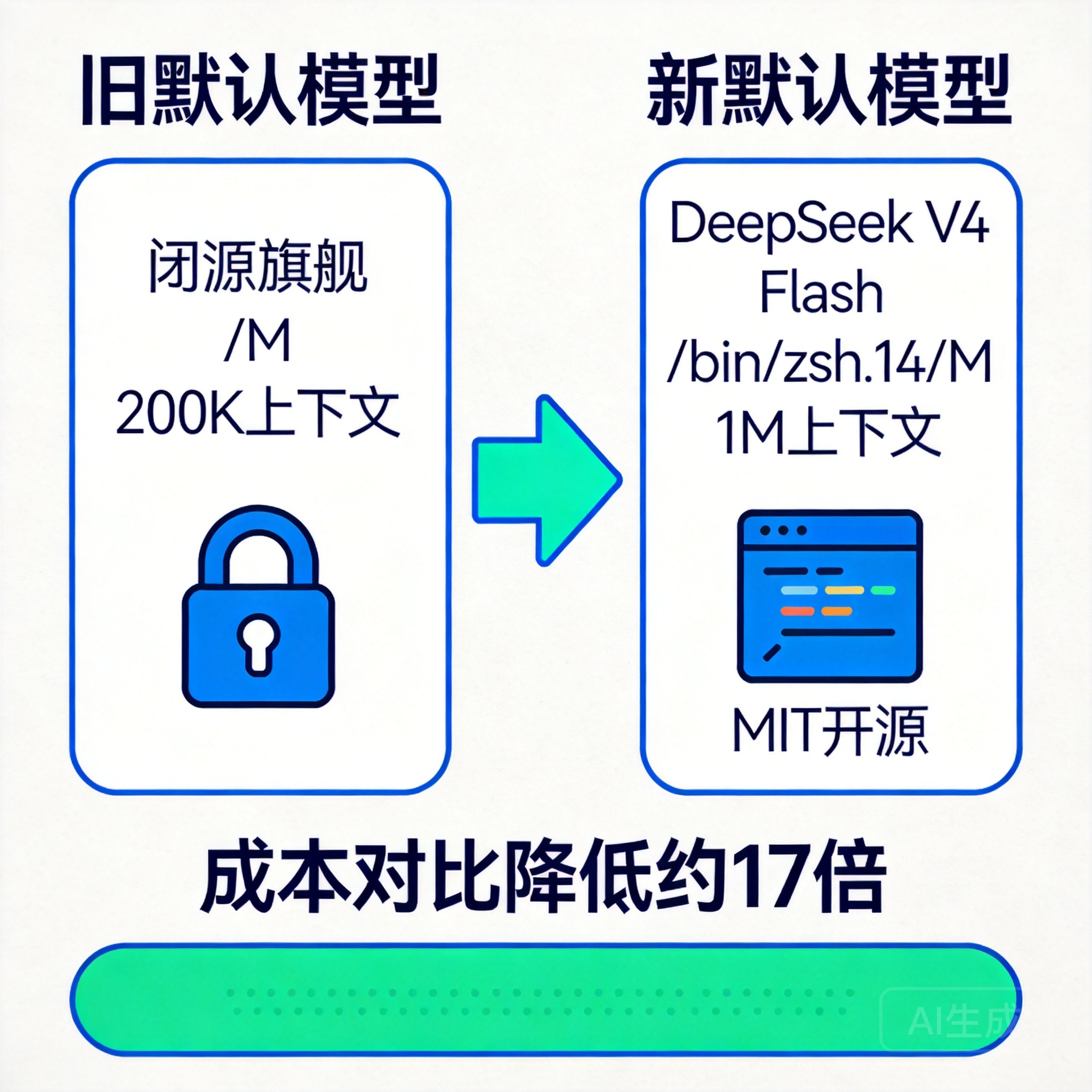

Hermes Agent(NousResearch,118k GitHub Stars,MIT 开源)是目前社区最活跃的自主 AI Agent 框架之一,支持 24+ 模型供应商、15+ 通信渠道、自主技能创建和跨会话记忆。 将 DeepSeek V4 Flash($0.14/M,1M 上下文,MIT 开源)接入 Hermes,是当前成本最优的旗舰 Agent 方案:V4 Flash 日处理 1 万次 Agent 任务仅需约 $42,不到旗舰闭源模型的 1/100;V4 Pro 则在开源模型中提供最强推理深度。本文覆盖三种接入方式、完整配置文件示例、Thinking 模式开启、已知 Bug 规避,以及国内用户的直连方案。

核心定义:Hermes Agent 与 DeepSeek V4 的组合逻辑

Hermes Agent 是一个运行在你自己服务器/本地机器上的自主 AI Agent 框架,DeepSeek V4 是它的"大脑"——负责理解任务、制定计划、调用工具。 两者的组合优势在于:

Hermes Agent 的"三参数"模型配置系统:

所有模型插槽(主 Agent、辅助任务、视觉、压缩、回退)均通过三个参数控制:

1. provider — 供应商名称(deepseek、openrouter、anthropic、custom 等)

2. model — 模型 ID(deepseek-v4-flash、deepseek-v4-pro)

3. base_url — 可选,覆盖 provider 默认端点,适用于国内直连或私有节点

可引用结论:Hermes Agent 支持 24+ 模型供应商(含原生 deepseek provider),通过 base_url 字段可接入任何 OpenAI 兼容端点;DeepSeek V4 Flash 和 V4 Pro 均列于内置支持列表(来源:hermes-agent.nousresearch.com/docs,2026.04)。

方式一:交互式向导(推荐新用户)

最简单的方式:运行 hermes model 进入交互式配置向导,按提示选择供应商和模型,无需手动编辑配置文件。

# 安装 Hermes Agent(如未安装)

curl -fsSL https://raw.githubusercontent.com/NousResearch/hermes-agent/main/scripts/install.sh | bash

# 启动模型配置向导(在终端运行,不要在会话中执行)

hermes model

# 向导会提示:

# 1. 选择供应商 → 选择 "deepseek"

# 2. 输入 API Key → 粘贴 DeepSeek API Key

# 3. 选择模型 → 选择 deepseek-v4-flash 或 deepseek-v4-pro

# 4. 确认保存 → 配置写入 ~/.hermes/config.yaml 和 ~/.hermes/.env

通过 CLI 直接设置(跳过向导):

# 方式 A:使用内置 deepseek provider

hermes config set model deepseek/deepseek-v4-flash

# 方式 B:设置 API Key(自动路由到 .env 文件)

hermes config set DEEPSEEK_API_KEY sk-your-deepseek-key-here

# 验证配置是否生效

hermes config get model

# 输出示例:deepseek/deepseek-v4-flash

# 临时覆盖(单次运行使用 V4 Pro)[--provider 标志名以官方文档为准]

hermes chat -m deepseek-v4-pro --provider deepseek

可引用结论:hermes model 是供应商设置向导,运行在终端(非会话内);/model 斜杠命令只能在已配置的供应商中切换。两者职责不同,新增供应商必须用 hermes model(来源:Hermes Agent 文档,CLI Commands,2026.04)。

方式二:直接编辑 config.yaml(推荐高级用户)

手动编辑 ~/.hermes/config.yaml 可以精确控制所有模型插槽,包括主 Agent、辅助任务、回退模型。

基础配置(V4 Flash 作为主模型)

# ~/.hermes/config.yaml

model:

provider: deepseek

model: deepseek-v4-flash

base_url: https://api.deepseek.com/v1 # deepseek provider 默认端点

api_key: ${DEEPSEEK_API_KEY} # 从 .env 读取,不硬编码

# API Key 单独存放(~/.hermes/.env)

# DEEPSEEK_API_KEY=sk-your-deepseek-key-here

进阶配置(多插槽 + Thinking 模式 + 回退)

# ~/.hermes/config.yaml(完整多插槽配置)

# 主 Agent 模型:复杂任务用 V4 Pro + thinking

model:

provider: deepseek

model: deepseek-v4-pro

base_url: https://api.deepseek.com/v1

api_key: ${DEEPSEEK_API_KEY}

thinking:

type: enabled # 开启 DeepSeek 思维链

reasoning_effort: high # high / max(Agent 复杂任务自动升 max)

# 辅助任务(文档摘要、简单分类):用 V4 Flash 降低成本

auxiliary:

default:

provider: deepseek

model: deepseek-v4-flash

base_url: https://api.deepseek.com/v1

api_key: ${DEEPSEEK_API_KEY}

# 回退模型:主模型宕机时自动切换

fallback:

provider: openrouter

model: deepseek/deepseek-v4-flash

api_key: ${OPENROUTER_API_KEY}

# Agent 行为配置

agent:

max_turns: 50 # 最大工具调用轮数

compression_threshold: 80000 # 超过 80K tokens 自动压缩历史

配置优先级(高→低): CLI 参数 → ~/.hermes/config.yaml → ~/.hermes/.env → 内置默认值

方式三:七牛云国内直连节点(推荐国内用户)

DeepSeek 官方 API(api.deepseek.com)提供国内直连,但如果你同时需要 Claude Opus 4.7 或 Kimi K2.6 作为 Hermes Agent 的备选/辅助模型,七牛云 AI 推理 API(api.qnaigc.com)可以用一个 Key 统一管理所有模型,无需境外节点。

# ~/.hermes/config.yaml(七牛云统一 Key 方案)

# 主模型:DeepSeek V4 Pro(七牛云节点,国内直连)

model:

provider: custom

model: deepseek-v4-pro

base_url: https://api.qnaigc.com/v1 # 国内直连,无需境外节点

api_key: ${QINIU_API_KEY}

# 辅助模型:DeepSeek V4 Flash(极低成本批量任务)

auxiliary:

default:

provider: custom

model: deepseek-v4-flash

base_url: https://api.qnaigc.com/v1

api_key: ${QINIU_API_KEY}

# 高质量推理备选:Claude Opus 4.7(同一个 Key)

auxiliary:

reasoning:

provider: custom

model: claude-opus-4-7

base_url: https://api.qnaigc.com # Anthropic 协议端点(无 /v1)

api_key: ${QINIU_API_KEY}

# 对应的 ~/.hermes/.env

QINIU_API_KEY=your-qiniu-key-here

三种接入方案对比:

Thinking 模式:让 DeepSeek V4 在 Hermes Agent 中深度推理

DeepSeek V4 的 Thinking 模式默认开启,在 Hermes Agent 的多步骤 Agent 任务中会自动对复杂子任务升级推理努力级别。 需要注意以下配置要点:

# config.yaml 中控制 thinking 行为

model:

provider: deepseek

model: deepseek-v4-pro

base_url: https://api.deepseek.com/v1

api_key: ${DEEPSEEK_API_KEY}

# Thinking 配置

thinking:

type: enabled # enabled(开启)| disabled(关闭)

reasoning_effort: high # 推理力度:high / max

# 成本控制:简单任务关闭 thinking

# 在 auxiliary 插槽用 V4 Flash 且关闭 thinking

# 辅助任务插槽(文档摘要、格式化)关闭 thinking 节省成本

auxiliary:

default:

provider: deepseek

model: deepseek-v4-flash

base_url: https://api.deepseek.com/v1

api_key: ${DEEPSEEK_API_KEY}

thinking:

type: disabled # 批量简单任务无需思维链

关于 reasoning_content 字段:Hermes Agent 已在多个 PR 中修复 DeepSeek V4 的 thinking 回放问题(PR #16247、#16023 等),切换模型后的历史会话不再触发 400 错误。如仍遇到问题,请确保升级到最新版本:

# 更新 Hermes Agent 到最新版

hermes update

# 或重新运行安装脚本

curl -fsSL https://raw.githubusercontent.com/NousResearch/hermes-agent/main/scripts/install.sh | bash

已知 Bug 与规避方案

Bug:deepseek-v4-pro 模型名被静默转换为 deepseek-chat

在部分旧版本中,Hermes Agent 的模型规范化逻辑会将 deepseek-v4-pro 静默重写为 deepseek-chat(GitHub Issue #16160)。表现为:你在配置中写了 deepseek-v4-pro,实际调用的是 deepseek-chat(即旧版 V3 Flash 对应 ID)。

规避方案:

# 方法 1:更新到最新版本(推荐,已修复)

hermes update

# 方法 2:临时使用 custom provider 绕过规范化

# 在 config.yaml 中将 provider 改为 custom 而非 deepseek

# 规避方案:使用 custom provider 直接指定端点(不经过模型名规范化)

model:

provider: custom # 关键:用 custom 而非 deepseek

model: deepseek-v4-pro # 此时模型名直接透传,不经规范化

base_url: https://api.deepseek.com/v1

api_key: ${DEEPSEEK_API_KEY}

Bug:旧模型 ID 即将弃用

deepseek-chat(旧 V3 Flash 对应 ID)和 deepseek-reasoner 将于 2026 年 7 月 24 日弃用。如配置中仍使用这两个 ID,请迁移:

# 迁移命令

hermes config set model deepseek/deepseek-v4-flash # 替代 deepseek-chat

hermes config set model deepseek/deepseek-v4-pro # 替代 deepseek-reasoner

V4 Flash vs V4 Pro:Hermes Agent 场景选型

成本参考(10 轮工具调用,每轮 2K 输入 + 1K 输出):

V4 Flash:输入 20K×$0.14 = $0.0028,输出 10K×$0.28 = $0.0028 → 约 $0.006/任务

V4 Pro: 输入 20K×$1.74 = $0.0348,输出 10K×$3.48 = $0.0348 → 约 $0.070/任务

Claude Opus 4.7:约 $0.525/任务(V4 Flash 的约 87 倍)

FAQ

Q1:Hermes Agent 接入 DeepSeek V4 是否需要特殊申请或权限?

不需要。DeepSeek 是 Hermes Agent 内置支持的 24+ 供应商之一,直接在 platform.deepseek.com 申请 API Key 后,通过 hermes model 向导或直接编辑 config.yaml 即可接入,无需任何特殊申请流程。

Q2:DeepSeek V4 的 1M 上下文在 Hermes Agent 中实际能用到吗?

能用到,但 Hermes Agent 会在会话超过 compression_threshold(默认 80K tokens)时自动压缩历史对话。DeepSeek V4 的 1M 上下文优势体现在:① 单次工具调用可以传入完整大型代码文件(50 万行 ≈ 500K tokens);② 长会话压缩前可携带更多历史上下文;③ 1M 上下文让 /compress 操作更晚触发,减少信息损失。

Q3:在 Hermes Agent 中如何临时切换到 V4 Pro 测试效果?

# 单次运行临时使用 V4 Pro,不修改默认配置

hermes chat -m deepseek-v4-pro --provider deepseek

# 或在会话内通过 /model 切换(需已配置该供应商)

/model deepseek/deepseek-v4-pro

Q4:七牛云 AI 推理 API 接入时,base_url 应该填 /v1 结尾还是不填?

OpenAI 协议(deepseek-v4-flash/deepseek-v4-pro)使用 https://api.qnaigc.com/v1(带 /v1);Anthropic 协议(claude-opus-4-7)使用 https://api.qnaigc.com(不带 /v1)。在 Hermes Agent config.yaml 中,两种插槽分别填对应的 base_url 即可。

Q5:Hermes Agent + DeepSeek V4 的多通道(Telegram/Discord/Slack)能正常工作吗?

完全正常。Hermes Agent 的通道层(消息平台集成)与模型层完全解耦,切换为 DeepSeek V4 不影响任何通道配置。Telegram、Discord、Slack、WhatsApp 等 15+ 通道的工具调用、回复格式、流式输出均与其他模型一致。

总结

将 DeepSeek V4 接入 Hermes Agent 的最快路径是 hermes model 向导(3 分钟完成),生产环境推荐直接编辑 ~/.hermes/config.yaml 实现多插槽精细化控制。 三个关键配置点:① 用 provider: deepseek + base_url: https://api.deepseek.com/v1 接入原生端点,或用 base_url: https://api.qnaigc.com/v1 国内直连;② 主 Agent 用 V4 Pro + thinking 深度推理,辅助插槽用 V4 Flash + thinking disabled 控制成本;③ 如遇到模型名被静默转换的旧版 Bug,改用 provider: custom 直接透传模型 ID 可绕过。

数据来源:NousResearch/hermes-agent GitHub README(2026.04);Hermes Agent 官方文档(hermes-agent.nousresearch.com/docs,2026.04);DeepSeek API 文档(api-docs.deepseek.com,2026.04)| 信息时效:2026 年 4 月

相关资源:

● NousResearch/hermes-agent:Hermes Agent 官方 GitHub(118k Stars),MIT 开源,含完整安装和配置文档

● Hermes Agent 官方文档:配置参考、CLI 命令、Slash Commands 完整速查

● DeepSeek 平台 API Key 申请:V4-Flash 和 V4-Pro 官方接入,国内直连

● DeepSeek API 定价页:V4-Flash $0.14/M,V4-Pro $1.74/M,含缓存命中费率

● 七牛云 AI 推理 API Key:国内直连节点,支持 DeepSeek V4 / Claude Opus 4.7 / Kimi K2.6,一个 Key 在 Hermes Agent 中统一管理多模型,新用户 300 万 tokens 免费资源包