【开发者周报】谷歌发布“自家最强”VLA模型/Claude再度进化/小米AI眼镜首发/大模型“高考”出分/Kimi-VL新版开源

【开发者周报第1期】2025/06/23-06/27

更多精彩内容请访问www.qiniu.com

刚刚,AI大模型的参数规模可能又突破了某个量级,具身智能机器人或许刚学会更自然的「手眼协调」,多模态交互的应用场景正从实验室走向真实生活……我们为你筛出了最值得关注的5件大事,带你穿透信息泡沫,直抵技术内核。开发者的故事,从这里开始:

Fast Reading:

快速抓重点

1、谷歌发布“自家最强”VLA模型

2、Claude 让每个人都能开发 AI 应用

3、小米首款AI眼镜正式发布

4、最高683分!大模型“高考”出分

5、多指标超GPT-4o!月之暗面Kimi-VL新版开源

内容详情

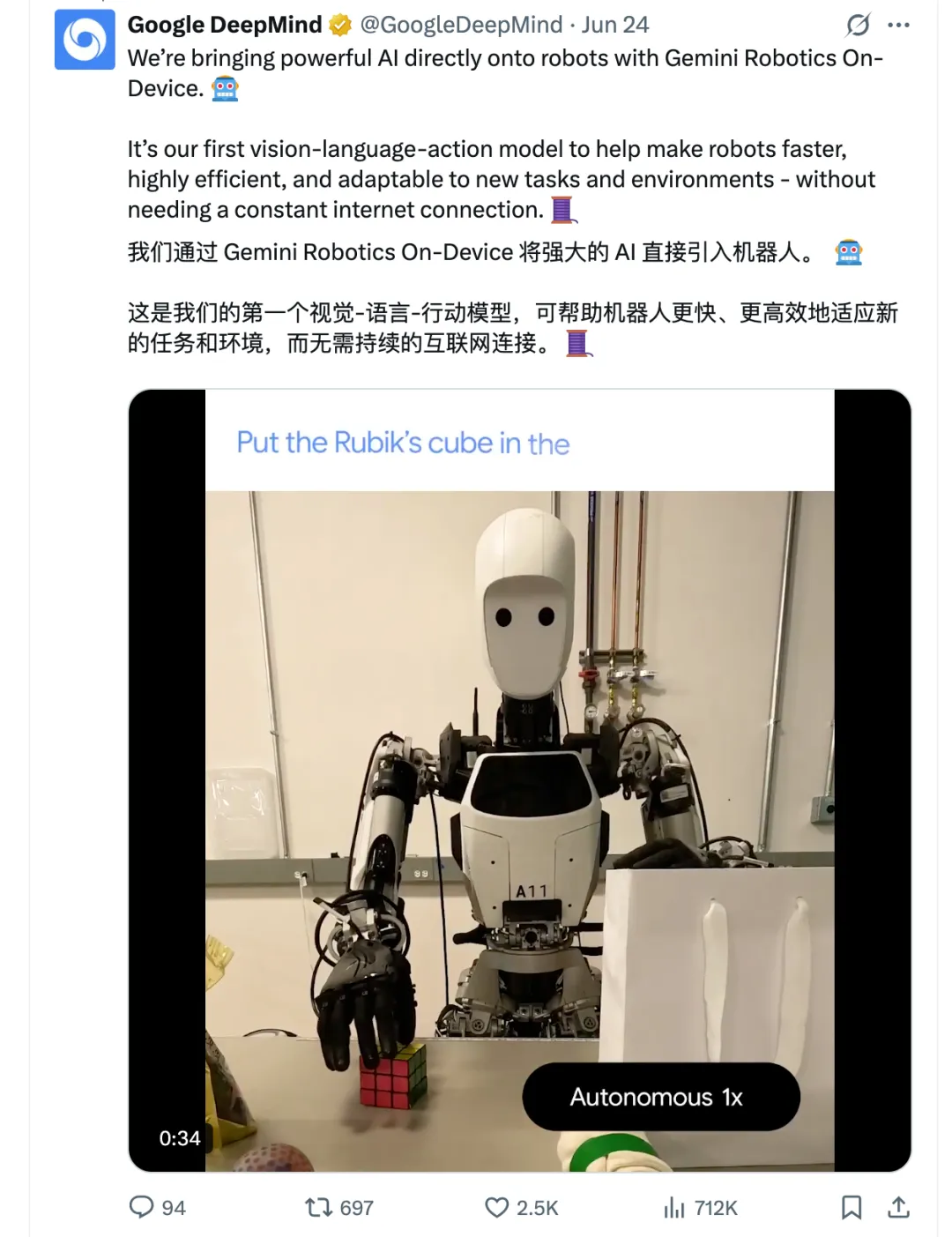

1、给机器人装上“离线大脑”+“安卓系统”,谷歌端上“自家最强”VLA模型

近日,谷歌DeepMind正式发布Gemini家族新成员——Gemini Robotics On-Device,这是其首个可直接部署于机器人的视觉-语言-动作(VLA)模型,旨在通过本地高效运行,助力机器人快速适应新任务与环境,无需依赖持续互联网连接。

该模型基于Gemini 2.0多模态推理能力构建,属Gemini Robotics系列(今年3月首次发布),经优化可在机器人本体上实现低延迟推理,尤其适用于延迟敏感型或断网场景。实验显示,其具备强大任务泛化与跨具身适应能力:仅需50-100个演示即可微调适应新任务,能完成拉开袋子拉链、折叠衣物等高度灵巧操作;且可跨ALOHA、Franka FR3双臂机器人及Apollo人形机器人等不同机型泛化,处理未见过的物体与场景。

针对开发者,DeepMind将同步推出Gemini Robotics SDK,支持在MuJoCo物理模拟器中快速测试与适配新领域(注:MuJoCo Playground联合团队近期获机器人科学与系统会议RSS 2025杰出演示论文奖)。

DeepMind表示,此模型标志着机器人模型向“更易获取、更易适应”迈出关键一步,推动具身智能技术迈向新阶段。

2、Anthropic 重磅更新:Claude 让每个人都能开发 AI 应用

人工智能公司 Anthropic 宣布其 Claude 聊天机器人新增一项重磅功能,允许用户直接在应用内构建由 AI 驱动的应用程序。该功能目前已正式上线,是基于去年推出的 Artifacts 功能的全面升级。

在官方博客中,Anthropic 表示:"通过启用这项新的交互功能,用户可以在 Claude 应用中开始构建自己的应用程序。只需简单描述你想要创建的内容,Claude 就会为你编写代码。"这意味着,即使完全不懂编程的用户,也能通过自然语言对话的方式,让 AI 帮你开发出功能完整的应用程序。

据 Anthropic 介绍,早期使用该功能的用户已经成功构建了多种类型的 AI 驱动应用程序:

AI 游戏:带有智能 NPC 的互动游戏

学习工具:个性化教学应用和智能单词卡

数据分析应用:上传表格就能自然语言查询

写作助手:针对特定需求的创作工具

智能体工作流:协调多次调用 Claude 的复杂任务应用

这些应用程序都能通过 API 与 Claude 进行实时交互,实现真正的智能化体验。

3、小米首款AI眼镜正式发布,售价1999元起

6月26日晚,小米创办人、董事长兼CEO雷军在小米人车家全生态发布会上,正式发布首款AI眼镜,售价1999元起并已开售。该产品定位“面向下个时代的个人智能设备”,支持实时语音问答(唤醒小爱同学)、第一人称视角拍摄(健身/骑行等场景)、第三方APP视频通话/直播,专为亚洲脸型优化(仅重40g),兼具开放式耳机功能,强调全天佩戴舒适性。

这是小米在AI硬件领域的一次关键突破,标志着个人智能设备向“随身AI入口”形态进阶:通过轻量化设计(40g)、场景化交互(实时问答+第一视角记录)及多模态能力(语音+视觉+音频),重新定义了“人机交互”的便捷性与实用性,推动AI从“工具”向“日常陪伴者”升级,也为消费电子行业探索AI硬件的新形态提供了参考样本。

对开发者而言,小米AI眼镜的第三方APP适配(如视频通话、直播)将催生更多针对“第一视角交互”的场景化应用开发需求;其“随身AI入口”的定位,可能推动开发者围绕“实时语音交互+场景感知”优化算法与服务;此外,轻量化设计与开放式耳机的融合,或引导开发者关注AI设备在“日常穿戴”场景下的用户体验,加速AI技术与消费硬件的深度协同创新。

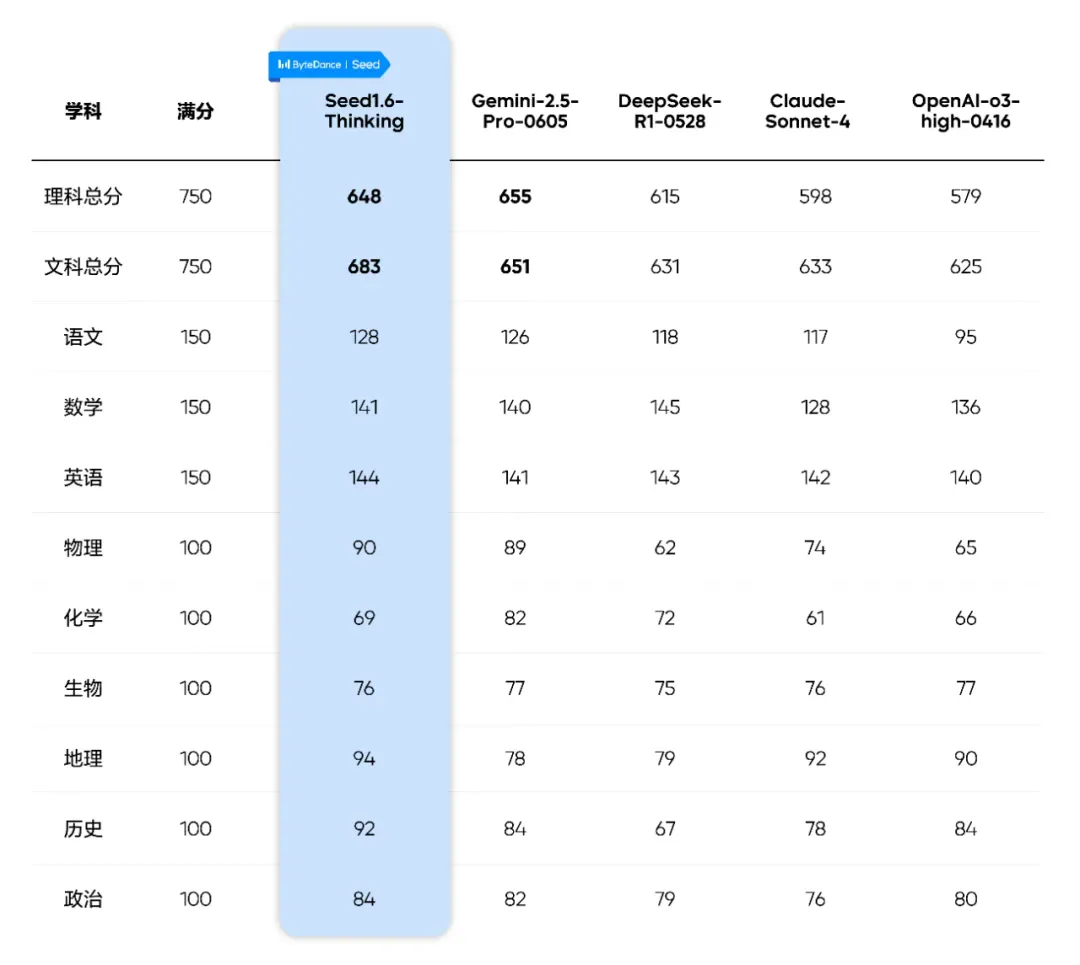

4、高考出分!5款大模型考「山东卷」,Gemini、豆包分别获文理第一名

近日字节跳动 Seed 团队集结了五款主流推理模型—— Seed 1.6-Thinking、DeepSeek-R1-0528,以及国外大模型 Gemini-2.5-Pro-0605、Claude-Sonnet-4、OpenAI-o3-high-0416,用 2025 年山东高考真题(主科全国 Ⅰ 卷 + 副科自主命题)进行全科闭卷测评,以高考 750 分制对 AI 的「应试能力」展开硬核比拼。

按照传统的文理分科方式统计得分:

文科成绩:

豆包Seed1.6-Thinking以683分夺冠,其地理(94分)和历史(92分)表现尤为突出,展现了强大的逻辑推理和文本分析能力。相比之下,Claude Sonnet-4(633分)和OpenAI-o3(625分)在政治科目存在明显短板,主要因教材观点关联不足导致失分。

理科成绩:

Gemini2.5-Pro以655分位居榜首,物理(89分)和化学(82分)优势显著,尤其在图像类题目中表现稳定。豆包虽以648分紧随其后,但通过高清图像重测后理科总分可提升至676分,显示多模态能力的潜力。DeepSeek-R1虽数学接近满分(145分),但物理科目仅得62分,拉低总分。

技术突破与挑战:

多模态能力成关键:图像题占比达36%,豆包通过图文交织输入法在生化科目提升30分,验证了全模态推理的价值;

理科差距显著:头部模型理科总分(约650分)仍低于文科(680+分),反映图像处理和复杂公式推导仍是难点;

迭代速度惊人:对比去年媒体公开的大模型高考评测数据,豆包今年理科成绩暴涨181.5分,文科提升140.5 分,显示大模型学习效率的大幅提升。

此次测评表明,大模型已超越普通考生水平(山东一段线441分),部分模型达到清北录取线(预估赋分后超690分)。未来随着多模态技术的深化,AI在复杂问题解决领域的应用前景值得期待。

5、3B挑战70B!月之暗面Kimi-VL新版开源:数学、视频等多项指标超越GPT-4o

日前,月之暗面开源多模态模型Kimi-VL-A3B-Thinking-2506,这是其首个开源多模态推理模型Kimi-VL-A3B-Thinking发布两个月后的更新版本,可凭借2.8B激活参数(16B总参数)在多项测评中超越GPT-4o、Qwen2.5-VL-7B等模型。

这一突破标志着轻量化多模态模型进入新阶段:通过混合专家架构(MoE)、原生高分辨率视觉编码器(MoonViT)及多模态深度融合机制,模型实现了“小参数、强性能”的高效推理,重新定义了模型能效标准;同时,其在数学推导、长视频分析等复杂任务中的表现,验证了多模态技术与大模型学习的快速迭代能力,推动技术向普惠化发展。

对开发者而言,模型支持Hugging Face、VLLM双平台快速部署,且MIT协议允许商用,大幅降低了接入成本;行业层面,其轻量化特性适配边缘设备,可快速落地智能客服(屏幕指令执行准确率92.8%)、医疗影像(病灶识别超90%)等场景;此外,开源生态衍生出法律文书分析、工业质检等20+应用案例,加速多模态技术在千行百业的普及。