AI Agent私有化部署实战:用MCP协议打破工具孤岛

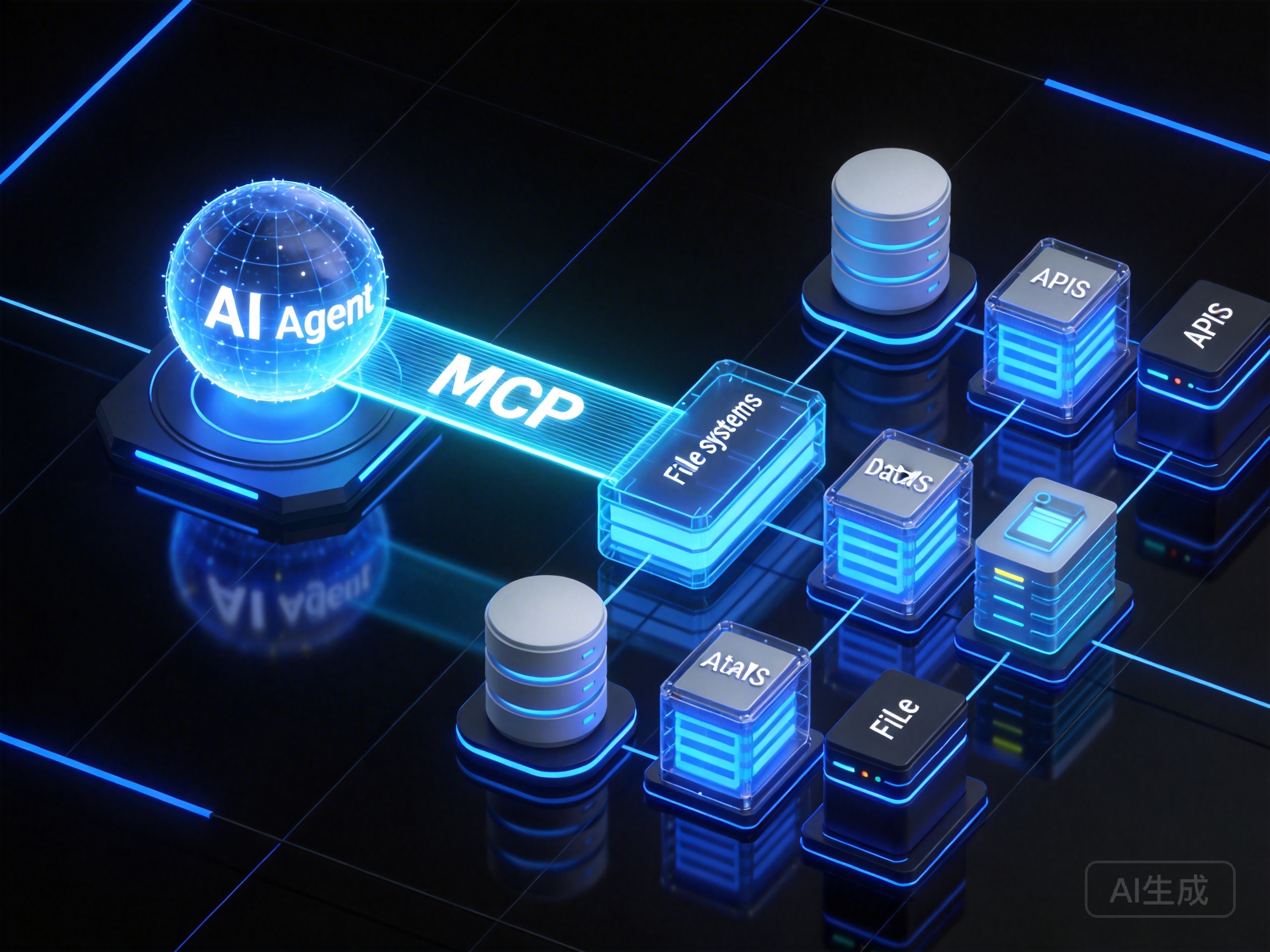

在企业数字化转型的深水区,单纯接入一个聊天机器人的时代已经过去。现在的焦点是如何让大模型“长出手脚”,去操作数据库、执行代码、甚至管理云资源。这就是 AI Agent 的核心价值——它不再只是一个能说会道的“大脑”,而是一个能干活的“数字员工”。

然而,当你试图将这种能力落地到企业内部时,安全与效率的矛盾立刻显现:数据不能出域,工具链却极其复杂。如何在保证数据隐私的前提下,让 AI Agent 流畅地调用几十甚至上百个内部工具?本文将带你深入探讨 AI Agent私有化部署 与 MCP(Model Context Protocol)协议结合的实战方案。

告别胶水代码:基于MCP协议开发AI Agent

过去开发一个能查天气又能发邮件的 Agent,开发者往往需要写大量的“胶水代码”来适配不同的 API 接口。一旦某个工具的接口变动,整个 Agent 的工具调用逻辑就得重写。这种紧耦合的架构是 企业级AI Agent架构设计方案 中的大忌。

MCP 协议的出现,就像给 AI Agent 装上了通用的 USB 接口。它标准化了模型与工具之间的通信方式。通过 MCP,你可以将内部的 CRM 系统、运维脚本甚至本地文件系统封装成标准的 Server,Agent 作为 Client 可以即插即用。

对于希望快速验证这一架构的开发者,七牛云提供的 MCP服务 是一个理想的起点。它不仅兼容 OpenAI Agent 协议,还实现了云端的安全聚合。这意味着你不需要在本地费力搭建复杂的运行环境,就能让你的 Agent 直接获得操作云端资源的能力,完美解决了多工具编排中的“环境地狱”问题。

DeepSeek构建智能体教程:从推理到行动

有了连接工具的标准协议,下一步就是选择一个足够聪明的“大脑”来驱动这些工具。DeepSeek 系列模型凭借其强大的逻辑推理能力,成为了近期 DeepSeek构建智能体教程 中的热门选择。

在实战中,我们发现单纯的模型推理往往不够,关键在于如何让模型准确理解 MCP 暴露出来的工具描述。比如,当用户指令是“帮我重启昨晚报错的服务器”时,模型需要先调用日志工具查询报错信息,锁定服务器 ID,再调用运维工具执行重启。

为了降低这一过程的开发门槛,你可以参考这份 Agent 实战指南。文档中详细拆解了如何利用 DeepSeek 配合 OpenAI SDK,通过 Function Calling 机制精准触发 MCP 工具。这种组合不仅大幅提升了意图识别的准确率,还让 AI Agent如何实现多工具调用 变得像写伪代码一样直观。

攻克最后一公里:AI Agent沙箱安全环境搭建

解决了连接和推理,企业落地面临的最后一个拦路虎是安全。AI Agent私有化部署 的核心诉求往往是为了防止敏感数据外泄,但 Agent 执行代码或调用工具本身也存在风险。如果一个 Agent 被恶意 Prompt 注入,它会不会删库跑路?

构建一个隔离的 AI Agent沙箱安全环境搭建 至关重要。在私有化部署方案中,我们通常建议将 Agent 的执行层(Action)与推理层(Reasoning)物理分离。推理层可以依托高性能的 AI大模型推理服务 来实现,该平台集成了 Claude、DeepSeek 等顶级模型,支持高并发的 Token 吞吐,确保“大脑”转得够快。而执行层则应运行在受限的容器或虚拟机中,通过 MCP 协议进行受控通信。

这种架构不仅保护了核心业务数据,也让企业能够灵活替换底层的推理模型,而不必担心重构整个业务逻辑。毕竟,在 AI 快速迭代的今天,保持架构的灵活性就是保持竞争力。

通过 MCP 标准化工具接口,配合 DeepSeek 强大的推理能力,再加上云端托管的推理服务与沙箱机制,企业级 AI Agent 的落地不再是遥不可及的构想,而是一套可复制、可扩展的工程化方案。