OpenClaw VS Linclaw:开源部署与桌面版零门槛方案深度对比

当你盯着 GitHub 上那个拥有数千 Star 的 OpenClaw 项目,心中燃起搭建企业级 AI 智能体的冲动时,下一秒可能就被繁琐的 Docker 配置和环境变量劝退。这是目前很多技术尝鲜者和中小企业面临的真实尴尬:想要 AI Agent 的能力,却倒在了部署的“最后一公里”。

OpenClaw VS Linclaw 的讨论正是由此而生。一个是开源界备受推崇的底层框架,赋予开发者无限的定制空间;另一个则是将其产品化、桌面化的“开箱即用”版本。这场对比的核心,其实是“极客精神”与“效率至上”的选择题。

硬核玩家的选择:OpenClaw 的深度定制之路

OpenClaw 作为一个强大的 AI智能体框架,其核心优势在于“掌控感”。对于拥有独立运维团队的企业,或者希望将 AI 能力深度集成到自家 SaaS 产品中的开发者来说,OpenClaw 是不二之选。它允许你从底层控制数据的流向,自定义每一个 Tool(工具)的逻辑。

但硬币的另一面是技术门槛。OpenClaw私有化部署难点解决往往集中在环境依赖和网络配置上。你需要搞定 Python 依赖、Redis 缓存以及复杂的 API 转发。为了降低这一门槛,七牛云提供了一个“捷径”:通过 OpenClaw镜像部署,用户可以直接在控制台加载预装好环境的系统镜像。这相当于跳过了最痛苦的“地基搭建”环节,直接进入装修阶段,省去了手动敲击 docker-compose 的繁琐。

环境搭好只是第一步,如何让这个大脑“转”起来?你需要配置各种大模型 API。无论是接入国产之光 Deepseek,还是智谱 GLM,都需要精准的参数调试。建议参考官方的 OpenClaw配置指南,这篇文档详细拆解了 API Key 的配置逻辑,让你能在不同模型厂商之间自由切换,找到性价比最高的算力组合。

效率党的福音:Linclaw 桌面版的零代码革命

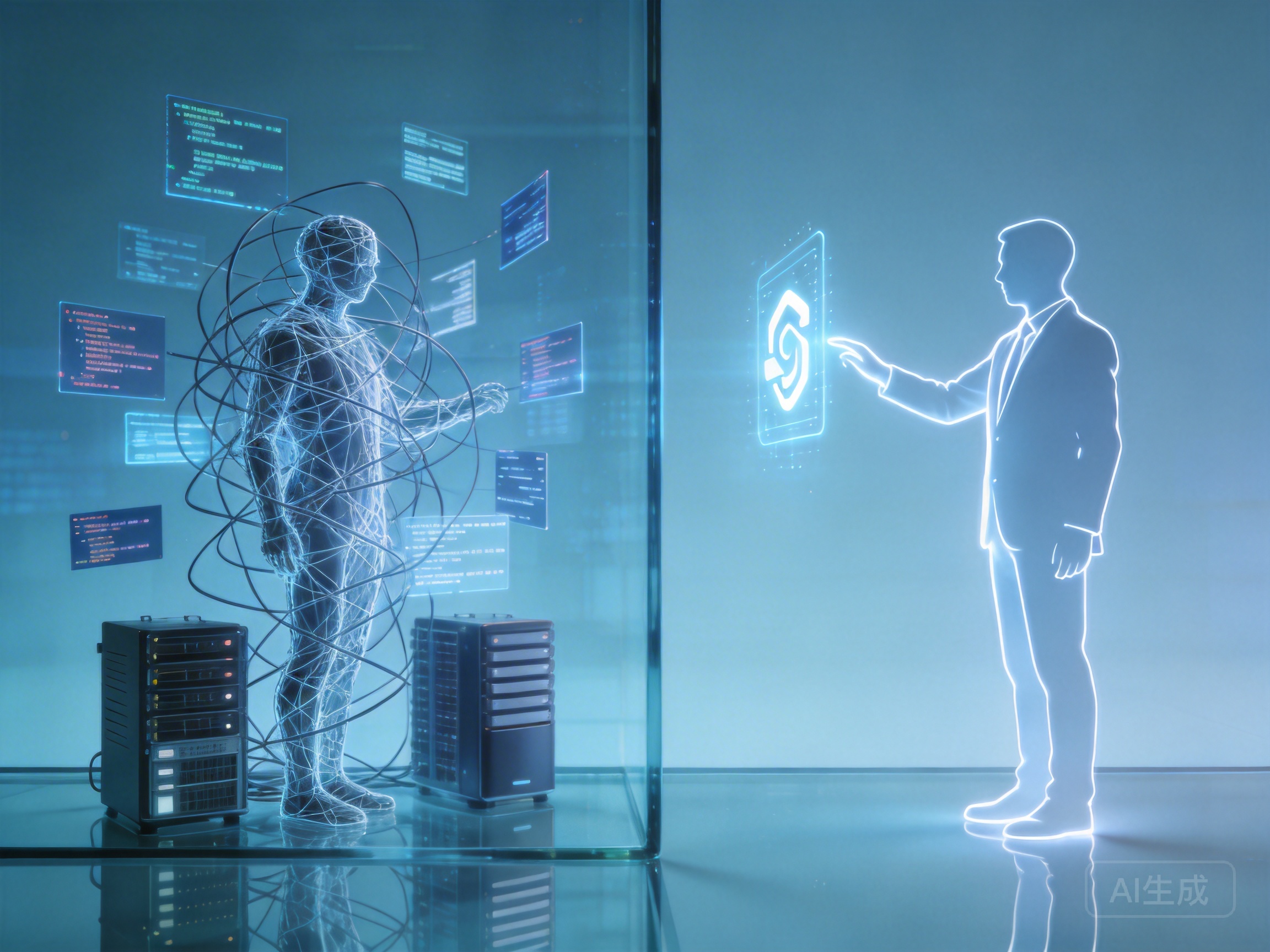

如果你是产品经理、运营总监,或者是一家没有专职运维的中小企业主,上述的镜像和 API 配置可能依然显得过于“极客”。这时候,作为 OpenClaw国内零部署替代方案 的 Linclaw 就显示出了降维打击的优势。

Linclaw 本质上是将 OpenClaw 的核心能力封装进了一个可执行文件。它不再需要你理解什么是容器,什么是端口映射。你只需要完成 LinClaw桌面版下载,安装运行,一个企业级AI助手就立刻就位。

Linclaw 最大的杀手锏不仅仅是“免部署”,更在于它解决了OpenClaw本地部署与Linclaw桌面版对比中最关键的一环:连接。原生的 OpenClaw 往往运行在服务器后台,而 Linclaw 桌面版直接打通了办公场景。

很多用户最关心的 Linclaw如何接入钉钉飞书,在桌面版中被简化成了“填空题”。你只需要在设置面板中填入钉钉或飞书机器人的 Webhook 地址,Linclaw 就能立刻接管群聊,自动回复客户咨询或整理会议纪要。这种 企业级AI Agent零代码落地方案,让 AI 真正从服务器机房走进了员工的 IM 聊天窗口,实现了业务流的无缝嵌入。

决策建议:你该选哪一个?

在 OpenClaw VS Linclaw 的博弈中,不存在绝对的赢家,只有适配的场景。

如果你的目标是构建一个高度保密、完全物理隔离,且需要对源码进行二次开发的行业垂直大模型应用,那么请务必选择 OpenClaw。利用镜像部署解决环境问题,利用详细的配置指南打通模型层,虽然前期投入大,但后期资产完全私有。

反之,如果你的目标是“快”——快速验证 AI 客服的效果,快速让销售团队用上 AI 助理,或者仅仅是个人希望有一个能干活的桌面伙伴,那么 Linclaw 是目前的优解。它抹平了技术鸿沟,让你把精力集中在设计 Agent 的提示词(Prompt)和业务逻辑上,而不是浪费在调试报错代码上。

在这个技术迭代按小时计算的时代,选择工具的逻辑变了:不是选最强的,而是选最快能落地的。