七牛云AI漫剧实战:多模型协同生成高一致性短剧分镜

七牛云AI漫剧实战:多模型协同生成高一致性短剧分镜

做过AI视频的朋友都知道,最折磨人的不是写不出剧本,而是当你好不容易生成了第一张完美的主角脸,第二张分镜里她就“整容”了。角色一致性,是目前AI短剧制作中最大的拦路虎。很多创作者在从单张图走向连续剧情时,往往被这个问题劝退。今天我们不谈那些虚无缥缈的概念,直接上手实操,看看如何利用七牛云AI漫剧的技术栈,解决这个痛点。

告别“抽卡”式创作:七牛云漫剧解决方案

传统的AI绘图往往像是在“抽卡”,你输入一段咒语,然后祈祷模型给你一张好图。但在连续短剧中,这种随机性是致命的。我们需要的是可控性。

这就不得不提七牛云AI漫剧解决方案的核心逻辑。它不是一个简单的画板,而是一个集成了多模态模型的工作流平台。在这里,你不再是单纯地生成图片,而是在构建一个“资产库”。

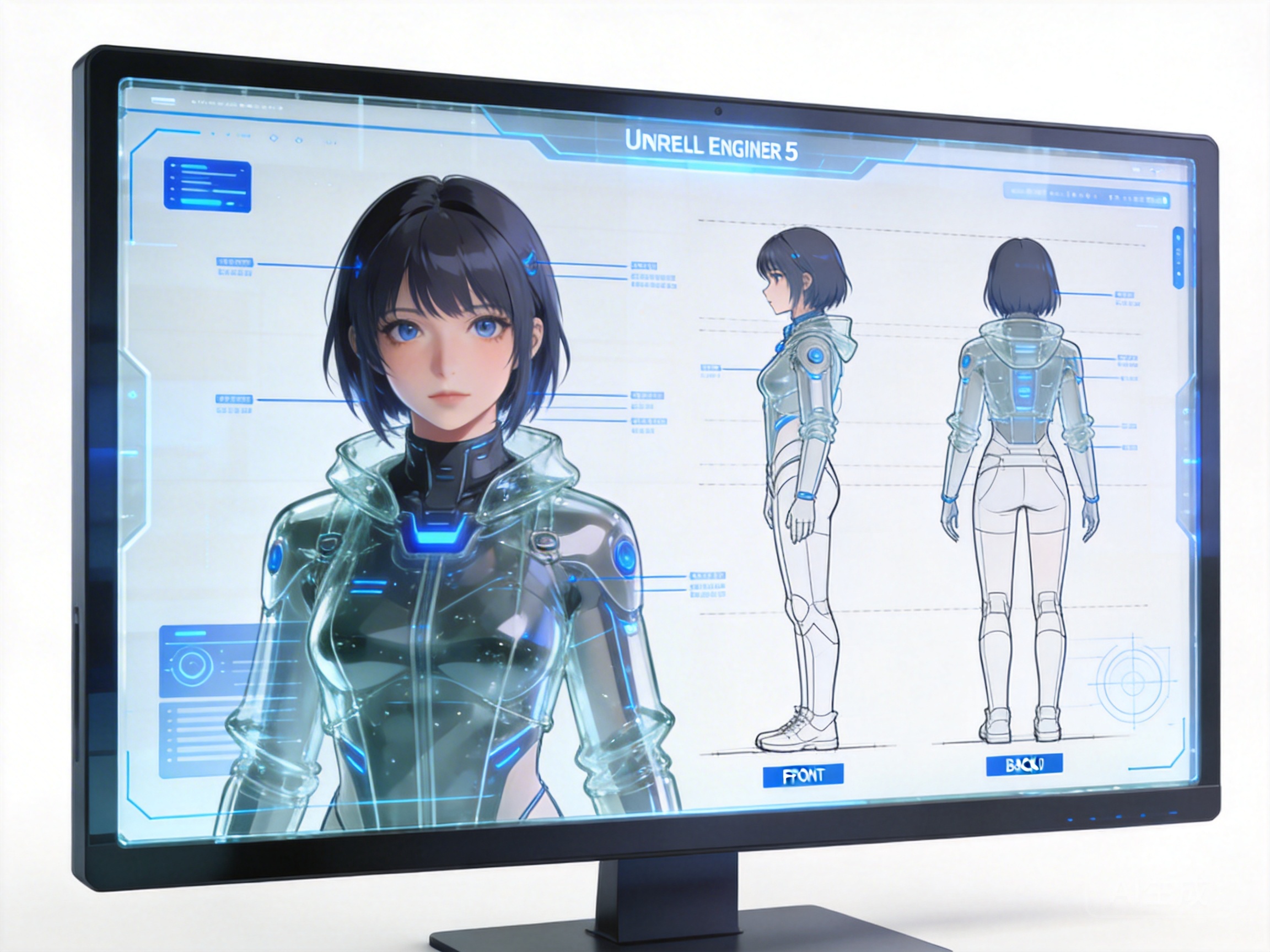

实战中,我们通常先用Midjourney或Stable Diffusion生成一套标准的角色三视图(正面、侧面、背面),然后将这些基础资产导。在生成后续分镜时,系统会强制参考这些基础图像的特征向量。比如你想生成“主角在雨中奔跑”的画面,系统不会凭空捏造一张脸,而是会先检索你上传的主角特征,再结合环境提示词进行渲染。这就是分镜生成流程中至关重要的一步:特征锁定。

这种方式极大地降低了废片率。以前你可能需要生成50张图才能挑出一张长得像主角的,现在通过这种多模型协同的约束机制,往往3-5张就能得到可用素材。

多模型协同:Seedance与Kling的接力赛

单一模型很难通吃所有场景。有的模型擅长画脸,有的模型擅长做动作。七牛云AI漫剧的一大优势就是整合了Seedance、可灵(Kling)、Sora、Veo等顶尖模型。

在一个多模型协同制作短剧的实战案例中,我们尝试制作一部悬疑短剧。对于静态的对话特写镜头,我们调用擅长面部微表情的生图模型;而对于复杂的打斗或追逐戏,我们则通过视频生成模型API调用Kling或Veo的能力。

这里有一个关键技巧:不要试图让一个模型一次性生成完美的视频。正确的做法是“分层生成”。先用高质量生图模型定格关键帧,确保AI漫剧角色一致性解决方案生效,然后再将这张图作为“首帧参考”,输入到视频生成模型中让它动起来。

通过七牛云的开发者中心,你可以查阅详细的API文档,了解如何通过代码精准控制这些模型的参数,比如运动幅度(Motion Score)和重绘强度(Denoising Strength),从而在保持角色脸部不崩坏的前提下,让动作尽可能流畅。

智能剪辑:从素材堆到成片的最后一公里

分镜生成好了,视频片段也有了,最后一步是组装。这一步往往被忽视,但其实非常耗时。

传统剪辑需要人工去听每一句台词,对口型,找节奏。而七牛云的智能剪辑解决方案提供了一种更高效的思路。它不仅仅是把视频拼在一起,而是通过算法理解视频内容。

系统会对海量的音视频素材进行结构化分析。比如,你设定了一个“紧张”的标签,算法会自动识别出画面中表情严肃、镜头切换快速的片段,并结合声纹比对,自动匹配对应的角色台词。这种基于“音画一致性对比”的技术,能帮创作者省去大量粗剪的时间。你只需要在生成的初版上进行艺术微调,而不是从零开始在那堆素材里在大海捞针。

结语

AI短剧的制作正在从“玩具”变成“工具”。未来的创作者,比拼的不再是谁的提示词写得更长,而是谁能更熟练地驾驭这些多模型协同的工作流。利用七牛云AI漫剧提供的这些基础设施,我们终于可以将精力从“修脸”中解放出来,真正回归到故事和创意本身。毕竟,技术是为了让想象力落地,而不是成为想象力的枷锁。