OpenClaw怎么省Token?上下文压缩与模型分级实操

在搭建企业级 AI 知识库或智能客服时,开发者最常遇到的痛点就是 Token 消耗像流水一样止不住。尤其是当你使用像 OpenClaw 这样强大的开源工具进行多轮对话或复杂任务处理时,如果不加控制,昂贵的 API 账单很快就会让你怀疑人生。很多用户都在问 OpenClaw怎么省token?其实,单纯靠“少说话”是解决不了问题的,真正的省钱之道在于精细化的配置优化与架构设计。本文将避开市面上泛泛而谈的“缩短提示词”,带你深入 OpenClaw 的内核,通过上下文压缩策略与模型分级路由,实现成本的指数级下降。

告别无效记忆:OpenClaw上下文压缩实战

在长对话场景中,AI 往往需要携带大量的历史聊天记录作为上下文,这正是 Token 消耗的重灾区。很多新手在进行 OpenClaw配置优化 时,容易忽略“记忆窗口”的精细化设置。OpenClaw 并非只能一股脑地把所有历史记录塞给大模型,它支持灵活的记忆压缩机制。

针对 OpenClaw长对话记忆压缩设置,我们建议采用“摘要+滑动窗口”的混合策略。与其保留逐字逐句的对话,不如让系统每隔几轮对话就自动生成一段精炼的摘要。这样,传递给模型的不再是冗长的聊天记录,而是高密度的信息概括。

如果你是刚开始接触这套系统,可以先参考 OpenClaw 安装配置指南 完成基础环境搭建。在配置文件中,你可以找到关于 Context Window 的参数,将其设置为动态调整模式,对于非关键性的闲聊内容,直接进行截断或丢弃,只保留与当前任务强相关的上下文。这种“断舍离”的配置,能让单次调用的 Token 消耗降低 40% 以上。

聪明人的选择:模型分级与路由策略

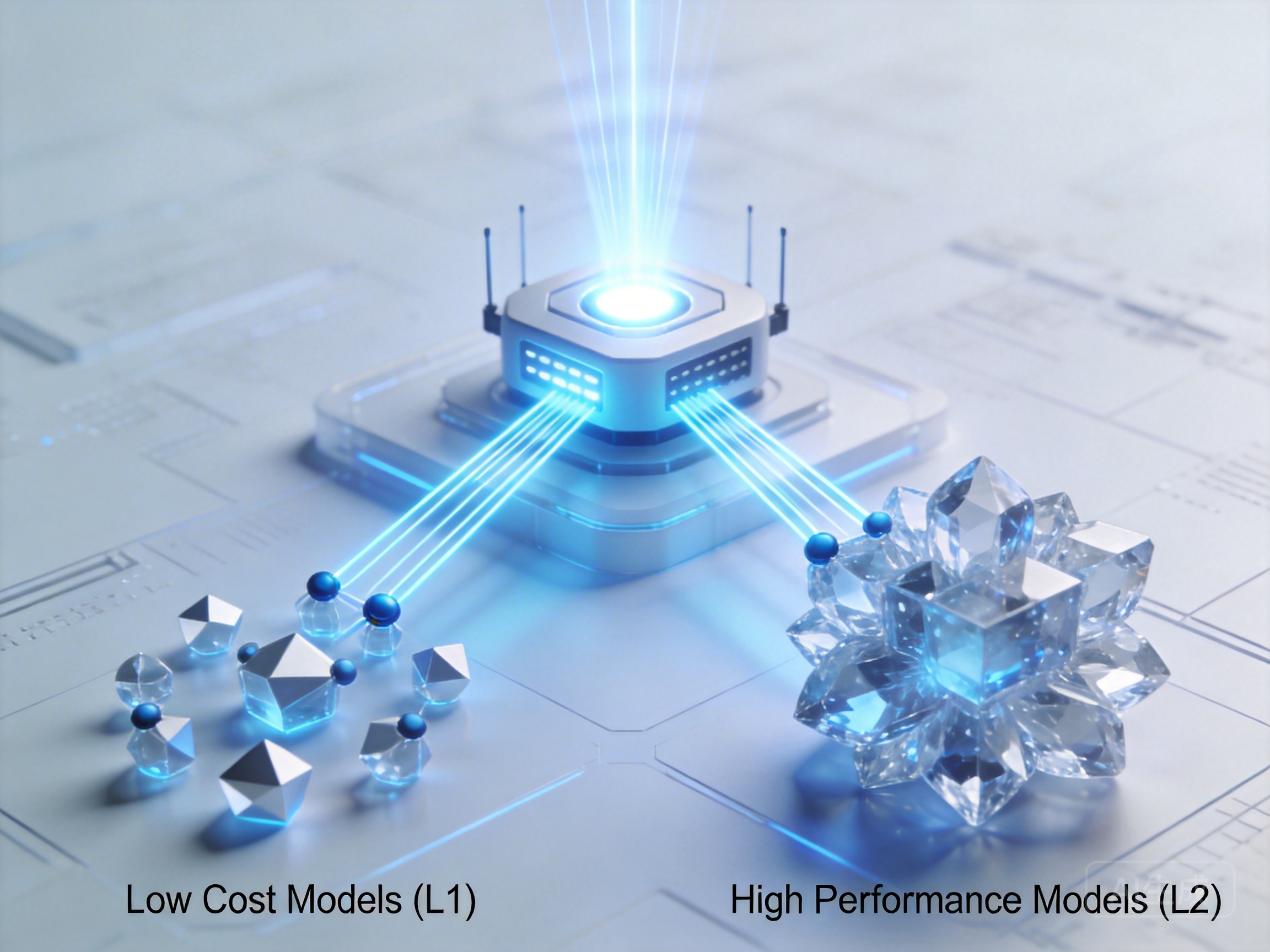

除了压缩上下文,另一个经常被忽视的 OpenClaw怎么省token 的技巧是“因材施教”。并不是所有的问题都需要动用 GPT-4 或 Claude 3.5 Sonnet 这样昂贵的“顶配”模型。对于简单的问候、意图识别或格式化输出,使用参数量较小、成本极低的模型完全绰绰有余。

这就是 OpenClaw模型分级 的核心逻辑。你可以构建一个简单的路由层(Router),根据用户问题的复杂度进行分流。

- L1 层(低成本):处理“你好”、“天气怎么样”等简单指令,直接对接 DeepSeek-V3 或 MiniMax 等高性价比模型。如果你正在寻找 OpenClaw对接DeepSeek低成本方案,这绝对是首选路径。

- L2 层(高性能):当遇到复杂的逻辑推理、代码生成或创意写作时,再自动切换到 Claude 3.5 或 GPT-4。

要实现这种灵活的切换,稳定且多样的模型源至关重要。推荐使用 七牛云AI推理服务,它集成了 Claude、Gemini、MiniMax、DeepSeek 等顶级模型,并且完美兼容 OpenAI API 格式。这意味着你不需要修改 OpenClaw 的核心代码,只需要在配置文件中更改 API Endpoint 和 Key,就能瞬间拥有一个包含多种“档位”的模型库,实现真正的按需调用。

本地知识库与零部署替代方案

对于企业内部数据,OpenClaw本地知识库搭建教程 是另一个热门需求。通过 RAG(检索增强生成)技术,我们可以只将检索到的、最相关的文档片段发送给模型,而不是把整本书扔进去。这不仅大幅提升了回答的准确率,更是从源头上控制了 Input Token 的数量。在配置 RAG 时,务必优化切片(Chunking)策略,过大的切片会浪费 Token,过小的切片会丢失语义,建议设置在 512-1024 Token 之间。

当然,如果你觉得手动配置 Docker、调试 Python 环境太折腾,或者只是想快速验证这套“省钱逻辑”,不妨试试 LinClaw桌面版。作为七牛云推出的桌面版 OpenClaw,它主打零部署,开箱即用,并且已经内置了许多上述的优化策略。更棒的是,它支持钉钉、飞书、QQ 多平台接入,让你在桌面端就能直接体验到经过优化的 Token 消耗控制,特别适合非技术背景的产品经理或运营人员快速上手。

通过合理的 OpenClaw上下文压缩 和精明的模型路由,你会发现 AI 的使用成本完全在可控范围内。省 Token 不是目的,用同样的预算创造更大的业务价值,才是 AI 工程化的终极目标。