GPT-5.4解密:从Mini模型架构到企业级Agent落地实战

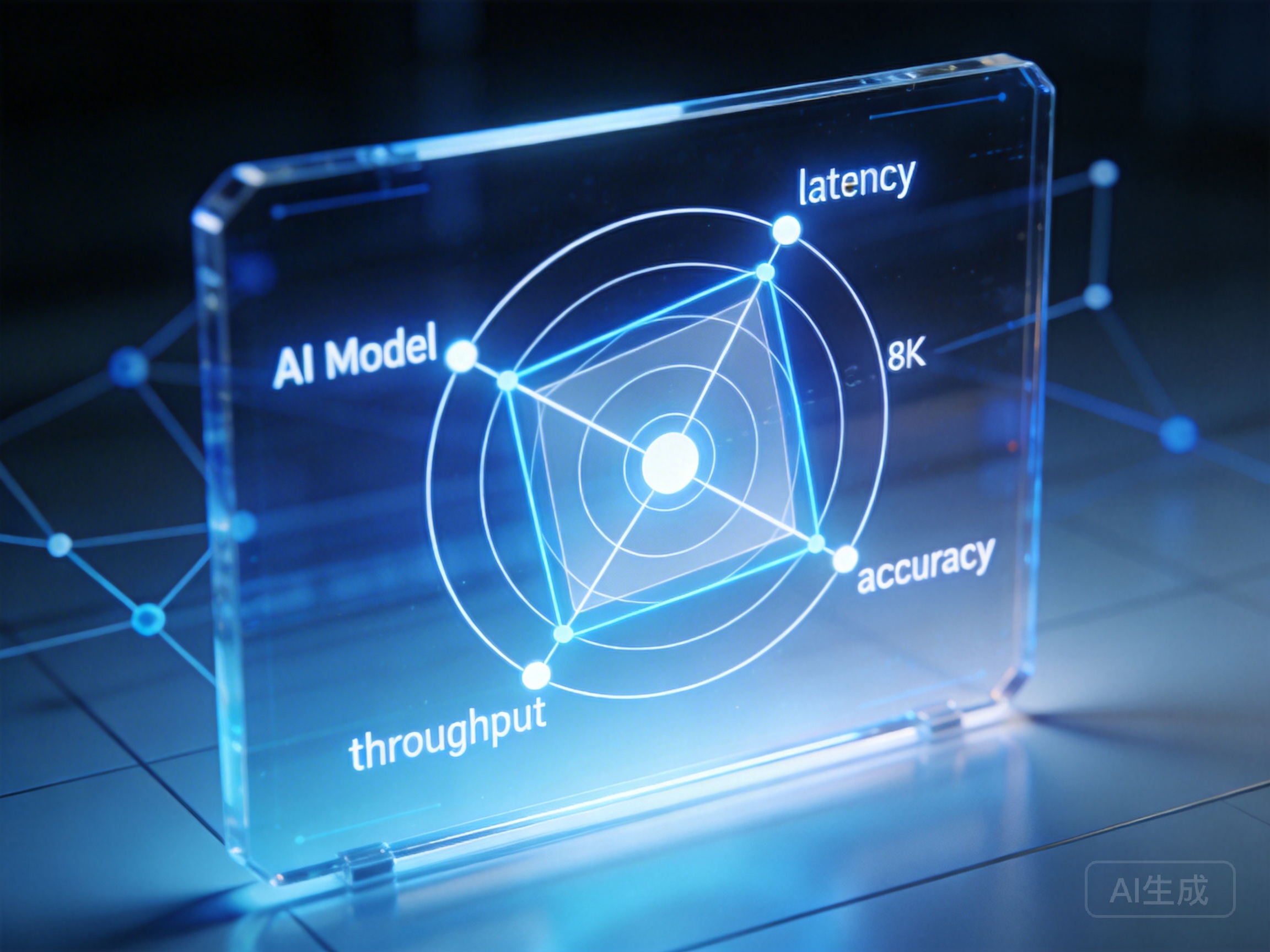

关于 GPT-5 的传闻已经充斥了整个技术圈,从参数规模的指数级增长到推理能力的质变,每一次泄露都牵动着开发者的神经。但对于身处一线的工程团队而言,关注点早已从单纯的“模型智力”转移到了更务实的维度:延迟、成本以及多模态在复杂业务流中的实际表现。

当大家还在争论 AGI 何时降临时,GPT-5.4 mini 这类高能效模型的悄然登场,实际上为企业级应用打开了一扇新的大门。它不再是一个只会聊天的玩具,而是能够嵌入到精密业务逻辑中的核心齿轮。本文将跳过那些虚无缥缈的参数猜测,直接拆解 GPT-5.4 架构下的工程红利,并手把手教你如何构建一套高可用的企业级接入方案。

GPT-5.4 mini:重新定义“小模型”的编码与推理边界

在过去,选择“Mini”或“Turbo”版本的模型往往意味着在智力上做出妥协。但在 GPT-5.4 mini 的架构设计中,这种妥协被极度压缩了。通过更激进的层级蒸馏(Layer Distillation)和稀疏注意力机制(Sparse Attention),新一代 Mini 模型在保持低显存占用的同时,保留了主模型 90% 以上的逻辑推理能力。

特别是在 GPT-5.4 mini编码能力对比 测试中,我们发现一个有趣的现象:在处理 Python 脚本生成、SQL 语句优化以及单元测试补全这类高频任务时,它的表现甚至优于早期的 GPT-4。这并非因为它“更聪明”,而是因为它对上下文窗口的利用效率更高。对于企业而言,这意味着你可以在不牺牲代码质量的前提下,将 CI/CD 流水线中的 AI 辅助成本降低 60% 以上。

这种架构演进直接催生了新的 GPT-5多模态应用场景。以往因为成本和延迟问题难以落地的实时视频流分析、大规模文档 OCR 结构化提取,现在都可以通过 GPT-5.4 mini 实现毫秒级响应。

拒绝单点依赖:构建高可用的 API 接入层

很多团队在进行 GPT-5 API接入教程 学习时,习惯直接硬编码 OpenAI 的原生接口。这种做法在 Demo 阶段尚可,一旦进入生产环境,就会面临网络抖动、账号风控和单一模型能力瓶颈的致命风险。

成熟的 企业级AI Agent开发方案 绝不会把鸡蛋放在同一个篮子里。架构师应当引入一层“模型网关”,将 GPT-5 与 Claude 3.5、Gemini 1.5 等模型进行混合编排。

这里推荐使用 七牛云AI推理 这样的全开放平台作为中间层。它最大的价值在于“接口标准化”——你只需要修改 Base URL,就能无缝切换后端模型,完全兼容 OpenAI 和 Anthropic 的双重标准。这种架构设计让你能够在 GPT-5 出现波动时,瞬间自动降级到其他模型,确保业务 0 中断。

接入过程远比想象中简单。开发者只需在控制台申请一个 七牛云API key,就能获得一个统管全局的鉴权凭证。这个 Key 不仅支持实时推理,还覆盖了图文生成和 OCR 等全栈能力,且新用户激活即送的额度足够支撑完成一整套 MVP(最小可行性产品)的压力测试。

从 Chat 到 Action:基于 MCP 的 Agent 落地

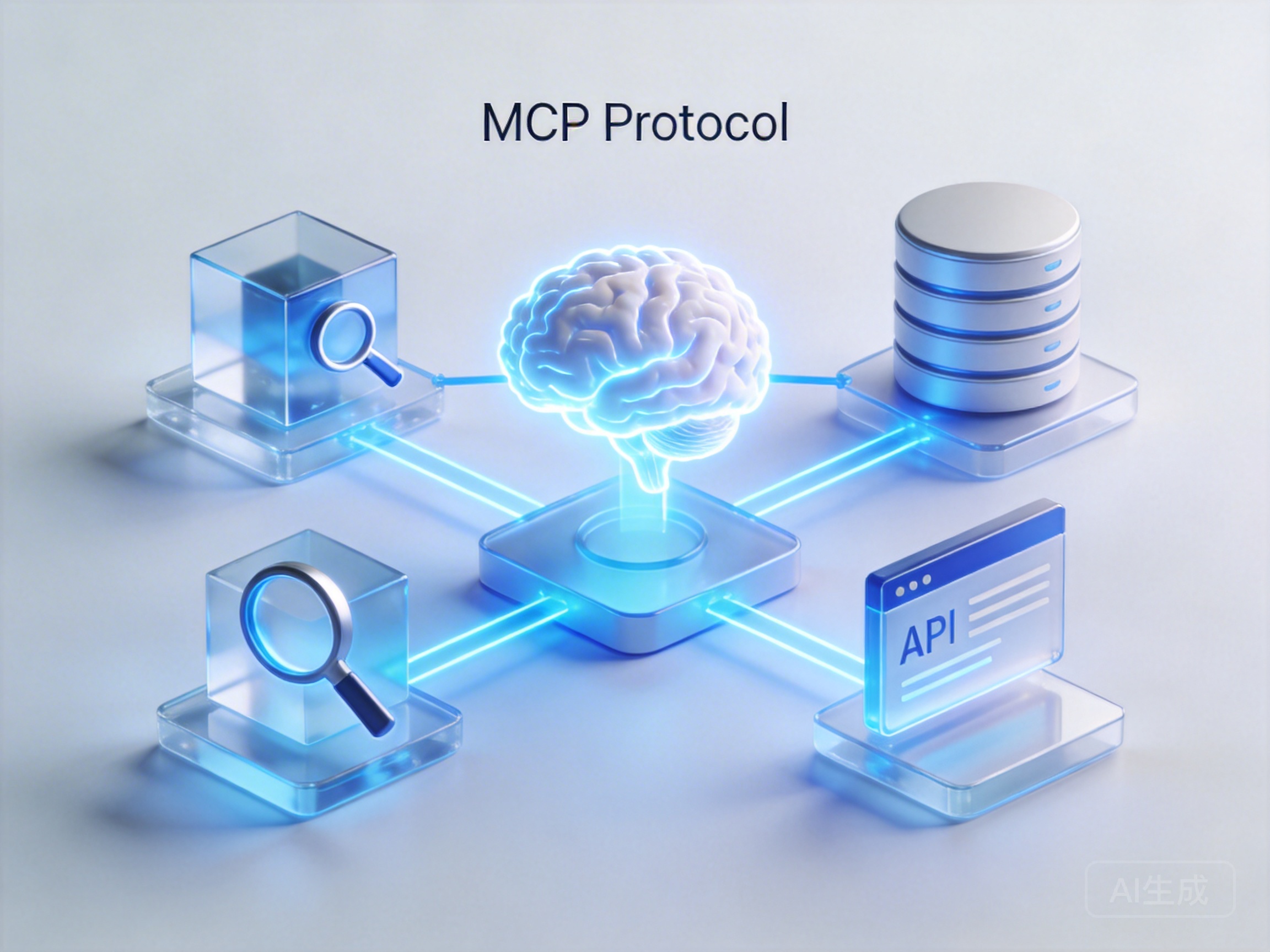

单纯的对话已经无法满足复杂的业务需求,真正的企业级 企业级AI代理 必须具备“手脚”。例如,一个财务 Agent 不仅要能读懂发票(多模态),还得能登录 ERP 系统录入数据(工具调用)。

传统开发模式下,我们需要手写大量的 Glue Code(胶水代码)来连接模型和外部工具,维护成本极高。而 GPT-5 时代,Model Context Protocol (MCP) 正在成为行业标准。

通过引入标准化的 MCP服务,开发者可以将数据库查询、网页搜索、甚至是私有 API 封装成标准的“工具块”。GPT-5 模型能够根据上下文自动判断何时调用哪个工具,而无需人工编写繁琐的 if-else 逻辑。七牛云的 MCP 托管服务支持 SSE 等多种协议,这意味着你无需在本地部署复杂的运行环境,就能让你的 Agent 拥有联网搜索和深度思考的能力。

结语

技术浪潮的更迭从未停止,等待完美的模型出现永远是徒劳的。GPT-5.4 mini 的出现,标志着 AI 应用开发从“尝鲜期”进入了“深水区”。真正的护城河不再是拿到了哪个模型的内测资格,而是你是否建立了一套兼容并包的 API 架构,以及是否利用 MCP 协议打通了业务数据的最后一公里。现在就开始行动,用最灵活的架构去迎接模型能力的下一次跃升。