GPT-5模型深度评测与API低延迟接入指南

在人工智能技术迭代的浪潮中,开发者们刚刚适应了 GPT-4o 的节奏,关于下一代模型的讨论便已甚嚣尘上。尽管官方尚未全面解禁,但技术圈对 GPT-5 的期待早已超越了单纯的参数堆叠,转向了更实际的落地指标:推理速度、上下文窗口的有效利用率以及编程逻辑的严密性。对于正在构建实时交互应用的工程师而言,如何在模型能力与响应延迟之间找到平衡点,是当下最棘手的挑战。

本文将跳过那些虚无缥缈的传闻,直接从技术评测与工程接入的角度,探讨下一代模型可能的形态,以及在当前环境下如何通过高效的 AI大模型推理 基础设施,提前布局未来的高性能 AI 应用。

性能迷雾下的真相:GPT-5.4 mini API 的潜力与定位

虽然目前市场上的主流目光仍聚焦在 GPT-4 系列,但从 OpenAI 的命名逻辑和技术演进路线来看,未来的 GPT-5.4 mini API 极有可能成为打破“高智商=高延迟”魔咒的关键角色。

在进行 GPT-5.4 mini API价格与性能评测 的预演时,我们发现一个有趣的趋势:模型厂商正在通过混合专家架构(MoE)的极致优化,试图让轻量级模型具备越级的逻辑能力。对于高频交易分析、实时语音助手等场景,单纯追求千亿参数的大模型往往是资源浪费。低延迟高频AI任务模型选择 的核心,不再是看谁的跑分更高,而是看谁能在 200ms 内返回准确的 JSON 结构。

这正是当前许多开发者转向第三方聚合平台的原因。例如,通过 七牛云AI推理 服务,开发者可以无缝切换 Claude 3.5 Sonnet、DeepSeek 等当前顶尖模型,这种兼容 OpenAI 和 Anthropic 双 API 的架构,实际上为未来接入 GPT-5 预留了从容的“接口试错空间”。当新模型发布时,你不需要重写底层代码,只需调整 API 调用参数即可。

硬核实战:OpenAI GPT-5 编程能力分析与私有化困局

如果说通用对话是“软实力”,那么代码生成就是检验大模型的“硬通货”。在对现有模型进行 OpenAI GPT-5性能评测 的推演中,业界普遍预期新一代模型将在复杂系统架构设计和长链路 Debugging 上实现质的飞跃。

目前的 GPT-4o 在处理单一函数或脚本时表现优异,但在面对跨文件依赖的微服务架构时,往往会丢失上下文。未来的 GPT-5 被寄予厚望,能像资深架构师一样理解整个 Git 仓库的拓扑结构。然而,这种强大的能力也带来了数据隐私的担忧。GPT-5模型私有化部署方案 可能会成为金融和医疗领域的刚需,但高昂的算力成本让大多数企业望而却步。

这就需要一个折中方案:利用安全合规的云端推理服务。AI 大模型广场 提供了一个绝佳的缓冲地带。它不仅汇聚了全球主流 AI 模型,还支持 AI 编程、图像生成等多种模态。对于不想投入巨资自建机房,又希望体验接近私有化部署安全性的团队,这种汇聚全球算力的平台是更具性价比的选择。你可以在这里测试不同模型在特定业务场景下的表现,找到那个“编程能力”与“成本”的最佳契合点。

极速接入:如何构建低延迟的大模型推理管道

无论 GPT-5模型部署 的最终形态如何,网络延迟永远是 API 调用中不可忽视的一环。很多时候,用户感觉“模型慢”,其实是网络握手和路由转发在拖后腿。

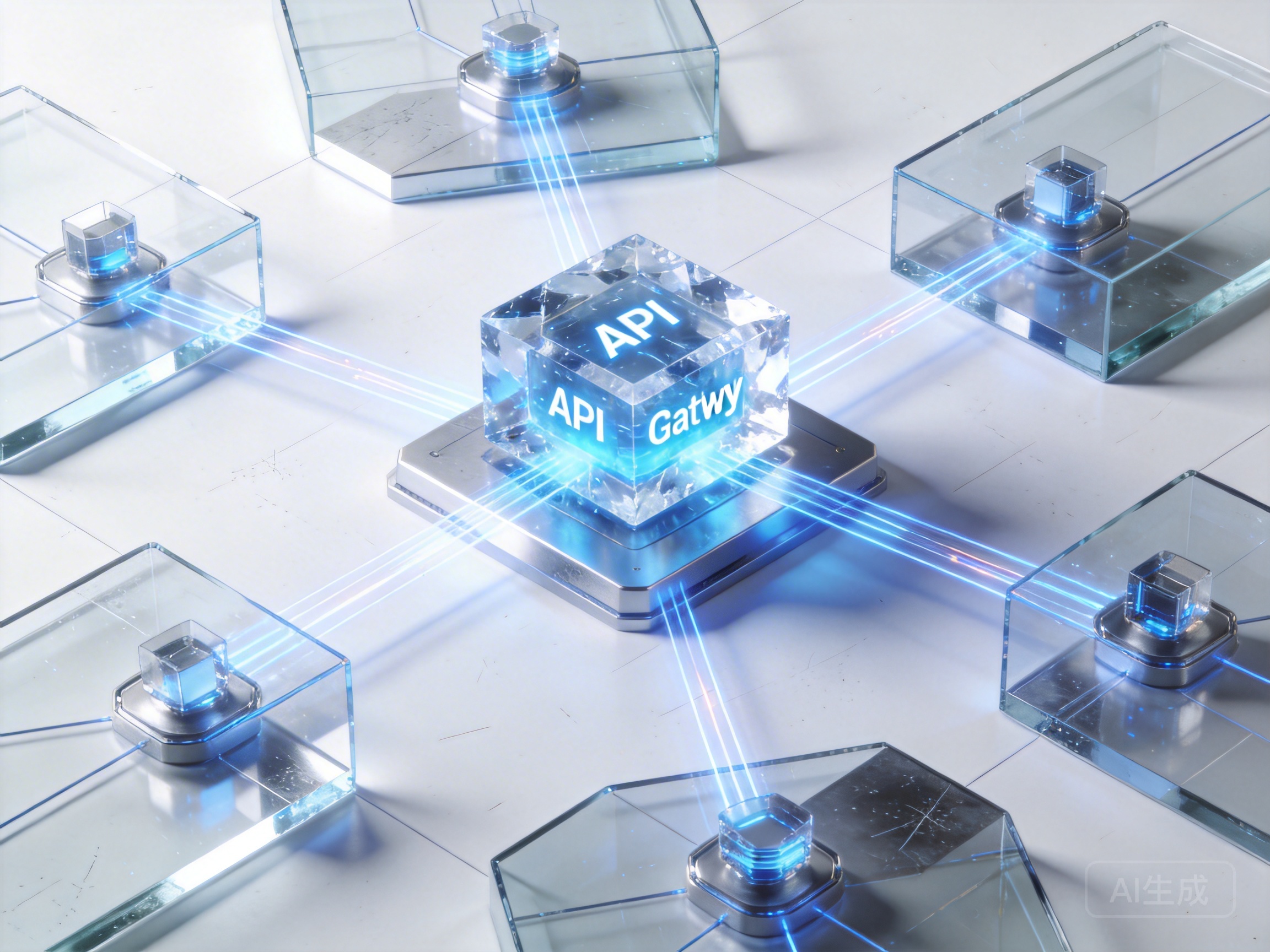

为了解决这一问题,构建一个统一且经过优化的 API 网关至关重要。直接连接海外源站往往面临不稳定的风险,而通过国内优化的节点进行请求转发,可以显著降低首字节时间(TTFB)。

对于急需验证产品的开发者,申请 七牛云 API Key 是一个高效的捷径。它不仅完美兼容 OpenAI 标准,还提供最高 600 万免费 Token 额度,这意味着你可以在不产生费用的情况下,完成从 Demo 到 MVP 的全流程测试。更重要的是,这种统一入口的设计,让你在面对未来 GPT-5 发布时,能够通过简单的配置更新,瞬间拥有最新的模型能力,而无需重新经历繁琐的商务对接和技术联调。

结语

与其在猜测 GPT-5 的具体发布日中消耗精力,不如现在就打磨好你的 AI 接入架构。未来的竞争,属于那些拥有灵活模型切换能力、且能将推理延迟压榨到极致的应用。通过成熟的聚合推理平台,建立起兼容未来的技术栈,当真正的 GPT-5 到来时,你将是第一批驾驭它的人。