AI云服务:大模型调用量与Token经济的算力平衡术

在生成式 AI 爆发的当下,企业面临着一道棘手的算术题:如何在指数级增长的大模型调用量与有限的预算之间找到平衡点。这不仅仅是技术选型的问题,更是一场关于Token经济与算力需求的博弈。当业务从 Demo 走向大规模落地,每一次 API 调用背后的算力消耗,都会精准地转化为账单上的数字。

对于大多数开发者而言,AI云服务不再只是简单的“租服务器”,而是演变成了一种精细化的资源调度艺术。如何在保证服务稳定性的同时,极致压缩企业级大模型推理算力成本优化的空间,成为了 CTO 们案头最紧迫的任务。

告别盲目调用:Token 计费背后的经济账

很多企业在初期接入大模型时,往往只关注模型的能力强弱,而忽视了大模型应用落地Token计费策略的隐形陷阱。Token 不仅仅是计费单位,它直接映射了模型的上下文窗口长度和推理复杂度。一个未经优化的 Prompt,可能会因为冗余信息导致 Token 消耗翻倍,进而让成本失控。

真正的成本优化,始于对 Token 流向的精准掌控。企业需要建立一套机制,能够实时监控不同业务场景下的 Token 消耗情况。例如,对于简单的客服问答,是否真的需要调用昂贵的 GPT-4?或者,通过模型蒸馏和量化技术,是否可以用更小的模型完成同样的任务?

这就涉及到如何降低大模型Token调用成本的核心策略:混合模型调度。与其死磕单一昂贵模型,不如构建一个智能路由层。在这个层面上,七牛云AI推理服务提供了一个极具竞争力的解决方案。它不仅集成了 Claude、Gemini、MiniMax、DeepSeek 等顶级模型,更重要的是,它允许开发者在一个平台上灵活切换,找到性能与成本的最佳平衡点。

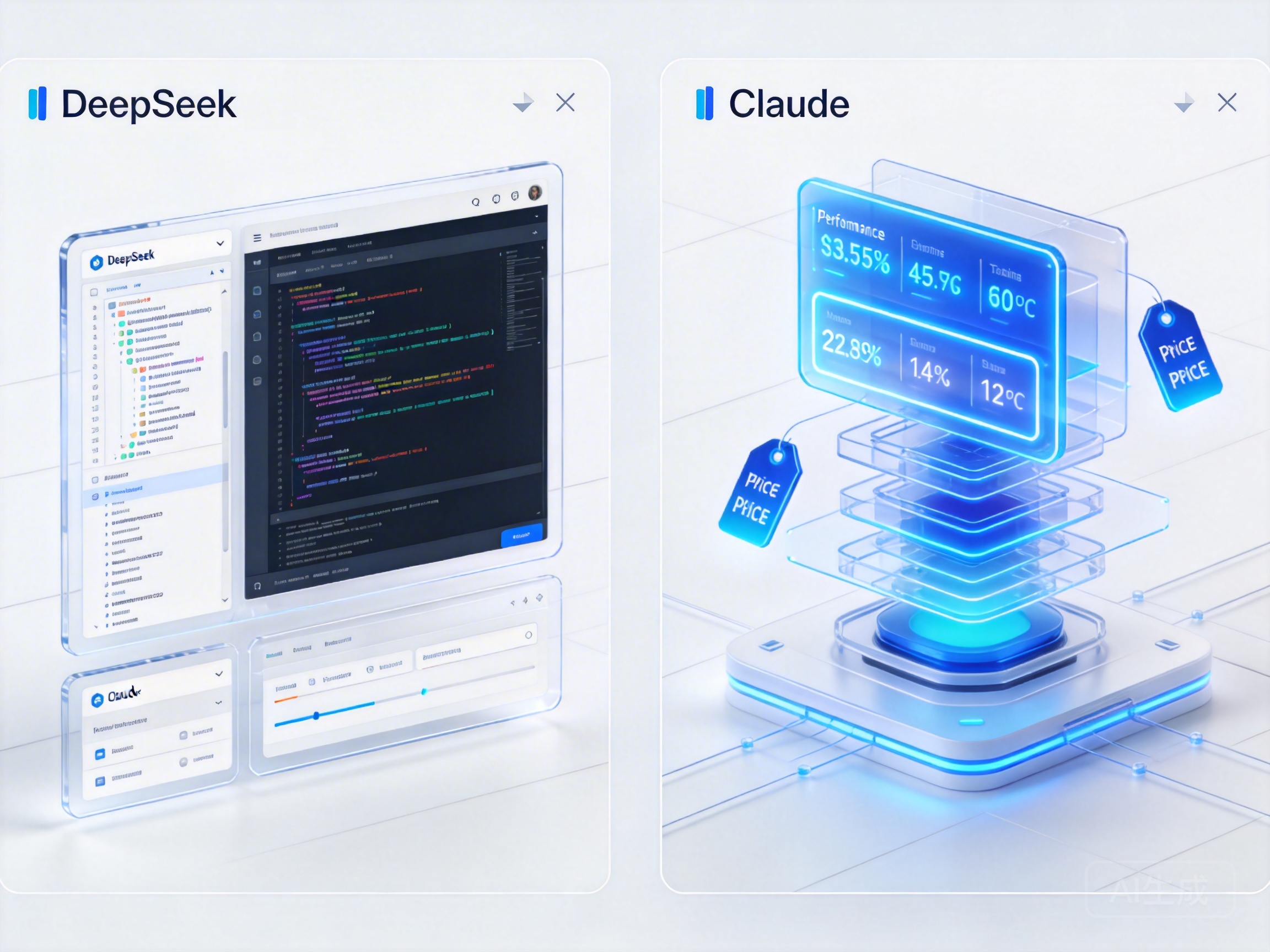

算力性价比之选:DeepSeek 与 Claude 的实战对决

在选择模型时,价格往往是决定性因素之一。近期市场上关于DeepSeek与Claude模型API调用价格对比的讨论热度居高不下。Claude 以其卓越的逻辑推理和长文本能力著称,但其 Token 单价相对较高;而 DeepSeek 则以极高的性价比在开源界和 API 市场异军突起,特别是在代码生成和中文理解上表现不俗。

企业如何选择高性价比AI算力服务?答案在于“场景适配”。

如果你的业务场景是复杂的法律文档分析或深度逻辑推演,Claude 可能是不可替代的;但如果是高频的日常对话或基础代码补全,DeepSeek 的成本优势将极其明显。为了帮助开发者直观地做出选择,利用AI模型性能与价格对比工具至关重要。这种工具支持多模型同屏竞技,你可以在同一界面下,用同样的 Prompt 测试不同模型的响应速度、输出质量以及预估成本,从而快速筛选出最适合当前业务的方案。

统一入口:化繁为简的运维哲学

随着业务复杂度的提升,企业往往需要同时接入多家模型厂商。OpenAI 的 API Key、Anthropic 的 API Key、国内各家大模型的 API Key……管理这些分散的密钥不仅繁琐,还容易造成安全隐患和账单混乱。

构建一个统一的 API 网关是解决这一痛点的最佳实践。通过统一API Key管理,企业可以屏蔽底层不同模型厂商的接口差异。开发者只需维护一套标准的接入端点,即可无缝调用全球主流大模型。这种方式不仅简化了开发流程,还支持一键切换后端模型,当某家服务不稳定或价格调整时,可以迅速迁移,确保业务连续性。更具吸引力的是,这种统一管理服务往往伴随着额外的福利,比如最高 600 万的免费 Token 额度,对于初创团队或新业务线的冷启动来说,这无疑是巨大的助力。

未来的 AI 竞争,不仅是算法的竞争,更是算力运营效率的竞争。精细化运作 Token 经济,灵活调度算力资源,将是企业在 AI 浪潮中站稳脚跟的关键。不要让算力成本成为创新的绊脚石,而是要让它成为推动业务增长的燃料。