Qwen 3.0 MoE 架构深度解析与实战:企业级低成本部署全攻略

企业在探索生成式AI的过程中,往往被庞大的算力开销和极高的推理延迟绊住脚步。传统的稠密模型在参数量激增时,单次请求的成本呈指数级上升。这正是当前技术团队急需解决的痛点。针对这一难题,Qwen 3.0 MoE 架构深度解析与实战成为了破局的关键。通过采用混合专家(Mixture of Experts)机制,该架构实现了参数规模与计算开销的解耦,让百亿级乃至千亿级参数模型的日常应用变得触手可及。

Qwen 3.0 混合专家架构性能测试与原理解构

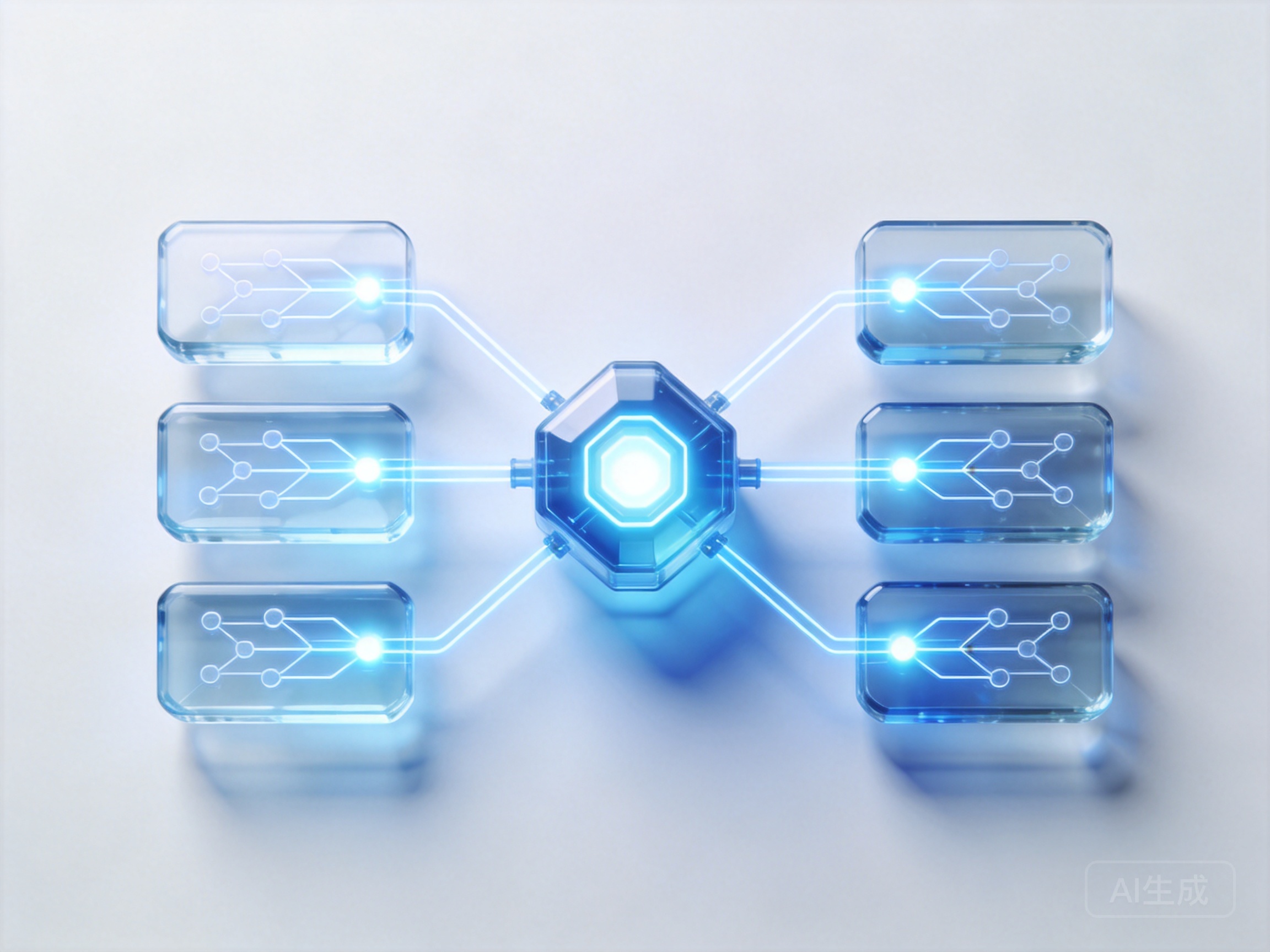

MoE架构的核心魅力在于“按需激活”。在处理输入标记时,门控网络(Gating Network)会动态选择最匹配的少数“专家”进行计算,而非激活全部参数。这种稀疏激活机制大幅降低了显存带宽的压力。

我们在近期的Qwen 3.0 混合专家架构性能测试中发现,相较于同等参数规模的稠密模型,其推理速度提升了近三倍,而吞吐量则翻了四倍。然而,如何进行Qwen 3.0 MoE架构性能优化依然是许多开发者面临的挑战。核心策略在于显存切分与负载均衡。通过调整专家并行的策略,避免某些热门专家节点过载,可以有效消除计算瓶颈。此外,量化技术的引入也能进一步压缩模型体积,使其在消费级显卡上也能流畅运行。

Qwen 3.0长文本处理实战教程与低成本方案

除了基础推理效率的提升,长上下文理解能力是评估现代大模型的另一项核心指标。在Qwen 3.0长文本处理实战教程中,我们通常采用动态NTK感知插值技术和注意力机制优化,使其能够轻松消化几十万字的财报或长篇代码库。

对于希望快速落地的团队,制定一套企业级大模型Qwen 3.0低成本部署方案至关重要。这不仅需要硬件层面的精打细算,更依赖于高效的云端基础设施。开发者可以通过七牛云AI推理平台,利用其兼容主流API的特性,快速完成从本地测试到云端生产环境的迁移。该平台不仅提供了极低的接入门槛,还能有效应对高并发场景下的长文本解析需求。

如果你还在评估不同模型的表现,可以前往AI大模型广场,对比各类主流模型的实际生成效果与响应速度,从而为你的业务场景挑选最合适的基座模型。

大模型企业级应用与API集成指南

完成Qwen 3.0 部署全攻略的最后一块拼图是业务系统的无缝集成。大模型企业级应用往往需要处理复杂的鉴权、并发控制以及多模态数据的输入输出。

开发团队在对接推理接口时,必须规范化Token消耗管理和错误重试机制。为了少走弯路,强烈建议开发者仔细研读AI大模型推理服务使用文档,其中详细记录了批量推理、工具调用(Function Calling)以及复杂Agent工作流的构建方法。通过合理的工程化封装,你可以将Qwen 3.0的强大推理能力直接嵌入到智能客服、代码辅助审查或自动化数据分析等核心业务链路中。

技术迭代的红利只有在真正落地时才会产生商业价值。掌握MoE架构的底层逻辑并结合成熟的云端推理基建,技术团队完全能够以极低的试错成本,将前沿的AI能力转化为切实的生产力。建议开发者先从非核心业务的内部工具起步,跑通整个数据飞轮后,再逐步向核心C端场景扩展。