Gemini 3.1 Flash Live语音Agent开发指南:从低延迟流式传输到企业级架构

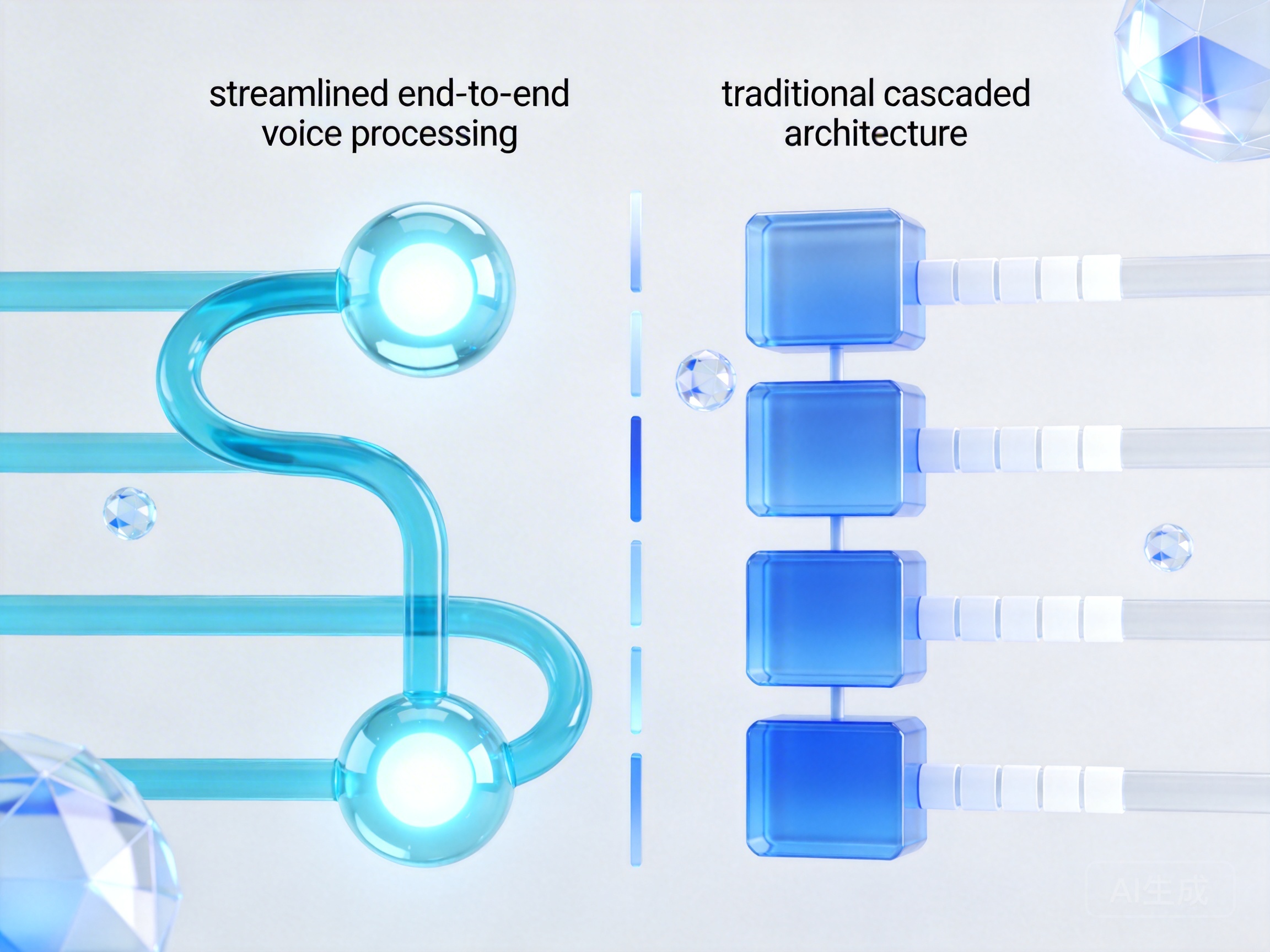

传统语音助手的交互往往伴随着令人尴尬的几秒钟停顿,这种由语音识别、文本理解、语音合成三个独立模块拼接而成的级联架构,已经无法满足当今用户对自然对话的期待。为了打破这种延迟瓶颈,端到端多模态模型应运而生。Gemini 3.1 Flash Live 作为新一代基础设施,直接跳过了繁琐的中间转换步骤,让机器真正具备了“听懂并立即回答”的能力。本文将深入探讨这款前沿模型的底层机制与实战应用。

告别级联延迟:Gemini 3.1 Flash Live 实时语音交互模型解析

构建自然对话体验的核心在于对音频流的精准把控。传统的开发模式需要开发者手动管理音频缓冲、断句检测以及多线程并发,而 Gemini 3.1 Flash Live 彻底重构了这一流程。它原生支持直接接收和生成音频数据,这意味着模型能够感知到用户的语调、情绪甚至是呼吸停顿。

在设计 Gemini Live API 低延迟音频流式传输方案时,开发者通常需要建立持久化的 WebSocket 双向连接。客户端将麦克风采集到的 PCM 音频帧以极小的时间片(如 20ms)持续推送到云端,模型在接收到足够上下文后,会立即开始流式返回生成的音频片段。这种边听边想边说的机制,将端到端延迟压缩到了几百毫秒级别,达到了人类自然对话的标准。

从零接入:如何基于Gemini 3.1 Flash Live构建实时语音助手

对于准备动手实践的团队来说,掌握一份详尽的 Gemini Live API 开发者接入指南是避坑的关键。开发的第一步是环境与鉴权配置。由于语音流传输对网络稳定性要求极高,建议在服务端进行鉴权与代理,而不是直接在客户端暴露密钥。

在实际对接中,如何高效管理模型调用与 Token 消耗是开发者必须面对的课题。如果您正在寻找稳定且兼容性强的接口服务,可以体验 七牛云 AI 推理服务,该平台不仅完美兼容主流 API 标准,还支持联网搜索与 MCP Agent 开发,极大降低了多模态大模型的接入测试门槛。当进入到具体的代码编写阶段,复杂的参数配置和错误重试机制往往让人头疼,此时参考详尽的 AI大模型推理服务接入指南,能够帮助您快速打通从密钥获取到音频流双向通信的全流程。

迈向生产环境:企业级语音驱动智能代理架构设计

当一个简单的 Demo 需要转化为支撑百万用户的商业产品时,架构设计的复杂度会呈指数级上升。在 Gemini 3.1 Flash Live 多模态智能体Agent开发教程的进阶部分,核心焦点往往集中在上下文管理与多模态融合上。

企业级应用通常不仅需要语音交互,还需要结合视觉输入或调用外部工具(如查询天气、控制智能家居)。这就要求 语音驱动智能代理 Agent 构建 时,必须具备强大的任务编排能力。例如,当用户在一边展示摄像头画面一边提问时,Agent 需要同时处理视频帧和音频流,并在极短时间内通过函数调用(Function Calling)获取外部数据,最后将结果转化为语音播报。

为了支撑如此复杂的业务逻辑,特别是在智能硬件、陪伴机器人等对延迟和稳定性极其苛刻的场景中,底层基础设施的选型至关重要。依托超低延迟全球节点的 灵矽 AI 智能语音引擎 为这类硬件厂商提供了绝佳的解决方案,它不仅集成了强大的音频处理能力,还无缝对接了多模型 MCP 生态,让硬件设备能够轻松获得全栈式的智能语音驱动力。

开发高可用语音 Agent 并非一蹴而就。团队需要持续关注音频降噪算法的优化、网络抖动的补偿机制以及模型在复杂环境下的抗干扰能力。通过合理利用端到端模型的原生优势,结合稳健的云端基础设施,开发者完全有能力打造出媲美真人交流体验的下一代智能语音应用。