破局高可用:大模型服务SLA保障与多模型无缝切换架构实践

当业务核心链路深度依赖大模型时,单一模型提供商的API限流、偶发宕机或延迟突增,往往会演变成毁灭性的线上事故。构建稳定的大模型服务,已经从加分项变成了必修课。要真正落实大模型推理服务SLA保障,单纯依赖服务商的承诺并不现实,开发者必须在架构侧引入多模型切换机制,通过冗余设计与智能路由来兜底业务稳定性。

构建企业级大模型服务SLA保障方案

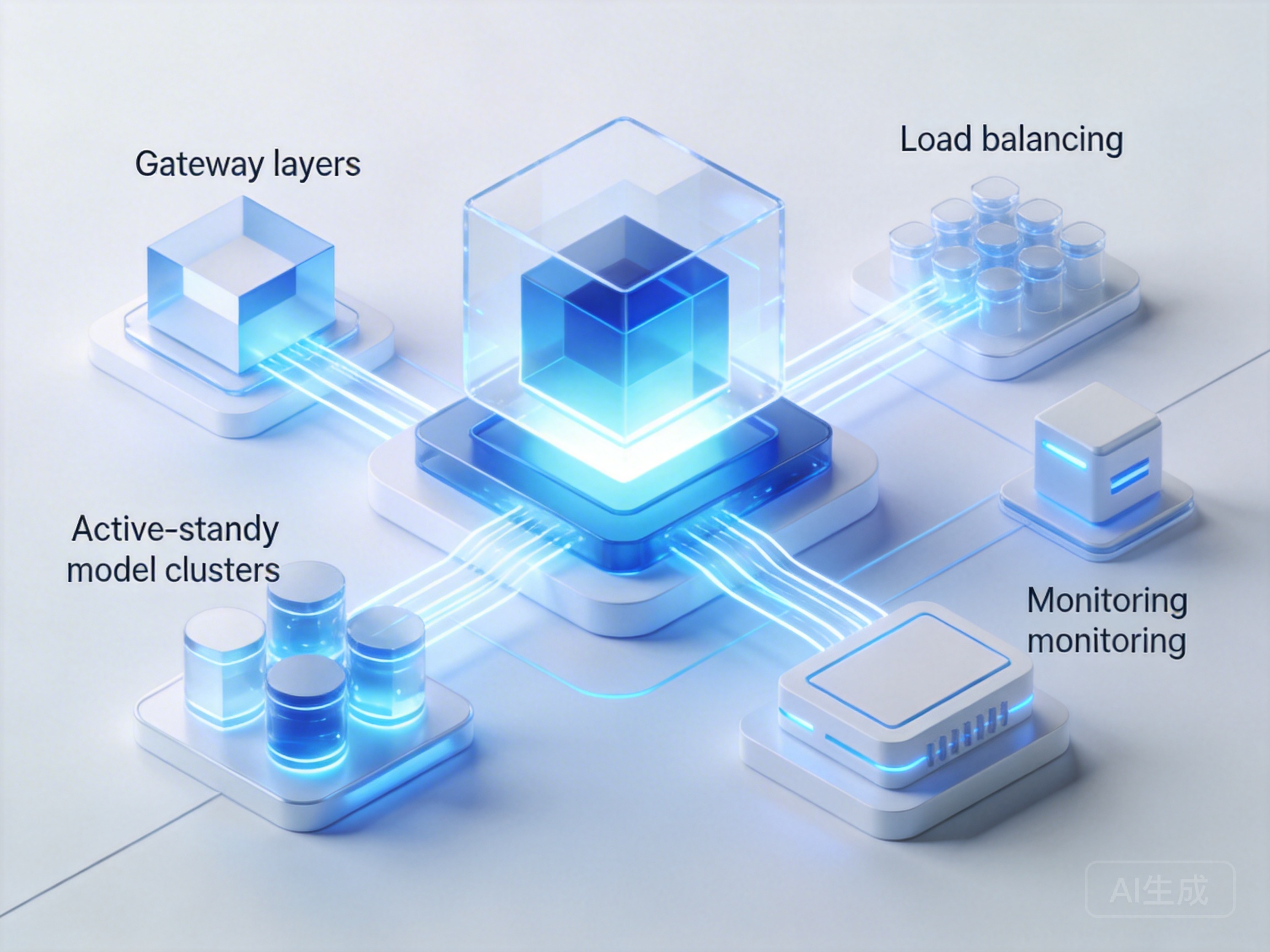

高并发大模型推理容灾架构设计的核心在于防患于未然。在网关层,我们需要建立多级重试与降级策略。当主干模型响应超时或返回错误码时,系统应能在毫秒级判断是否触发熔断,并自动将请求引流至备用链路。

这种容灾架构要求对流量进行精细化管理。通过引入令牌桶算法限制单节点并发上限,结合实时健康度检查剔除异常节点,可以有效防止雪崩效应。监控指标不仅要覆盖HTTP状态码,还需深入到首字延迟和生成速率,一旦指标低于设定的SLA保障基线,立即触发应急预案。

破局痛点:如何实现多AI模型无缝切换

多AI模型无缝切换方案的落地难点在于各家大模型API接口规范的碎片化。不同厂商的鉴权方式、参数结构甚至上下文传递逻辑都不尽相同。解决这一问题的最佳实践是引入统一的大模型网关,将底层差异完全抹平。

通过协议转换层,业务端只需对接一套标准的API,网关即可在后端动态将其映射到不同厂商的模型上。对于需要快速接入并验证业务逻辑的团队,直接采用聚合型平台是更高效的选择。例如七牛云AI推理就提供了全开放的平台架构,完美兼容主流双API标准,不仅免去了繁琐的协议适配工作,还自带高可用保障,让开发者专注于核心业务逻辑的迭代。

动态路由与多模型同屏验证

实现了接口统一后,下一步是建立基于业务感知的智能路由规则。这需要基于业务场景对不同模型的能力边界有清晰的认知。对于复杂代码生成任务,可以优先路由至参数量更大的旗舰模型;对于日常的文本润色或简单问答,则可降级至响应更快、成本更低的小参数模型。

为了制定科学的路由策略,上线前的基准测试必不可少。开发者可以利用模型对比工具,在同一测试集下直观观测各模型在准确率、响应延迟及Token消耗上的真实表现。这种同屏竞技的方式,能够为动态路由权重的分配提供坚实的数据支撑,确保每次多模型切换都在性能与成本之间取得最优解。

打造坚若磐石的大模型底座,本质上是在不确定性中寻找确定性。通过构建标准化的统一网关,结合多维度的监控告警与智能路由策略,业务团队完全可以跨越单一厂商的物理限制。尽早将多模型冗余机制纳入架构蓝图,才是保障AI应用长治久安的关键路径。