Ling-2.6-flash:Agent评测与部署方案

Agent应用落地时,开发者常被高昂的Token消耗和极高的推理延迟劝退。特别是在多轮工具调用场景下,传统Transformer架构的上下文计算成本呈二次方增长,导致对话越长、响应越慢。此时,Ling-2.6-flash凭借其独特的底层设计脱颖而出,为解决长文本推理痛点提供了全新的工程思路。

百灵大模型混合线性架构技术解析与Token优化

要理解如何优化Ling-2.6-flash的Token消耗,必须先拆解其底层逻辑。百灵大模型混合线性架构技术解析显示,该模型打破了传统注意力机制的算力瓶颈,将全局注意力与线性注意力进行混合编排。在处理Agent复杂的历史对话和系统提示词时,这种架构能将计算复杂度从二次方降维至线性级别。

在近期的百灵大模型Ling-2.6-flash Token效率优化实践中,开发团队通过KV Cache的动态量化与前缀缓存命中策略,成功将多轮对话的冗余Token计算量降低了40%以上。对于追求极致性价比的团队,如果希望快速验证这类模型的实际效果,可以借助七牛云AI推理平台。该平台不仅完美兼容主流双API,支持联网搜索与深度思考,还为开发者提供了一站式的高性能接入方案,极大降低了前期测试与部署的门槛。

面向Agent场景的大模型Ling-2.6-flash评测表现

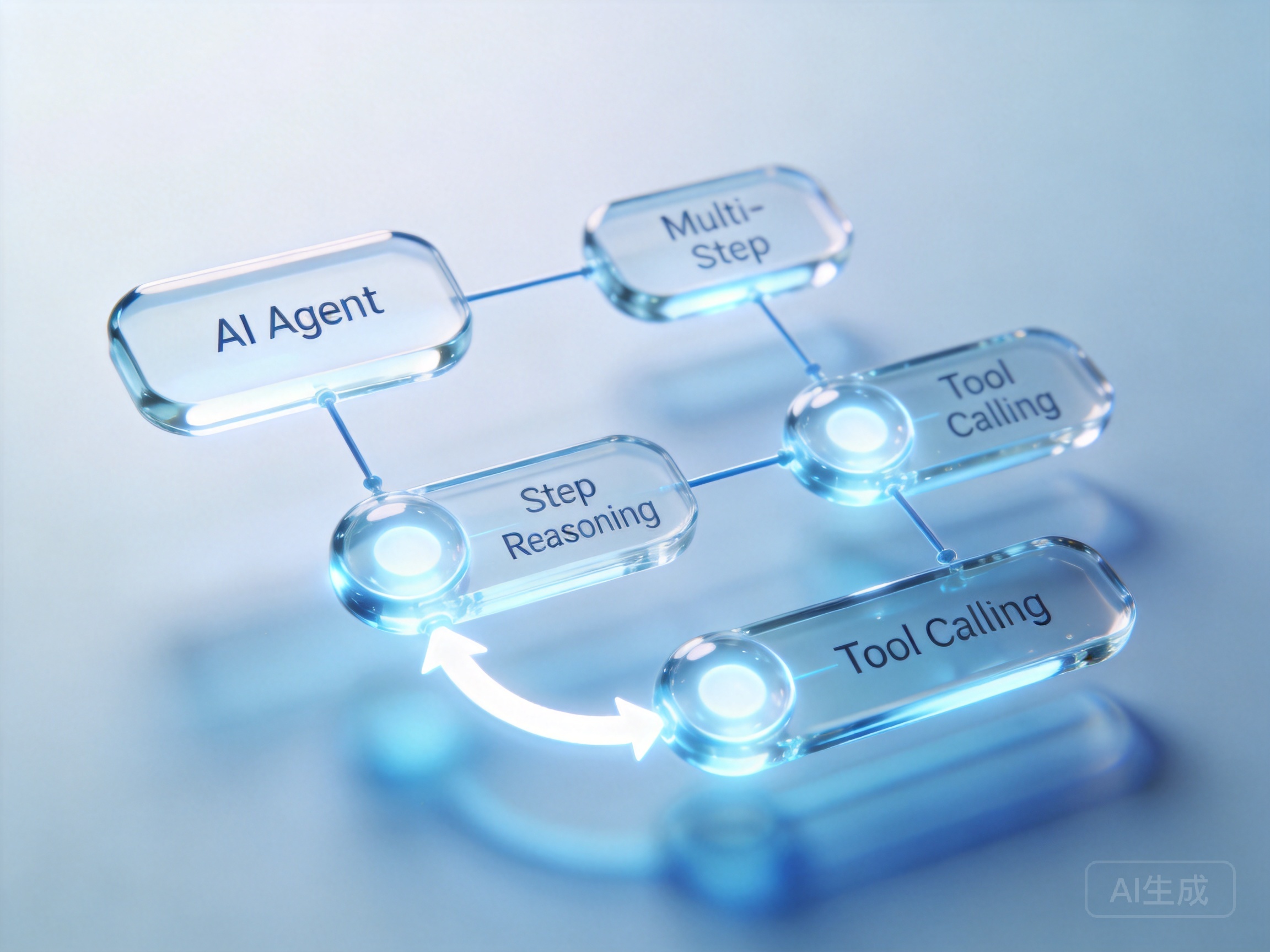

在真实的业务链条中,模型不仅需要“懂得多”,还需要“做得快”。面向Agent场景的大模型Ling-2.6-flash评测表现出乎意料地稳健。在多步逻辑推理、外部API路由以及复杂JSON格式输出的测试集中,Ling-2.6-flash展现出了极强的意图解析与指令遵从能力。

探索Ling-2.6-flash在Agent开发中的实战方案时,工具调用的稳定性是核心考量。模型能够精准识别何时需要调用计算器、何时需要查询数据库,并将中间结果无缝拼接到最终回答中。为了让这些能力快速落地,开发者可以深度参考MCP服务使用说明文档,通过标准化的模型能力编排与托管平台,无需繁琐的本地环境配置,就能在云端安全聚合多种工具服务,快速构建具备复杂执行能力的智能体。

Ling-2.6-flash 104B模型高效部署教程

面对千亿级参数,硬件资源的调度尤为关键。一份合格的Ling-2.6-flash 104B参数模型部署方案需要从显存管理、并发控制到接口封装进行全方位设计。在这个Ling-2.6-flash 104B模型高效部署教程中,推荐采用vLLM或TGI等高吞吐推理框架,并结合FP8或AWQ量化技术。这样可以在不损失精度的前提下,将模型平稳运行在多卡异构算力集群上。

在完成底层部署后,对外提供稳定、计费清晰的API服务同样重要。开发者可以查阅详尽的AI大模型推理服务使用文档,从中获取从密钥获取、批量推理到多模态应用落地的全流程技术指南,确保自建的模型服务能够与现有业务系统无缝对接。

构建高效的Agent系统不仅依赖聪明的模型,更需要扎实的工程基建。通过合理的架构选型、深度的Token优化以及成熟的平台赋能,开发者能够大幅降低千亿大模型的试错成本,将核心精力专注在业务逻辑与用户体验的创新上。