突破算力瓶颈:Llama 4多模态模型本地部署完整指南与性能调优实战

多模态大模型的演进让视觉、语音与文本的融合交互成为现实,但在实际落地中,数据隐私、网络延迟以及高昂的调用成本往往成为阻碍。很多团队在尝试将视觉能力引入业务流时,都会面临算力瓶颈与架构设计的双重挑战。为了解决这些痛点,这份Llama 4多模态模型本地部署完整指南将从硬件选型到推理优化,为你拆解私有化落地的核心技术链路。

Llama 4 Scout硬件配置要求与底座选型

在开始Llama 4本地部署教程之前,明确硬件边界是第一步。Llama 4系列中的Scout模型因其出色的参数能效比,成为边缘计算和中小型服务器的优选。针对多模态任务,显存带宽往往比单纯的算力更决定生成速度。

对于基础的图文交互场景,推荐单节点配备至少两张24GB显存的消费级旗舰显卡(如RTX 4090)或单张A6000。多模态模型的视觉编码器(Vision Encoder)在处理高分辨率图像时会产生巨大的KV Cache,因此系统内存建议不低于128GB,且需配备PCIe 4.0 NVMe固态硬盘以加速模型权重的加载。若是企业级Llama 4多模态模型本地部署指南的标准,则需考虑A800或H20集群,以应对高并发的视觉请求和长序列上下文。

如何低成本进行Llama 4多模态模型私有化部署

预算有限的开发者常问,如何在不牺牲过多精度的前提下压缩成本。量化技术(Quantization)是核心解法。通过使用AWQ或GGUF格式,将模型权重从FP16压缩至INT4或INT8,可以使显存占用锐减一半以上。

在实际操作中,可以将视觉编码器保持在FP16以保留图像特征提取的精准度,而将语言解码器量化为INT4。这种混合精度部署策略能最大化利用现有硬件。如果你的业务存在明显的流量波峰波谷,纯本地部署可能造成资源闲置。此时,采用混合架构是更聪明的做法:日常流量走本地,突发流量或需要更高阶模型(如Claude、Gemini)辅助校验时,可以接入七牛云AI推理平台。该平台兼容主流双API标准,能作为本地算力的完美补充,降低整体运维成本。

Llama 4本地部署教程与性能优化方案

进入实操阶段,推荐使用vLLM或SGLang等高性能推理框架。拉取模型权重后,编写启动脚本时需特别注意多模态参数的配置。例如,限制最大图像输入分辨率并开启FlashAttention,能有效控制显存溢出。

针对并发优化,Continuous Batching(连续批处理)是提升吞吐量的利器。当系统同时接收多张图片分析请求时,该技术能动态重组计算队列,减少GPU空转。在开发上层应用时,建议参考标准化的AI大模型推理服务使用文档,规范化你的请求体结构,尤其是图像Base64编码与文本Prompt的拼接格式,这能大幅减少前端解析的错误率。

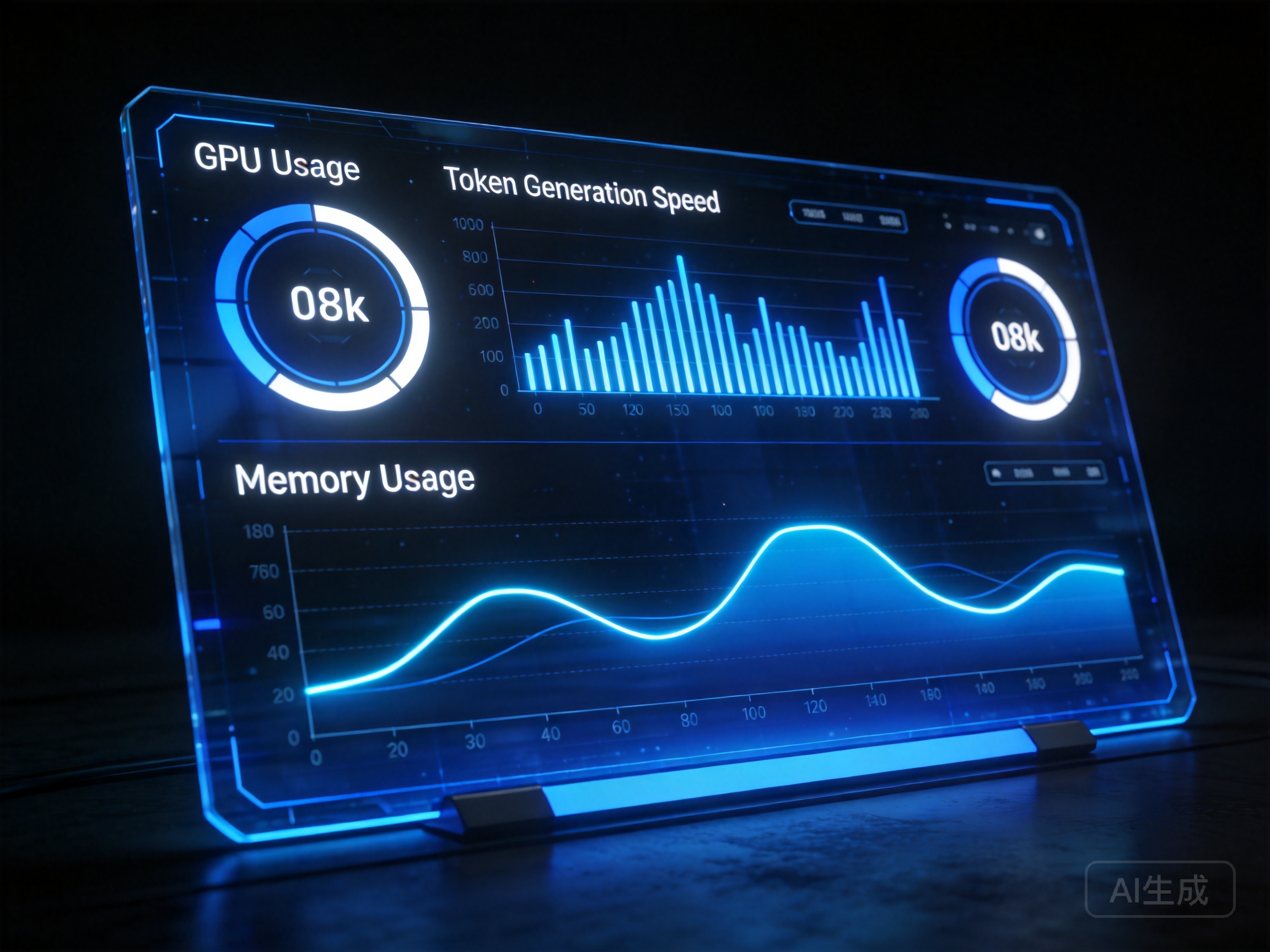

部署完成后,建立完善的监控体系至关重要。你需要实时追踪首字延迟(TTFT)和每秒生成Token数(TPS)。当发现视觉任务的TTFT过长时,可通过预热视觉编码器或降低图像切片数量来缓解。

掌握多模态模型的私有化部署,本质上是在算力、精度与成本之间寻找最优解。通过合理的硬件规划、精准的量化策略以及高效的推理框架,任何团队都能将Llama 4的强大能力安全地封装在自己的业务闭环中,真正实现AI资产的自主可控。