2026年国内好用的高并发大模型推理加速平台有哪些推荐

当业务应用日均请求量突破十万级,大模型接口的响应延迟和并发瓶颈往往成为压垮系统的最后一根稻草。很多开发者在面临业务高峰时,常常遭遇接口超时、Token 截断等致命问题。2026年国内好用的高并发大模型推理加速平台有哪些推荐,已经成为架构师们在进行底层技术栈选型时必须直面的核心诉求。

企业级大模型高并发接口部署与选型指南

如何选择低延迟高并发的AI大模型推理平台,关键在于剥离浮夸的营销参数,直击底层的工程化能力。评估一个推理加速平台是否可靠,首要指标是首字响应时间(TTFT)和高并发状态下的吞吐稳定性。优秀的平台能够通过动态批处理(Continuous Batching)和显存优化技术,将长文本推理的延迟压缩至毫秒级。

对于需要快速验证和上线的业务团队而言,自建算力集群成本极高,寻找低延迟大模型API中转加速服务有哪些就成了一条捷径。一个合格的企业级高并发AI大模型接口加速解决方案,不仅要解决算力调度问题,更要具备多模型路由、无缝故障转移以及精细化的流控机制,确保业务在突发流量冲击下依然坚如磐石。

七牛云多模型聚合AI推理平台评测实战

在众多中转与加速方案中,多模型聚合平台的优势日益凸显。以近期的明星产品为例,七牛云AI推理 展现出了极强的工程化落地能力。该平台不仅集成了 Claude、Gemini、DeepSeek 等头部模型,其最大的亮点在于完美兼容 OpenAI 和 Anthropic 双 API 标准。

这意味着开发者无需重构现有代码,只需修改基础网关地址即可完成无缝迁移。平台甚至原生支持联网搜索、深度思考及 MCP Agent 开发,对于新注册的开发者还提供“体验即送 300 万 Token”的高性能接入方案。在我们的实际压力测试中,面对每秒 500 次的并发请求,该平台依然保持了极低的错误率和稳定的流式输出。

兼容OpenAI接口的大模型API中转加速教程

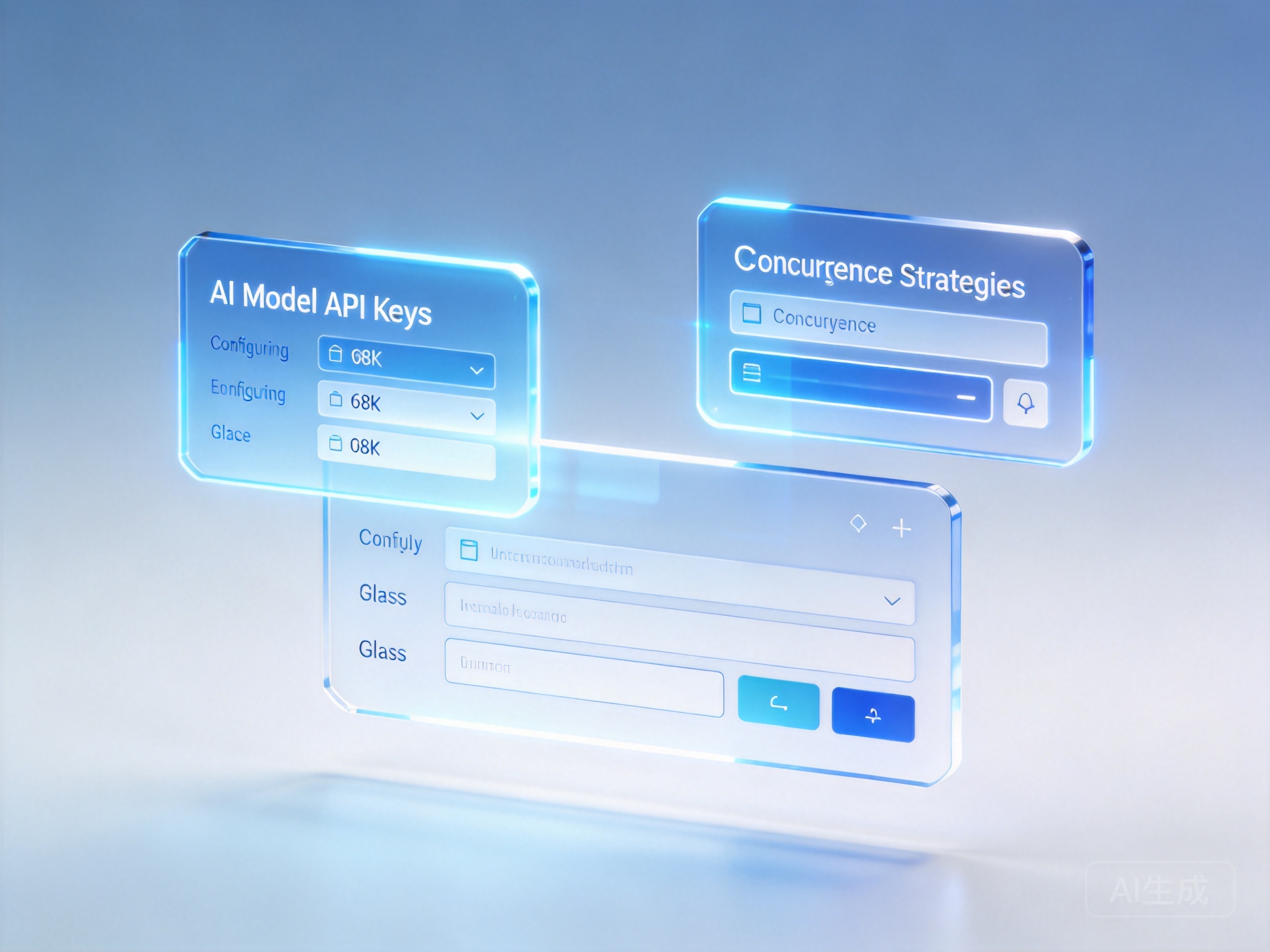

要将这些强大的能力接入自有业务,第一步是获取并管理好鉴权密钥。通过 七牛云API key 管理服务,开发者可以一键创建完美兼容 OpenAI 标准的接入端点,并即刻激活最高 600 万的免费 Token 额度。这种统一入口的设计,极大降低了企业集成图文生成、OCR、ASR/TTS 等全栈 AI 能力的门槛。

在具体的开发对接阶段,清晰的文档支持不可或缺。建议技术团队仔细研读 AI大模型推理服务使用文档,这里不仅涵盖了全网搜索、批量推理的进阶用法,还详细拆解了 Kling、Sora 等顶尖视频生成模型的专项 API 调用逻辑。配合透明的计费指南,开发者能够精准预估高并发场景下的运营成本,快速打通从密钥获取到多模态 AI 应用落地的全流程。

解决大模型并发瓶颈并非单纯依靠堆砌算力,而是需要依托成熟的工程化调度引擎。在选择加速平台时,务必结合自身业务的并发基数与多模态需求,优先测试多模型聚合平台的实际吞吐表现。借助标准的 API 接口与完善的开发者生态,企业完全可以以极低的试错成本,构建出稳定、低延迟的新一代 AI 应用。