RAG知识库大模型API成本与效果指南:企业级低成本部署实战

当企业决定为内部业务或客户服务搭建专属知识库时,往往会面临一个非常现实的痛点:测试阶段表现惊艳的系统,一旦上线面对海量并发请求,API账单便会直线飙升。这让无数技术负责人开始到处打听,企业做RAG知识库用哪个大模型的API调用成本最低且效果好?其实,单纯寻找一个“绝对便宜”的单点模型并不能解决根本问题。真正的降本增效,需要从模型选型、架构设计到工程实践进行全链路的重新审视。

支持长上下文的低成本大模型API对比

在RAG(检索增强生成)场景中,模型需要吞吐大量的召回文档,这对上下文窗口的要求极高。过去,长上下文往往意味着高昂的计费阶梯。如今,国产大模型在这一领域已经打下了一片天地。例如DeepSeek、MiniMax等模型,不仅支持超长上下文,其API定价甚至不到海外主流模型的十分之一。

对于企业而言,盲目跟风选择并不可取。不同业务场景对逻辑推理和信息提取的侧重点完全不同。为了精准评估,开发者可以借助模型对比服务,将企业的真实脱敏数据输入进去,让多个国内外顶级模型同屏竞技。通过直观的响应速度、归纳准确率和Token消耗比对,快速筛选出最契合自身业务的支持长上下文的低成本大模型API对比方案。

多模型RAG架构在企业知识库的实战教程

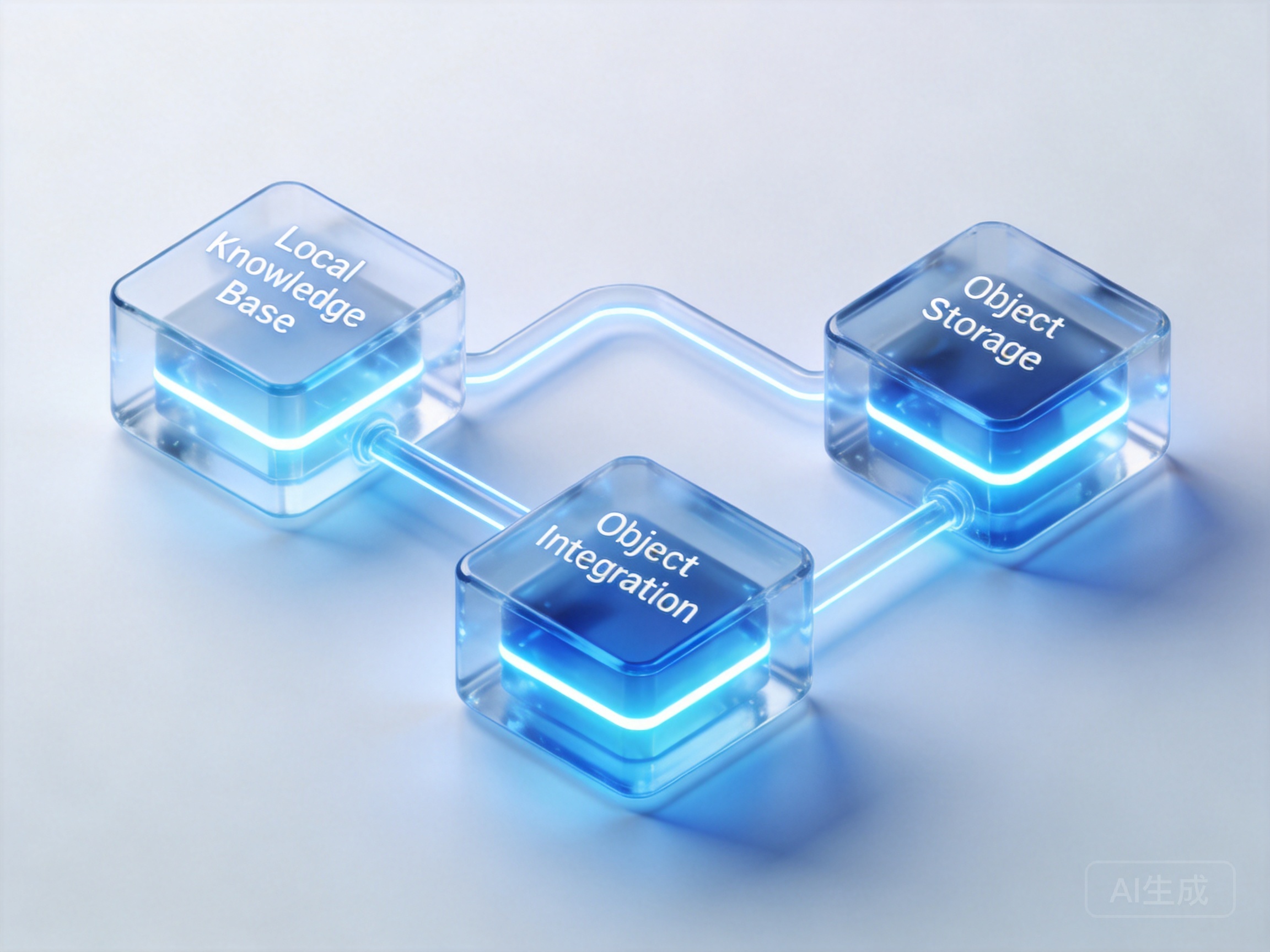

确定了候选模型后,如何构建企业级RAG系统低成本部署方案?答案是放弃“一招鲜吃遍天”的单模型策略,转向智能路由的多模型架构。

在日常的企业知识问答中,超过70%的请求是诸如“请假流程是什么”、“报销单怎么填”这类简单的事实抽取。对于这类请求,完全可以调用响应极快、成本极低的轻量级模型;而对于“对比近三年Q3财报分析利润下滑原因”这类复杂的推理任务,再动态路由给算力更强的大参数模型。

实施这种大模型API调用成本优化策略时,统一的密钥管理至关重要。建议通过配置七牛云API key,一键接入兼容OpenAI标准的多个模型端点。这样不仅能统一管理高达600万的免费Token额度,还能在不修改底层代码的情况下,实现多模型间的无缝切换与流量调度,大幅降低试错成本。

本地知识库接入大模型API避坑指南

许多团队在初期搭建阶段,容易忽略工程链路上的隐形成本。如何降低RAG知识库大模型API调用费用?核心在于减少不必要的无效调用。

第一步是做好语义缓存。如果多个用户询问相似的高频问题,系统应该直接从缓存层返回结果,而不是每次都走一遍完整的检索和生成流程。第二步是优化文档切片与召回策略,避免把冗长且无关的背景信息塞入Prompt中,白白消耗Token。

在具体的工程落地中,借助成熟的编排工具能少走很多弯路。例如在部署时,可以直接集成七牛云 Dify 插件。该插件仓库不仅提供了无缝接入各大主流模型的AI推理能力,还自带完善的对象存储管理工具。这意味着你可以把海量的PDF、Word等非结构化文档高效低价地存储在云端,同时利用插件打通大语言模型的处理链路,彻底解决本地存储扩容难、调用链路不稳定的痛点。

构建高性价比的RAG知识库并不是一门玄学,而是一场精密的算账游戏。从精准的模型对比选型,到多模型智能路由架构,再到借助成熟插件优化工程链路,每一步的精细化运营,都能为企业省下真金白银的API开销,让AI真正成为降本增效的利器。