企业级大模型API中转站降本增效方案实战:高性价比多模型聚合API平台选型指南

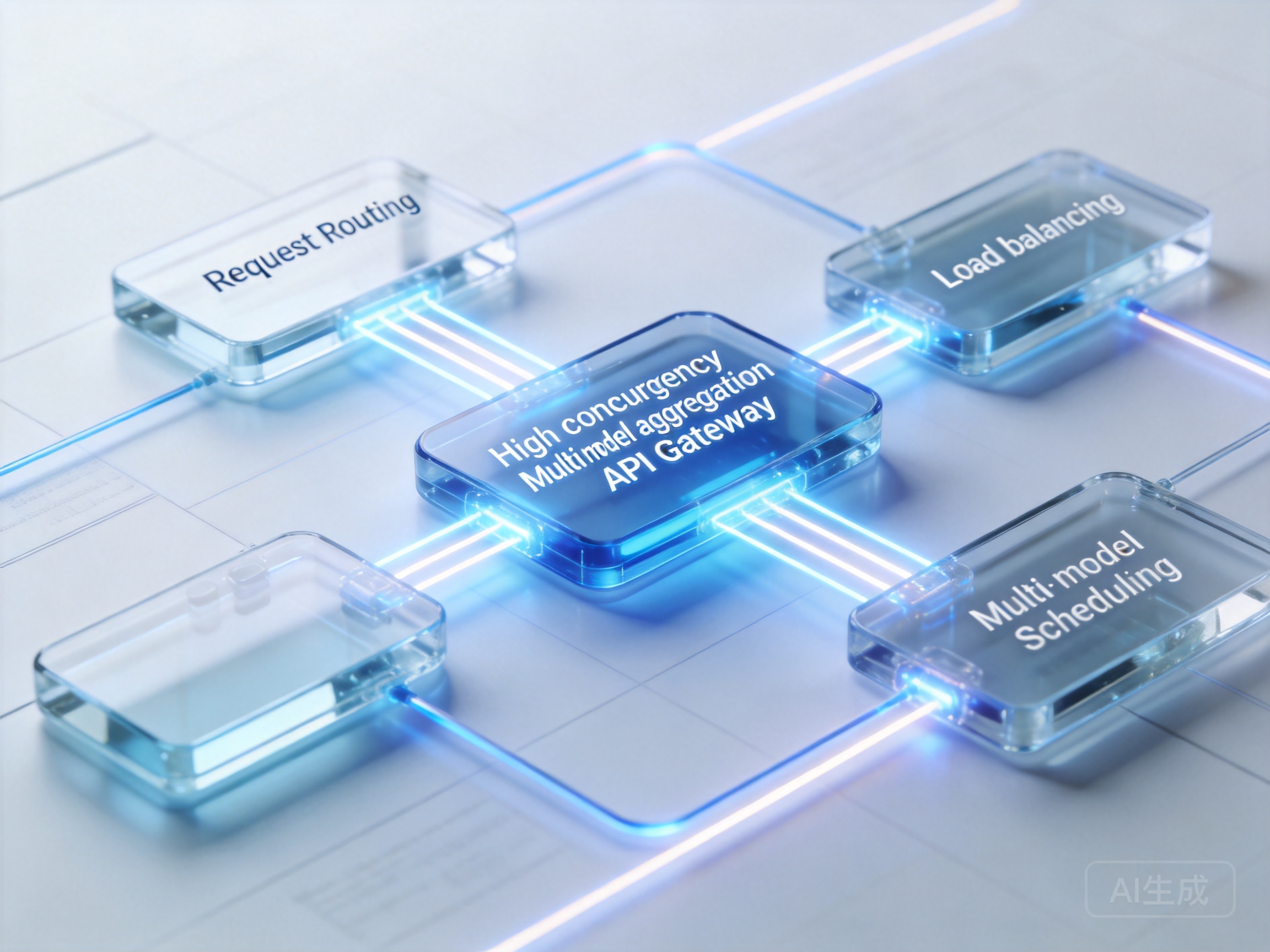

当开发者试图将多个顶尖 AI 模型无缝集成到业务系统中时,往往会遭遇并发限制、计费碎片化以及接口标准不一的阻碍。许多技术团队在测试环境跑得顺畅,一到生产环境就面临请求超时或触发速率限制的窘境。这直接引出了一个行业普遍关注的痛点:国内有哪些支持并发调用的高性价比多模型聚合API平台?寻找一个既能平滑处理流量洪峰,又能统一计费和接口规范的网关,成为了企业实现 AI 业务落地的必经之路。

如何选择支持高并发的大模型聚合API网关

在评估高并发稳定的多模型聚合API平台选型时,核心考量指标早已超越了单纯的价格比拼,而是深入到系统的底层调度能力。优秀的聚合平台需要具备智能路由机制,能够在某个底层模型服务商出现波动时,毫秒级切换至备用通道,保障业务连续性。

对于研发团队而言,重构底层代码来适应不同模型的 API 是极度消耗资源的行为。因此,寻找兼容OpenAI协议的高性价比AI大模型API服务商成为共识。标准的协议支持意味着你可以直接复用现有的 LangChain 或 LlamaIndex 业务逻辑,只需修改基础的 Base URL 和密钥,即可完成从单模型到多模型矩阵的无缝迁移。

低延迟多模型API聚合调度平台评测与实战

在众多企业级大模型API中转站降本增效方案中,七牛云提供了一套非常成熟的解法。其平台不仅在并发处理上表现优异,更在模型生态的丰富度上做足了功夫。通过接入七牛云AI推理服务,开发者可以一站式调用 Claude、Gemini、MiniMax、DeepSeek 等顶级模型。该服务完美兼容 OpenAI 和 Anthropic 双协议,甚至支持联网搜索和 MCP Agent 开发,新用户还能享受体验即送 300 万 Token 的高性价比福利。

在实际的企业级AI模型聚合中转站降本增效方案实战中,密钥管理和权限分配是安全运营的核心。七牛云 API Key 管理服务为这一环节提供了极大的便利。它作为企业集成顶级大模型能力的统一入口,支持开发者一键创建密钥,即刻激活最高 600 万免费 Token 额度,全面覆盖实时推理、图文生成、OCR 等全栈 AI 能力。

兼容OpenAI协议的多模型API接入教程

落实到具体的代码接入层面,清晰的技术指引能够大幅缩短研发周期。多模型聚合的优势在于“一次接入,全网调用”,但这要求平台提供极其详尽的接口说明,特别是针对视频生成或多模态模型的特殊参数要求。

为了让团队快速上手,建议直接参考AI大模型推理服务使用文档。该开发者中心不仅涵盖了全网搜索、批量推理等进阶功能的接入指南,还针对 Kling、Sora、Veo 等顶尖视频生成和 Gemini 图片生成模型提供了专项 API 说明。配合透明的 Token 计费体系,开发者可以精准预估成本,快速跑通从密钥获取到多模态应用落地的全流程。

构建现代化的 AI 应用,本质上是在做模型能力的拼图。通过合理利用支持高并发、多协议兼容的聚合 API 平台,企业不仅能够大幅削减试错成本,还能在不同业务场景中灵活调度最适合的模型。建议技术团队先从免费额度入手,在实际高并发场景下压测平台的延迟与稳定性,进而制定出最契合自身业务的调用策略。