接多个大模型API怎样设计统一的请求网关

面对百模大战,开发者往往要在不同控制台间疲于奔命:今天注册Claude,明天申请Gemini,还要处理各自迥异的SDK和报错逻辑。频繁切换不仅拖慢开发节奏,更让计费管理成为一团乱麻。对于资源有限的创作者而言,个人开发者接多个大模型API怎样设计统一的请求网关,直接决定了项目的迭代效率与试错成本。与其在业务代码里写满各种条件判断来适配模型类型,不如在架构层剥离复杂性,构建一个轻量且健壮的中间层平台。

兼容OpenAI标准的多模型统一接口方案

要实现不同厂商接口的抹平,核心在于协议转换。目前行业内事实上的标准是OpenAI的接口规范。很多开发者在研究个人开发者AI大模型网关反向代理教程时会发现,用Node.js或Go搭建一个轻量级代理是最敏捷的做法。我们需要将客户端发往 /v1/chat/completions 的标准请求,在网关层进行解包。如果目标是Gemini,网关负责将messages数组转换为Google要求的contents结构;如果目标是Claude,则需分离出system prompt并调整鉴权请求头。

在这个过程中,大模型多模型统一接入的思路尤为关键。如果不想从零手写所有模型的协议转换逻辑并时刻跟进厂商的API变更,借助七牛云等原生支持多模型集成的平台,可以直接调用完美兼容双API标准的服务,彻底省去繁琐的字段对齐与维护工作。

大模型API调用成本优化与统一路由策略

解决了基础的连通性问题,接下来是核心的路由分发机制。如何低成本搭建多大模型API分发路由?最实用的策略是基于任务复杂度进行动态分发。例如,在网关层解析请求体中的特定参数或提示词特征,将简单的文本总结、格式化输出路由给成本极低的国产模型,而将复杂的代码生成、长逻辑推理交给顶级模型处理。

这要求网关具备强大的鉴权、配额管理以及Token精确计算能力。通过完善的LLM统一API接口管理系统,开发者可以为不同业务线或不同客户端生成独立的密钥。配合网关层的语义缓存机制,对相似的提问直接返回历史结果,能够实现精确到单次调用的成本核算与指数级的费用缩减。

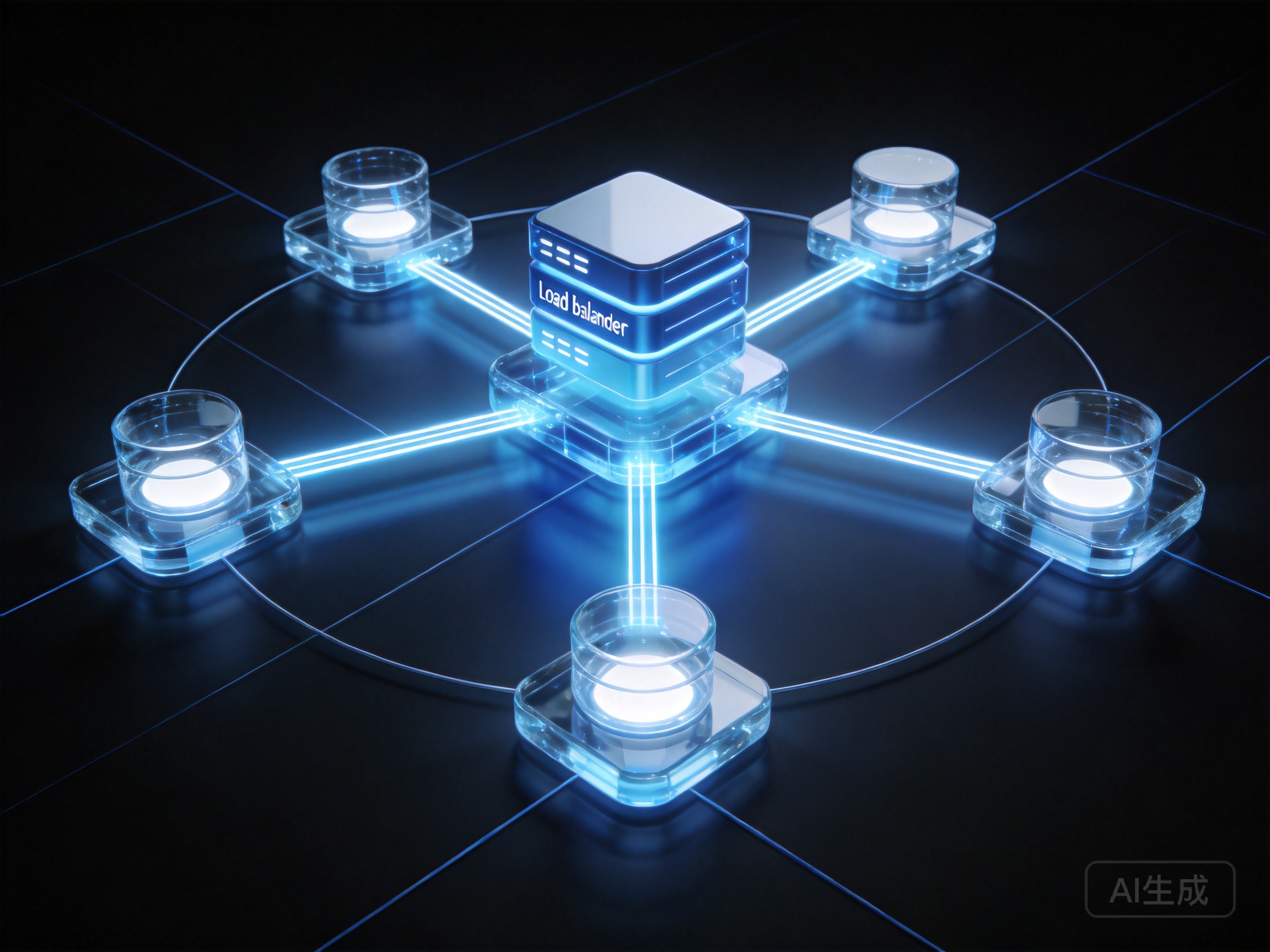

大模型API负载均衡与高可用部署实践

单点故障和并发限流是高频API调用的噩梦。当某个模型服务商突然宕机或触发请求超限错误时,网关必须具备无缝切换的兜底机制。在大模型多模型统一接入API网关架构设计中,重试机制与降级策略是保障业务连续性的标配。

我们需要在网关配置健康检查节点与熔断器。一旦检测到主模型响应超时,熔断器自动开启,网关立刻将请求平滑转发至备用的同级别模型。关于具体的统一请求网关部署方案,开发者可以通过查阅专业的云服务技术文档,结合Serverless架构或全球分布的边缘计算节点进行部署。这种无服务器架构不仅确保网关本身不会成为高并发下的性能瓶颈,还能维持极低的闲置运维支出,真正实现LLM统一API接口管理与分发平台搭建的商业级可用性。

搭建专属的请求网关并非单纯的造轮子,而是掌控AI应用生命周期的关键枢纽。从简单的反向代理起步,逐步引入统一路由、语义缓存和高可用容灾策略,开发者能将更多精力聚焦于核心业务逻辑的创新上。理清架构分层、做好接口标准化,是通向高效AI开发的必经之路。