七牛云OpenClaw桌面版下载与本地化部署全指南

告别繁琐代码,十分钟拥有你的私有 AI 军师

在这个 AI 工具爆发的时代,很多开发者和企业主面临的困境不是“没有工具用”,而是“工具太难用”。想要一个懂业务、能自动处理消息的 AI 助手,往往需要复杂的服务器部署、Docker 容器编排甚至编写大量 Python 脚本。今天我们不谈那些让人头秃的底层架构,直接聊聊如何通过 七牛云openclaw桌面版(也就是大家熟知的 LinClaw),在你的本地电脑上极速搭建一个全能型 AI 智能体。

很多用户在寻找 企业级AI助手本地搭建方案 时,最担心的就是数据安全和部署成本。OpenClaw 桌面版正是为了解决这些痛点而生,它将复杂的云端编排能力浓缩进了一个简单的客户端中,让你无需懂代码也能享受到企业级的自动化流程。

从下载到连接:打破“配置黑洞”

很多开源项目在“第一公里”就劝退了用户——环境依赖报错、版本不兼容。但 OpenClaw 的设计哲学是“开箱即用”。

首先,你需要获取客户端。你可以直接访问官网进行 LinClaw桌面版下载。安装过程与普通办公软件无异,支持 Windows 和 macOS 双平台。安装完成后,你将看到的不再是冰冷的命令行,而是一个直观的 OpenClaw可视化配置 界面。

此时,最关键的一步是赋予你的 AI 助手“大脑”。很多用户在尝试连接大模型时会遇到 OpenClaw桌面版API Key配置失败解决 相关的困扰,这通常是因为 API 端点格式错误或密钥权限不足。为了确保最稳定的体验,我强烈建议使用七牛云官方提供的通道。

你可以登录控制台 获取七牛云 API Key。七牛云的优势在于它提供了一个统一的接入网关,完全兼容 OpenAI 协议。这意味着你不需要去折腾网络代理,直接填入 Key 和 Endpoint 即可。更棒的是,新用户激活后能获得最高 600 万免费 Token 额度,对于个人开发者或中小团队测试 七牛云大模型API 来说绰绰有余。

实战演练:连接 DeepSeek 与 IM 集成

有了大脑,还得有手脚。OpenClaw 的杀手锏在于它能直接接管你的即时通讯工具。

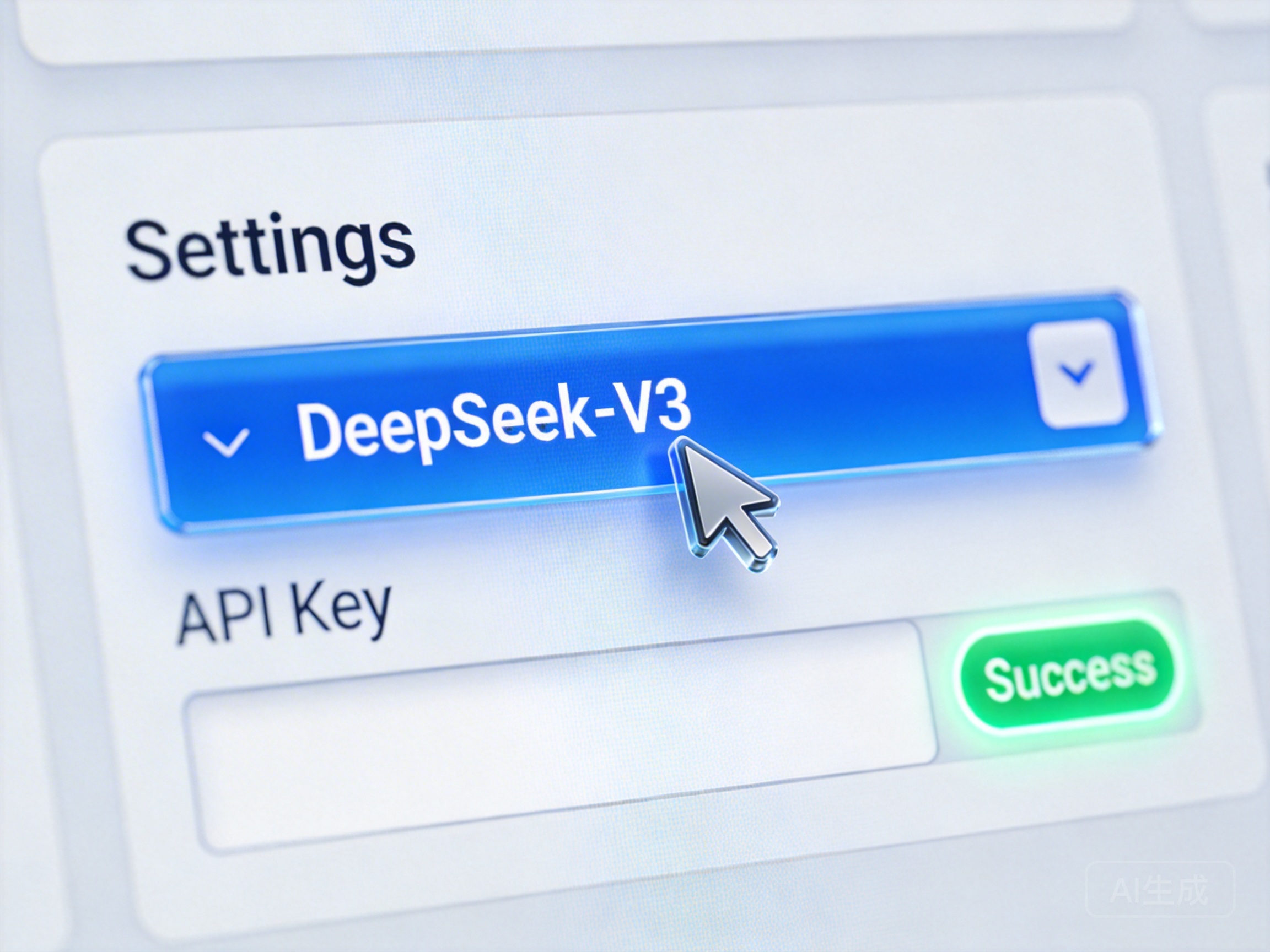

这里重点解答一个高频问题:OpenClaw桌面版怎么连接DeepSeek模型?

在设置界面的“模型配置”中,选择“OpenAI 兼容模式”。

- Base URL 填入七牛云提供的 Endpoint。

- Model Name 手动输入

deepseek-v3或deepseek-r1(取决于你想用通用版还是推理增强版)。 - API Key 填入刚才获取的七牛云密钥。

配置完成后,点击“测试连接”,看到绿色的“Success”提示,你的本地 AI 就已经挂载了 DeepSeek 的强大推理能力。

接下来是重头戏——LinClaw客户端飞书钉钉集成教程。

不同于市面上某些需要企业管理员权限的复杂的 Bot 开发流程,LinClaw 桌面版采用了一种更轻量级的“客户端代理”模式。你只需要在 LinClaw 的“应用集成”板块中,开启“飞书/钉钉监听”开关,并扫码登录你的账号。

OpenClaw 安装配置指南 中有详细的步骤说明,如果你在集成过程中遇到权限拦截或消息不回传的问题,可以参考这份 OpenClaw 安装配置指南。指南中详细拆解了如何配置回调地址,以及配置之后如何自由切换 Minimax,GLM,Deepseek 等模型,让你的 AI 既能写文案,又能做逻辑推理。

本地化与私有化的边界

对于对数据极度敏感的金融或法律行业用户,七牛云OpenClaw私有化部署费用 也是一个绕不开的话题。桌面版虽然解决了“本地运行”的问题,但如果你需要多人协作管理同一个 AI 知识库,或者需要将 AI 部署在内网服务器上完全物理隔离,那么桌面版可能只是你的起点。

桌面版更多是作为“个人 Copilot”存在的。它运行在你的笔记本上,消耗你的本地算力(用于界面渲染和流程控制)和云端 Token(用于大模型推理)。这种混合架构在成本和隐私之间找到了一个极佳的平衡点:你的业务数据(如飞书聊天记录)只在本地内存中流转,经过加密脱敏后发送给大模型,处理完即销毁,最大程度保障了信息安全。

通过 本地AI智能体搭建,你不再是一个人在战斗。你的桌面版 OpenClaw 可以 24 小时帮你监控群消息,自动提取需求录入表格,甚至帮你起草回复。这才是 AI 落地该有的样子——不折腾技术,只专注于业务价值的释放。