拆解Meta数据中心:OCP开源架构如何重塑万卡AI算力集群

当下企业构建万卡GPU集群时,往往会遭遇算力孤岛与能耗墙的双重阻击。单纯堆砌硬件早已无法满足庞大的计算需求。Meta作为全球顶级的科技巨头,其数据中心在应对极度苛刻的AI算力挑战时,走出了一条独特的硬件重构之路。这套以OCP开源架构为核心的底层设计,不仅彻底颠覆了传统IT基础设施的搭建逻辑,更为业界提供了极具参考价值的大规模AI集群网络设计范本。

Meta数据中心如何优化大规模AI集群网络

传统网络在处理万亿参数模型训练时极易产生微秒级拥塞,导致GPU空转。Meta在构建其顶级集群时,并未盲从昂贵的专有网络方案,而是深度定制了基于以太网的RoCEv2协议。

要解决海量节点间的通信瓶颈,核心在于消除网络拥塞并实现极致的负载均衡。他们采用了多层Clos无阻塞拓扑结构,配合精准的端到端流量控制机制。这种架构允许网络在极高负载下自动识别大象流(大吞吐量数据包)与老鼠流(对延迟敏感的小数据包),并为其动态分配最优路径。这种网络架构的重构,大幅降低了跨机架通信延迟,让数以万计的加速卡能够如同单一超算般高效协同工作,将网络带来的性能损耗降至最低。

基于OCP开源架构的AI算力部署方案

以往的服务器设计高度定制且封闭,导致硬件迭代周期漫长。OCP(Open Compute Project)提倡的模块化与标准化彻底打破了这一桎梏。以Meta主导设计的Grand Teton平台为例,计算底板、网络接口与供电模块被完全物理层面解耦。

企业在落地此类方案时,可以根据前端业务的实际负载灵活配置CPU与加速器的比例。主板被设计为支持多种不同的加速器形态,无论是训练专用的高带宽显存芯片,还是面向低延迟场景的推理芯片,均可即插即用。当底层硬件具备极高的扩展性与兼容性后,上层的应用层才能真正释放潜能。尤其是在处理高并发的AI大模型推理任务时,这种解耦架构能显著缩短新算力节点的上线周期,帮助开发者快速迭代并响应真实用户的海量请求。

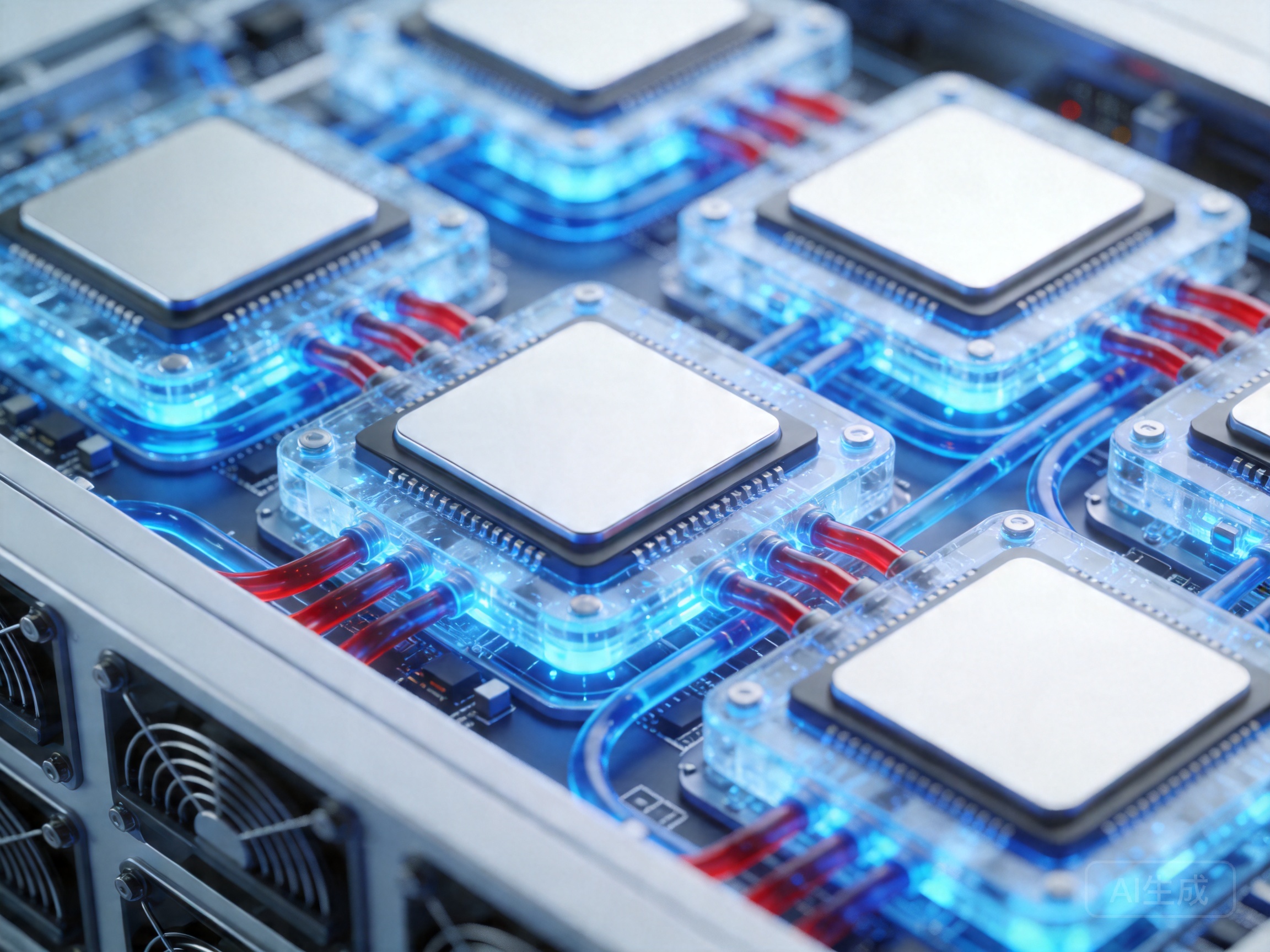

AI数据中心高功率液冷系统设计教程

算力密度的指数级增长直接引爆了机房的散热危机。当单机架功率密度从传统的10kW飙升至100kW以上时,空气的比热容已经无法带走如此庞大的热量,风冷方案彻底失效。直接芯片液冷(Direct-to-Chip)成为新一代机房的标配。

设计并部署一套高可用液冷系统,需要精准计算冷却液的流速、进出水温差以及冷板与发热源的接触热阻。在实操中,管路设计必须采用盲插快接头(Quick Disconnects)以防漏液,并在机架底部与关键节点配备微环境漏水检测传感网络。此外,支撑这些庞大算力运转的,是源源不断的训练语料与多模态文件。这要求底层架构必须配备强悍的海量数据存储管理系统,确保在温水与冷水不间断循环带走热量的同时,PB级的数据能够以极高的吞吐量和极低的延迟持续喂给处于满载状态的GPU。

硬件开源与架构解耦正在重塑基础设施的物理形态。无论是网络拓扑的重新编排,还是散热系统的物理学革新,其本质都是为了在极致的计算性能与总体拥有成本之间寻找最优解。企业在规划下一代计算平台时,完全可以借鉴这种模块化、标准化的工程思维,从业务真实痛点出发,搭建出高弹性、高能效的数字底座。