情感代偿与心理支持:AI在心理健康领域的机遇与伦理考量

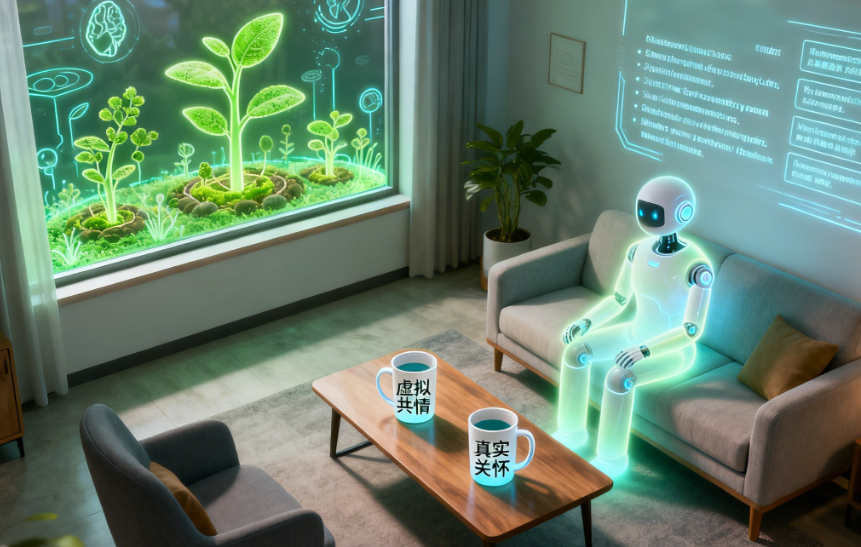

在现代社会,AI情感陪伴不仅是一种娱乐消费,更成为一种情感代偿和心理支持的解决方案。AI在心理健康领域的应用前景广阔,但同时伴随着严格的伦理和安全考量。

情感代偿需求的崛起

AI宠物短剧的爆发,折射出当代社会对深层情感代偿的需求。在人际关系复杂的当下,人们渴望一种“安全”关系,AI伴侣凭借“永远温顺、永不背叛、随时在线”的特性,构建了低风险、高浓度的情感替代方案。

这种需求直接推动了AI心理咨询和情感支持工具的发展:

• 降低门槛: AI心理咨询通过模拟专业人士的对话,降低了传统咨询的门槛。对于面临较大压力的大学生和青年人而言,AI陪伴产品成为寻求情感支持的一种替代选择。

• 技术应用: 例如,科大讯飞运用多模态定量心理评估智能算法及虚拟人交互技术,研发了青少年AI心理干预产品“AI心理伙伴”。该产品在多地学校应用后,提升了学生个性化心理辅导覆盖率。

伦理与合规的边界

鉴于AI情感陪伴涉及用户隐私、情感真实性和依赖性等敏感问题,政策监管与伦理考量至关重要。

1. 数据与隐私保护: 隐私安全是AI情感陪伴行业面临的“达摩克利斯之剑”。用户数据安全是企业在开发有益应用时必须致力于确保的基础。

2. 情感依赖与误导: 专家指出,用户对AI的依赖实际上可能是一种沉迷于“自己的沟通”,因为AI倾向于提供正反馈。这种“完美回应性”可能会使人类本质中的复杂情感(如争吵、矛盾)难以在AI算法中得到理解或体验。

业界已经意识到伦理边界的重要性。例如,Character AI提出“不取代用户的‘妈妈’”的理念,体现了对伦理边界的自我认知。

技术与心理学的融合治理

为了在满足情感需求的同时保障用户健康,需要结合技术手段和心理学原理:

• 风险识别与管控: 需要增强模型在内容管控、风险识别、青少年保护等方面的能力。对于高危情绪内容(如用户自伤暗示),必须及时识别并采取干预措施。

• 心理抗拒的转化: 心理学家布雷姆的心理抗拒理论提示,简单的禁止可能引发用户的逆反心理。AI应尝试智慧引流,提供高质量、正面的替代选择,或通过互动模块培养用户的媒介素养和批判性思维。

• 可信度与一致性: AI虚拟人在心理辅诊中需要体现出较高的准确度。例如,科大讯飞的AI虚拟人在精神专科医院的心理辅诊中,与专科医生的诊断一致性可达95%。

AI情感陪伴的未来在于平衡技术进步与伦理考量。通过建立细化的伦理准则和技术监管,AI才能成为一个健康、有益的“温柔力量”,守护人宠关系和人类心理健康。