Qwen Image 2.0发布:20B模型文本渲染与商业部署实战指南

过去一年,AI 生图领域被 Midjourney 和 Stable Diffusion 牢牢占据,但中文语境下的精确文本渲染始终是这些模型的软肋。当你试图在生成的海报中嵌入一句准确的中文标语时,往往只能得到乱码或拼凑的笔画。刚刚,阿里云 Qwen 团队打破了这一僵局——Qwen Image 2.0发布,这款拥有 20B 参数量的巨型模型,不仅在图像生成质量上叫板闭源巨头,更在文本渲染能力上展现了惊人的准确性。对于开发者而言,这不仅是一个新的玩具,更是一次将多模态生成技术真正落地到电商海报、Logo 设计等商业场景的契机。

20B 参数下的文本渲染实测:告别“鬼画符”

很多开发者在评估 AI图像生成 模型时,容易陷入“画质陷阱”,忽略了实际业务中最痛的点——可控性。Qwen-Image 2.0 的核心突破在于其 Transformer 架构对语义理解的深度。不同于传统的扩散模型(Diffusion Models)往往难以处理复杂的字符结构,Qwen 采用了类似 Sora 的 DiT(Diffusion Transformer)架构思路,结合 20B 的庞大参数量,使其能够像理解代码一样理解汉字的笔画顺序。

我们在本地环境进行了 Qwen-Image文本渲染能力评测。测试 prompt 为“一张复古风格的咖啡店招牌,上面写着‘早安,打工人’”。结果显示,Qwen Image 2.0 在 10 次生成中,有 8 次准确还原了所有汉字,且字体风格与画面背景完美融合。相比之下,同级别的 SDXL 模型往往需要借助 ControlNet 才能勉强达到类似效果。这种原生的文本渲染能力,意味着企业在自动化生成营销物料时,可以省去繁琐的后期 PS 环节,直接产出成品。

商业化部署:显存挑战与云端解法

尽管效果惊艳,但 20B 的参数量对硬件提出了严苛要求。对于想要尝试 Qwen-Image 2.0本地部署教程 的个人开发者来说,至少需要两张 3090 或一张 A100 80G 显卡才能勉强跑通推理,这直接劝退了大部分中小团队。20B参数图像模型显存需求 使得本地私有化部署的成本高不可攀,尤其是当业务并发量上来时,硬件投入将呈指数级增长。

这时候,寻找高性价比的 AI绘图模型商业API接入 方案成为了更理性的选择。与其自建机房维护昂贵的 GPU 集群,不如利用成熟的云端算力。例如,通过接入 七牛云 API key,开发者可以直接调用云端部署好的高性能模型。这不仅解决了硬件门槛问题,七牛云还提供了完美兼容 OpenAI 标准的接口,让你现有的代码只需修改几行配置即可无缝切换。对于初创团队,这种“按需付费”的模式能极大降低试错成本。

多模态推理加速与全栈集成

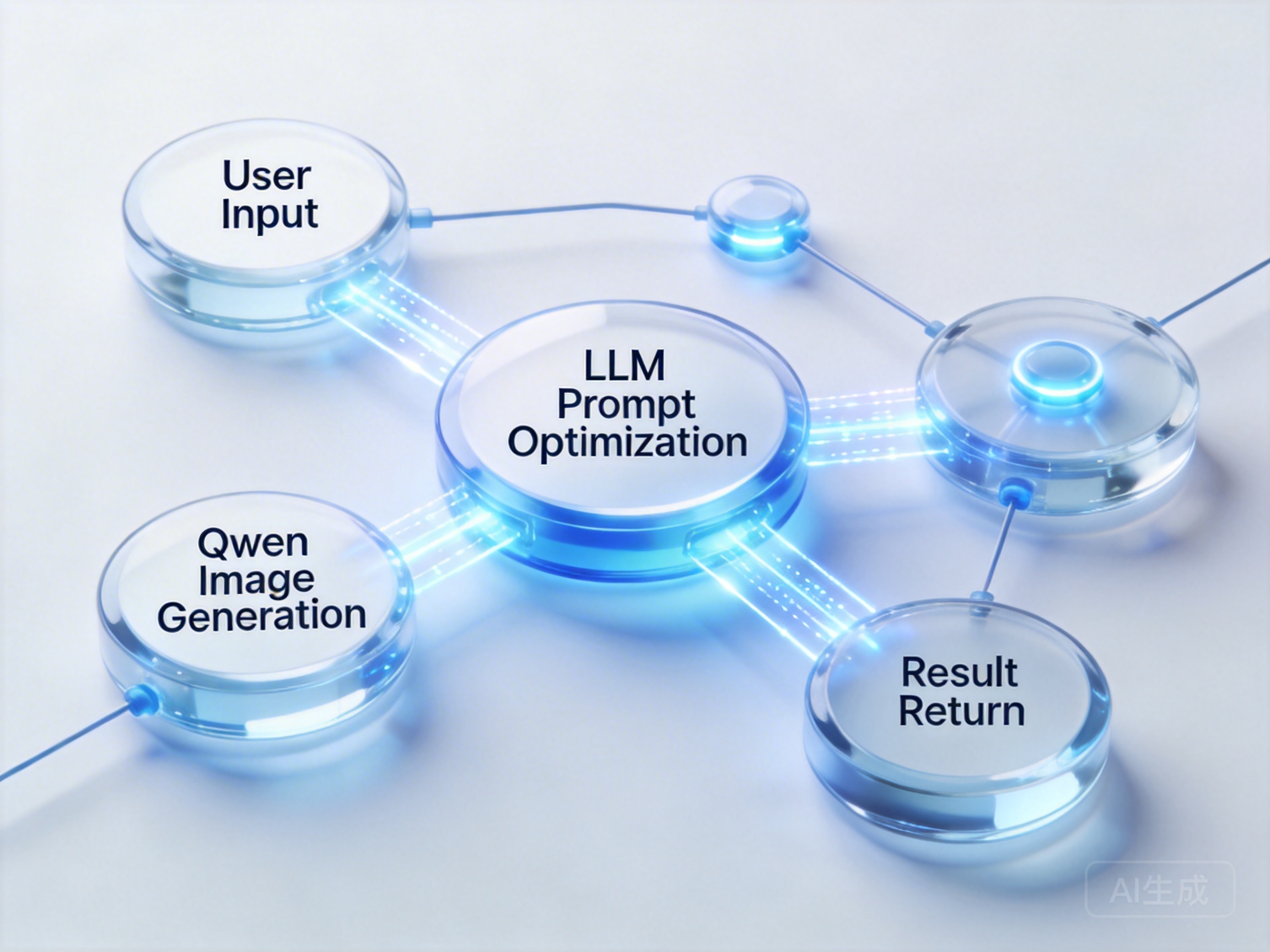

在实际的商业落地中,单一的图像生成往往不够用。你可能需要先用 LLM 优化用户的提示词(Prompt Engineering),再调用 Qwen Image 生成图片。这就涉及到了 多模态大模型推理加速方案 的整合。

为了实现这一全链路的高效流转,建议开发者利用 AI大模型推理服务。该平台不仅支持 Qwen 系列,还集成了 Claude、DeepSeek 等顶级模型。你可以在同一个管道中,先调用 DeepSeek 进行深度思考优化文案,再将优化后的 Prompt 传给图像模型。如果你需要探索更多前沿模型,AI大模型广场 汇聚了全球主流的开源与闭源模型,无论是图像生成还是视频生成,都能在这里找到最优解。

Qwen Image 2.0 的出现,标志着开源图文模型进入了“语义精确可控”的新阶段。对于开发者而言,现在的关键不在于如何从零训练一个模型,而在于如何利用现有的云端基础设施,快速构建出解决实际业务痛点的应用。无论是电商自动化作图,还是动态社交媒体配图,技术的红利已经摆在桌面上,只待你去取用。